设置函数

我们可以找到一个函数

,如果

则输出

,否则输出

。

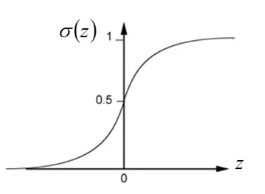

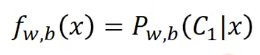

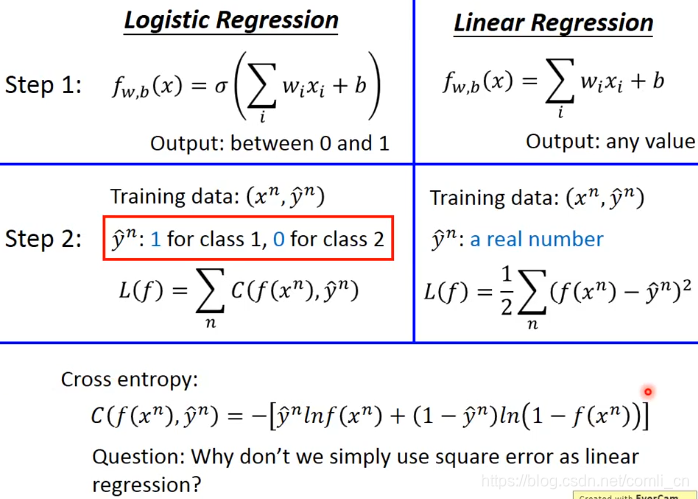

逻辑回归的模型如下:

所以我们设置函数为:

判断函数的好坏

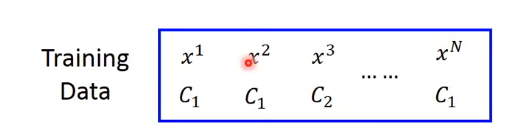

假设我们有下面的一组数据:

我们假定数据是依据函数

生成的,那么接下来我们就要求取参数

和

了。

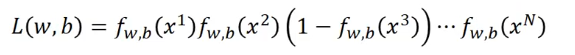

我们定义:

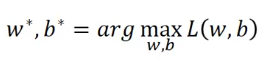

最有可能让训练集呈现上面的样子的是使

最大的

和

,即:

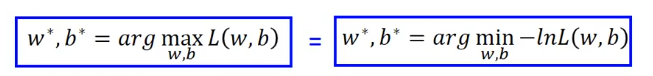

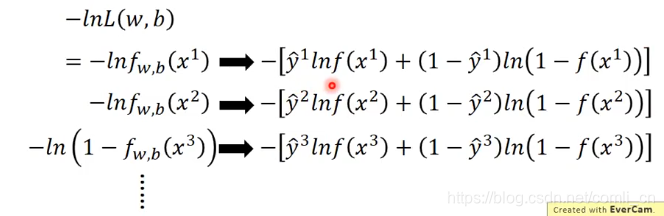

为了简化计算,我们对上式进行一下转换:

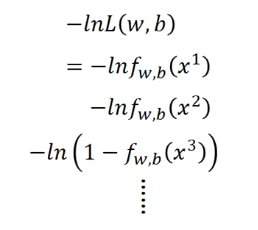

这时候原本的乘法就变成了加法:

又(这里用到了交叉熵.),我们定义

为交叉熵损失函数

找一个最好的函数

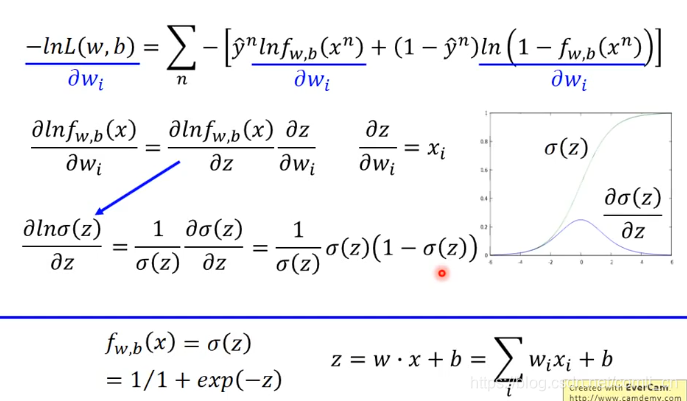

交叉熵损失函数对

求偏导(这里用到了求导的链式法则)

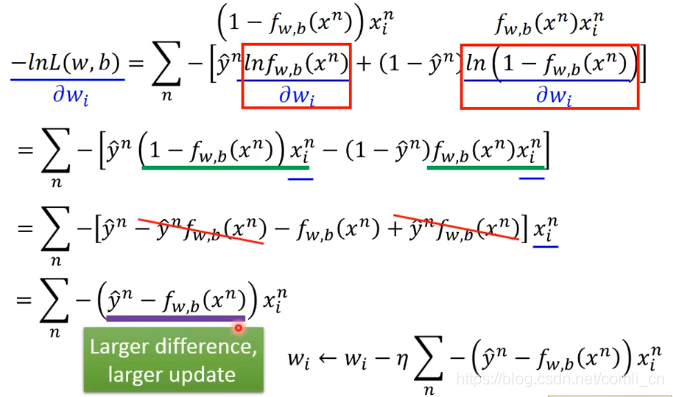

进行化简得:

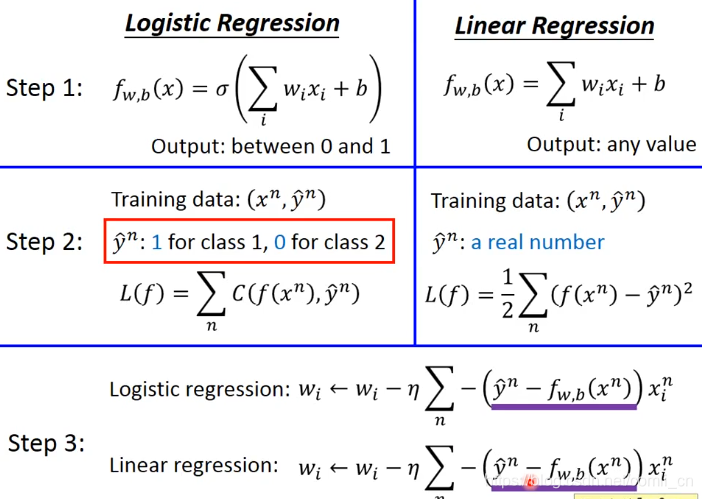

逻辑回归和线性回归的对比

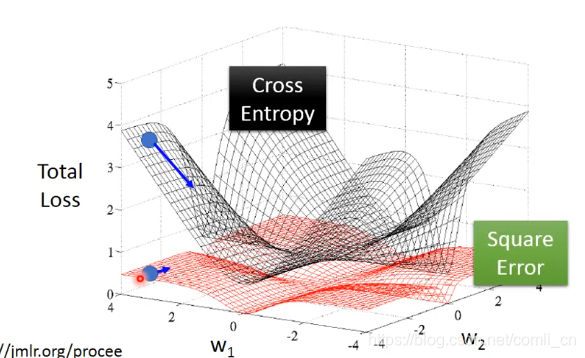

为什么逻辑回归不用平方损失函数

如果我们在逻辑回归中用了平方损失函数的话:

我们可以看到,如果目标值

,当

时,偏导数为0,也就是说因为我们计算出来的值跟目标值是一样的所以不需要更新,这是正确的。但当

的时候,平方损失函数的偏导数为0,也就是说不需要更新,但事实上我们的计算值离实际值很远。

同样的情况会出现在

中。