Abstract

• LLE利用线性重构的局部对称性来找到高维数据的非线性结构;

• LLE的优化虽然能够产生高度的非线性嵌入,但不涉及局部极小值。

1 Introduction

• 当MDS采用欧式距离时,结果等价于PCA。它们的优化都不是局部最小;

2 Algorithm

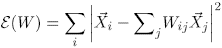

这是一个最小二乘问题。旋转和缩放不变性可以从式中得到,平移不变性是从权值矩阵行和为1的约束中得到。这种对称性使权值矩阵表征了每个邻域的固有几何特性,而不是依赖于特定参考系的特性。

• 算法期望原始数据空间中的局部几何特征对于流形上的局部同样有效;

• 想象一下,拿一把剪刀,剪下流形的局部线性补丁,然后将它们放在低维的嵌入空间中;

得到一组以原点为中心的正交坐标

3 Examples

实验,略

4 Discussion

• 自编码神经网络的迭代爬山法、自组织映射和潜变量模型不具有全局最优或收敛性保证,同时它们还有自由参数;

• LLE的一个优点是它避免了大型动态规划问题,倾向于积累稀疏矩阵,能顾节省空间和时间;

• 从LLE得到映射关系:利用 做有监督学习。

做有监督学习。