1. 原理

LR虽然叫逻辑回归,但LR即可以用来回归,也可以用来分类,主要是二分类。LR可以被认为是一个被sigmoid函数所“归一化”后的结果。

2. 算法步骤

(1)寻找h函数(即hypothesis);

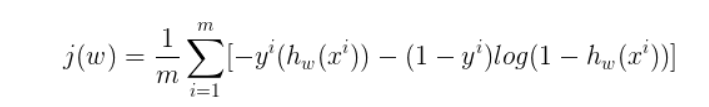

(2)构造J函数(损失函数);

(3) 想办法使得J函数最小并求得回归参数(θ)

2.1 寻找h函数

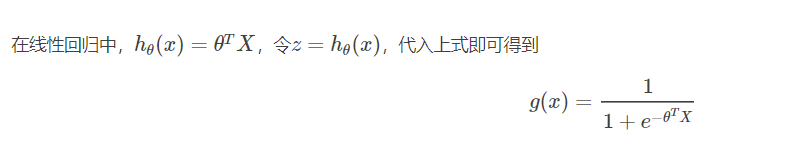

在线性回归中:

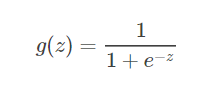

在此引入sigmoid函数:

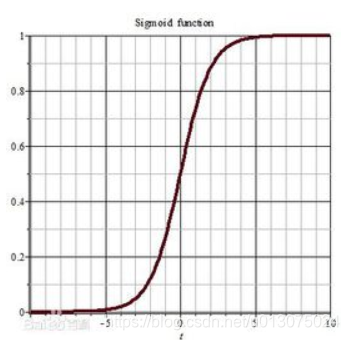

sigmoid函数图像如下图所示:

为什么引入sigmoid函数?(面试问过)

(1)定义域:(−∞,+∞)

(2)值域:(0,1), 且在0.5处为中心对称,并且越靠近x=0的取值斜率越大

(3)函数在定义域内为连续和光滑函数

(4)处处可导,导数为:f’(x) = f(x)(1−f(x))

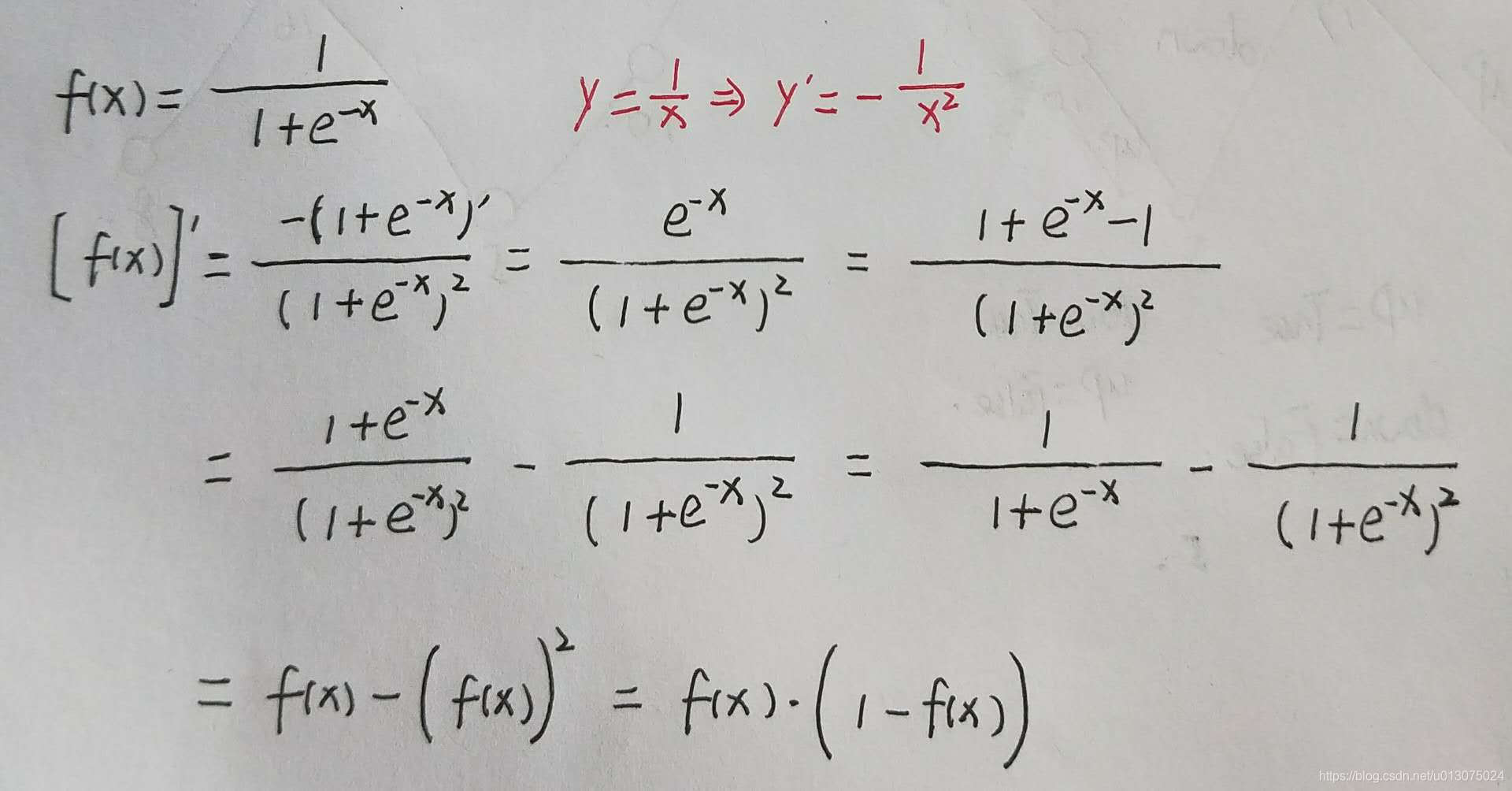

sigmoid函数求导过程?(面试要求推导过)

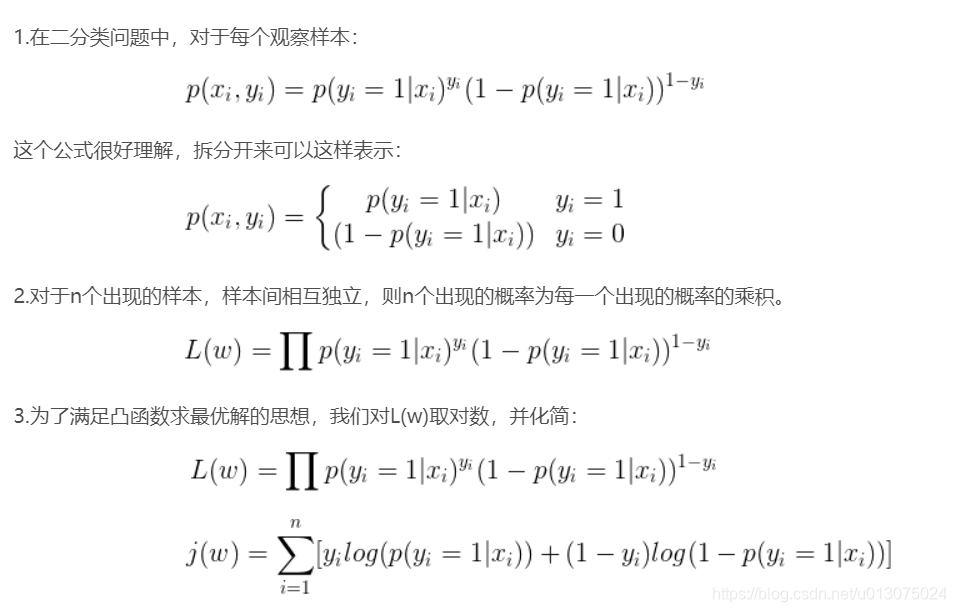

以下逻辑回归的代价函数怎么得到的?

推导如下: