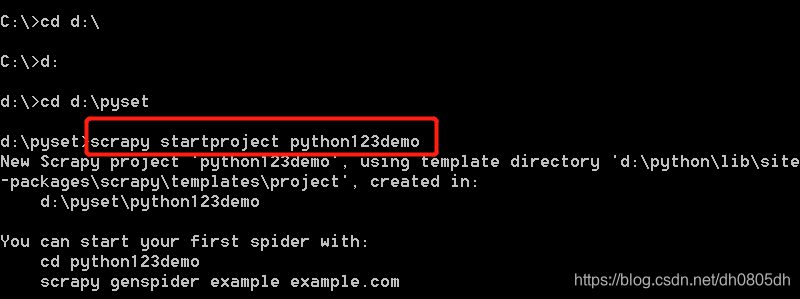

新建工程

scrapy startproject *** 命令

在d盘pyset文件夹下新建一个爬虫工程

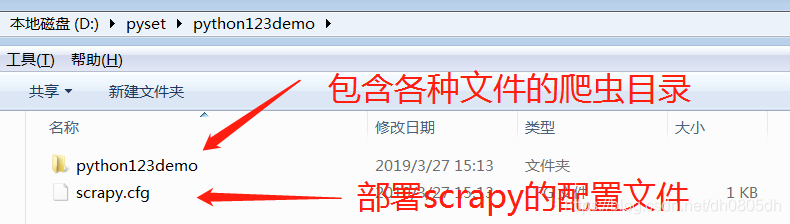

打开D盘下的pyset文件夹会看到上面这个样子

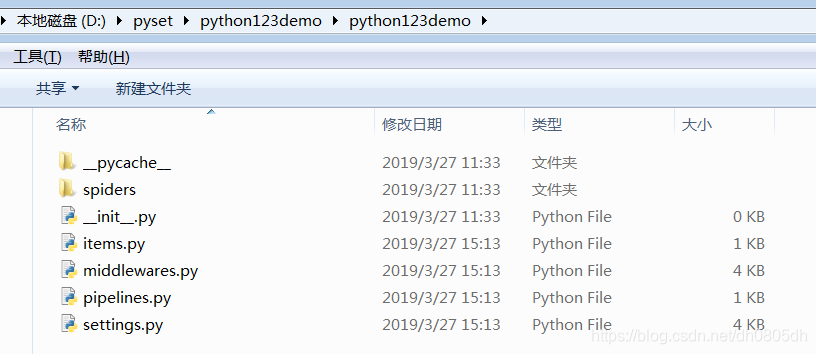

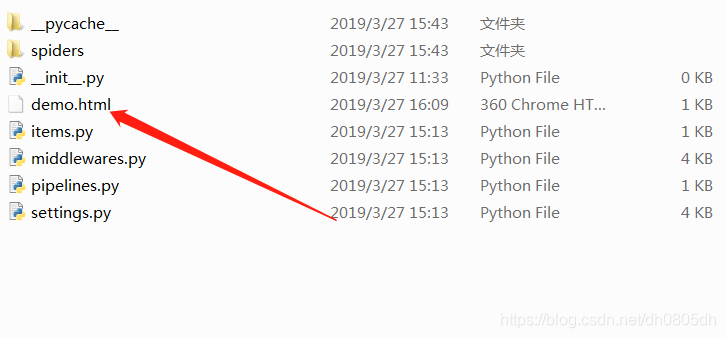

上面是进入python123demo之后的样子

| 文件名 | 内容 |

|---|---|

| pycache | 缓存目录 |

| spiders | 存放爬虫 |

| init.py | 初始化脚本 |

| items.py | items模板,继承scrapy中的item类 |

| middlewares.py | middlewares模板,可扩展 |

| pipelines.py | pipelines模板 |

| settings.py | 爬虫的配置文件 |

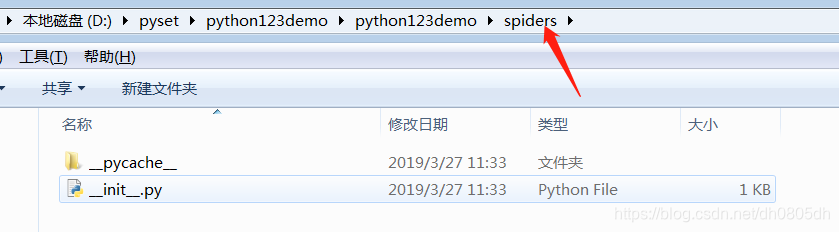

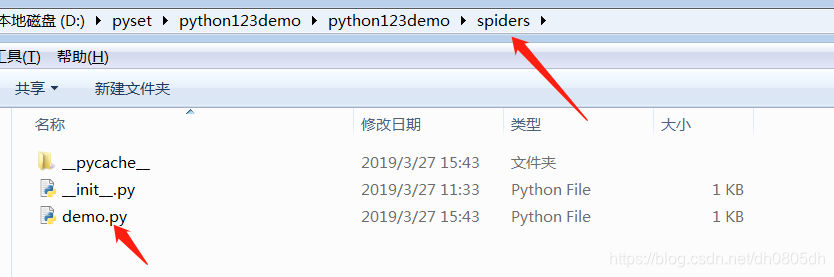

再进入spiders文件夹中

init.py是初识文件~

================================================================

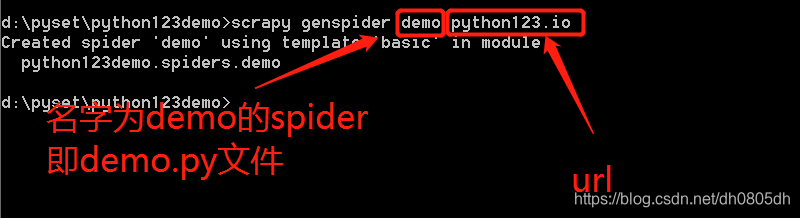

产生爬虫~给定爬虫名与爬取网站

scrapy genspider ** **** 命令

当然。。。手动进入修改也可以。。。下面会有手动修改的图图~

输入指令之后可以在spider文件内看到下面的内容

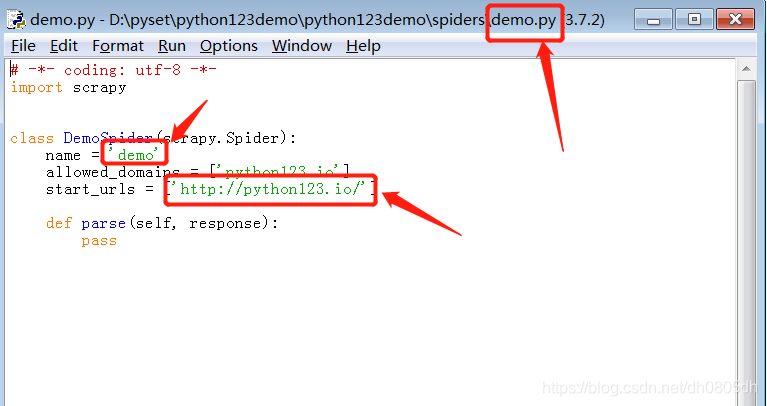

打开demo.py文件~

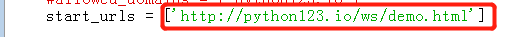

这里就是手动修改啦~

撸代码,将页面信息保存起来~

# -*- coding: utf-8 -*-

import scrapy

class DemoSpider(scrapy.Spider):

name = 'demo'

#allowed_domains = ['python123.io']

start_urls = ['http://python123.io/ws/demo.html']

def parse(self, response):

fname = response.url.split('/')[-1]

with open(fname,'wb') as f:

f.write(response.body)

self.log('Saved file %s.' % fname)

================================================================

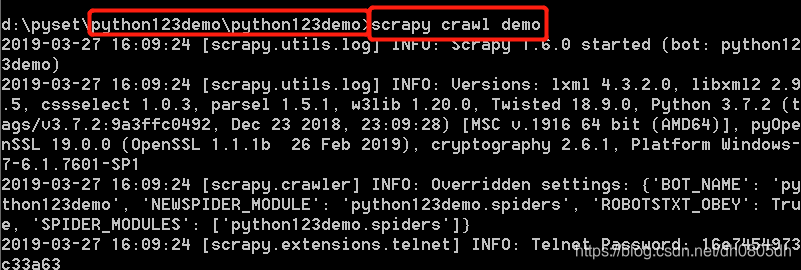

之后在python123demo下运行~

scrapy crawl demo 命令

得到~

第一次接触这个

我哭惹

你呢