参考:https://www.jianshu.com/p/8a0ad237b0ed

1、随机现象:并不总是出项相同结果的现象称为随机现象。

2、随机变量:随机现象各种结果的变量(一切可能的样本)称为随机变量。

3、信息量:概率越小的事件,信息量越大。

例如:

事件一:巴西进世界杯

事件二:中国进世界杯

由于中国进世界杯的概率很小,所以事件二带来的信息量更大一些,给人留下的印象更深刻(惊讶)一些。

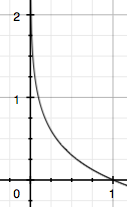

4、 用I表示信息量,P表示概率,两者之间的关系如下:

I

P

P

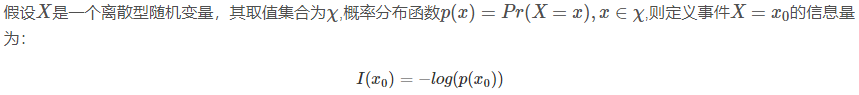

信息量计算公式:

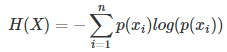

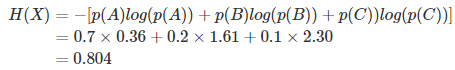

5、熵:所有信息量的期望值。例如,打开计算机有三种可能,具体如下表:

计算熵的公式:

-log(p(xi))为每个信息量,-p(xi)logp(xi)为每个信息量占总事件的比例。假设一共有n个事件,即n个p(xi)log(p(xi))相加,前面加负号,使最后的值为正。

上面的例子,结合熵的定义,计算过程如下:

如果是二项分布,可以简化熵的计算。

p(x)至今不知道什么含义,请各位留言解析,谢谢。原文中也说,文中所有的对数为自然对数。不知道何意,自然对数为何不写成In表示呢?查阅熵的资料,表示形式都是log。

6、相对熵