版权声明:本文为博主原创文章,欢迎转载,转载请注明出处。 https://blog.csdn.net/shanglianlm/article/details/88879985

DRN:

Dilated Residual Networks (CVPR2017)

https://arxiv.org/pdf/1705.09914.pdf

Pytorch: https://github.com/fyu/drn

特点:

- 本文是作者将残差网络Deep Residual Networks (Deep Residual Learning for Image Recognition )与其之前研究的Dilated Convolution (Multi-Scale Context Aggregation by Dilated Convolutions ) 相结合的结果;

- Dilated Convolution可以不降低特征map的尺寸而增大卷积感受野。而之前FCN使用pooling下采样来增大感受野,但随后又不得不通过Deconvolution或者upsampling来增大特征map尺寸,这样先减后增的操作会让图片特征损失很多信息;

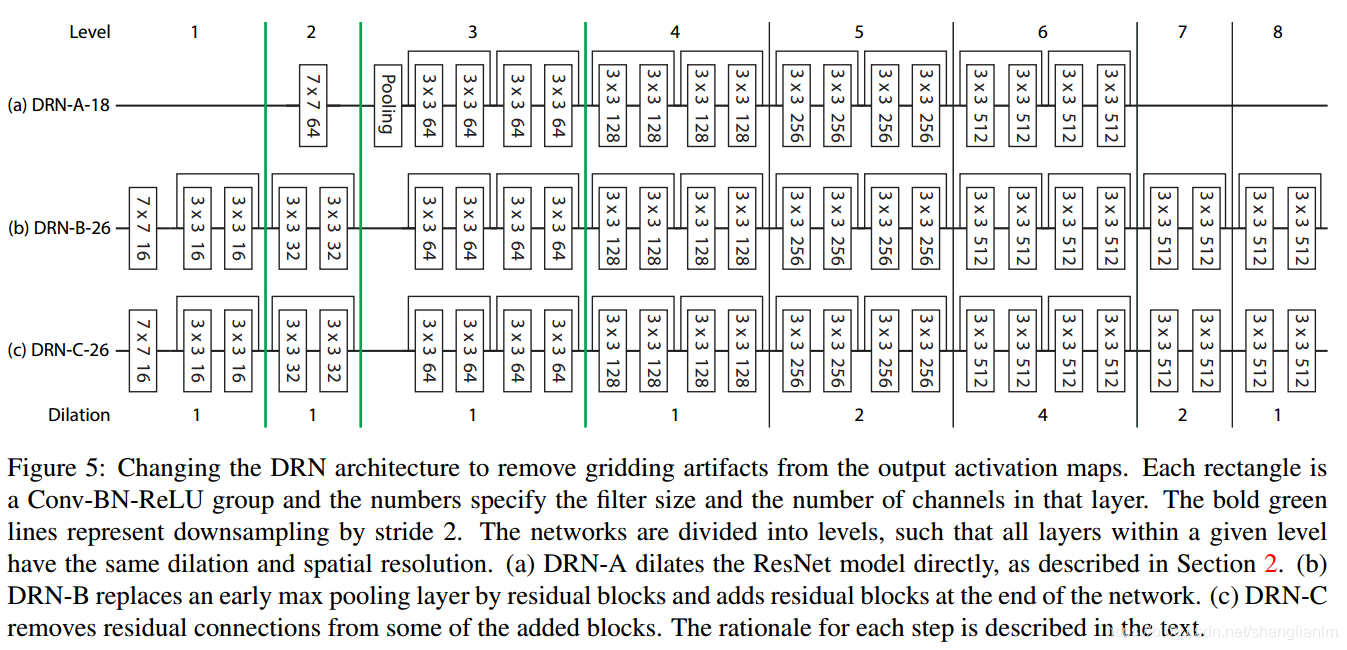

- Dilated Convolution 本身会带来的 的网格化现象,为了减轻网格化现象,作者将 a) ResNet中 第一个卷积层后面的 max pooling 改为stride=2的卷积层,b) 网络后面添加 dilation 较小的卷积层,通过网络学习,消除网格现象 和 c) 去掉level7和8上的shortcut connection。