深度学习中的归一化

- 批量归一化

- 自归一化网络

主要内容与结构

主要内容:归一化问题

结构:

- 深度模型的激活函数

- 激活函数导致的梯度消失

sigmoid

tanh

relu

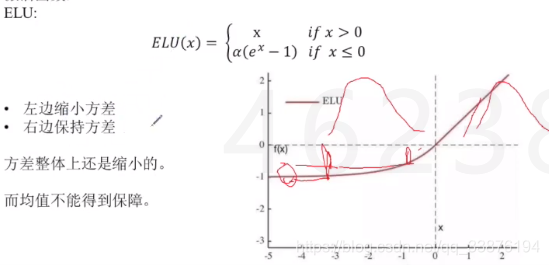

ELU - 批量归一化

层输出对下一层的影响

每一层的梯度都与来自前一层的输入有关。避免梯度消失

批归一化+仿射变换层(线性层):防止将那些本该在平坦区域却被我们归一化变换到梯度不平坦的区域带来的影响;同时保持网络稳定(让输入稳定)

优点:降低了模型训练中的协变转移;防止由于数据噪音造成的梯度消失;保有原模型的表达能力 - 自归一化网络

所以,如果网络中隐藏层神经元总可以保持输入随机变量的均值和方差稳定不变,那么:训练网络将不会出现梯度爆炸和消失;每一层的输入也将保持稳定的分布,从而达到批量归一化减小协变偏移的效果。

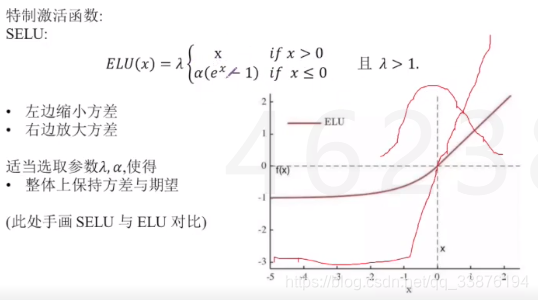

给ELU乘上一个 且

(中心极限和banach不动点定理)