在残差逐渐当道时,google开始研究inception和残差网络的性能差异以及结合的可能性,并且给出了实验结构。

本文思想阐述不多,主要是三个结构的网络和实验性能对比。

Inception-v4, Inception-ResNet and

the Impact of Residual Connections on Learning

-

论证残差和Inception结合对性能的影响(抛实验结果)

1.残差连接能加速Inception网络训练

2.和没有残差的Inception相比,结合残差的Inception在性能上有微弱优势

3.作者提出了Inception V4,Inception-ResNet-V1,Inception-ResNet-V2

-

Inception系列正名

1.GoogLeNet=Inception V1

2.BN-Inception = Inception V2

3.分解卷积 = Inception V3

-

InceptionV4

整个结构所使用模块和V3基本一致,不同的是Stem和Reduction-B

InceptionV4中Stem

299->35的过程

-

Inception-ResNet

Inception-ResNetV1 计算量接近Inception V3

Inception-ResNetV2 计算量接近Inception V4

-

Inception-ResNetV2

V1和V2残差Inception相近,不同点在stem和部分模块的卷积大小

-

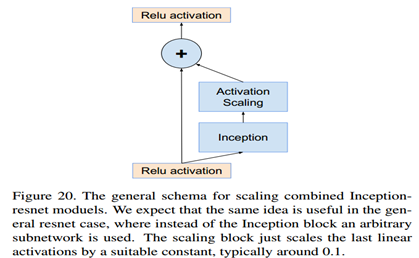

残差Inception模块的缩放

现象:当滤波器超过1000时,残差网络出现不稳定,最终GAP层激活值大部分变为0,且无法通过降低学习率和增加BN来避免。

经过实验发现,通过缩放残差Inception模块能够使其训练稳定,通常设置0.1~0.3

-

实验性能对比

实验较多,以单模型单裁剪为例