开发平台:win10+py3.6 64bit + tensorflow-gpu == 1.9.0版本

使用的工具以及库:

- pycharm(全宇宙唯一一款专门用做python开发的工具)功能强大

- tensorflow-gpu 1.9 (win10下配置gpu环境过程多坑,配置教程看我另一篇博客)

- tensorflow cpu版不太建议,很慢很烫,是真的慢真的烫

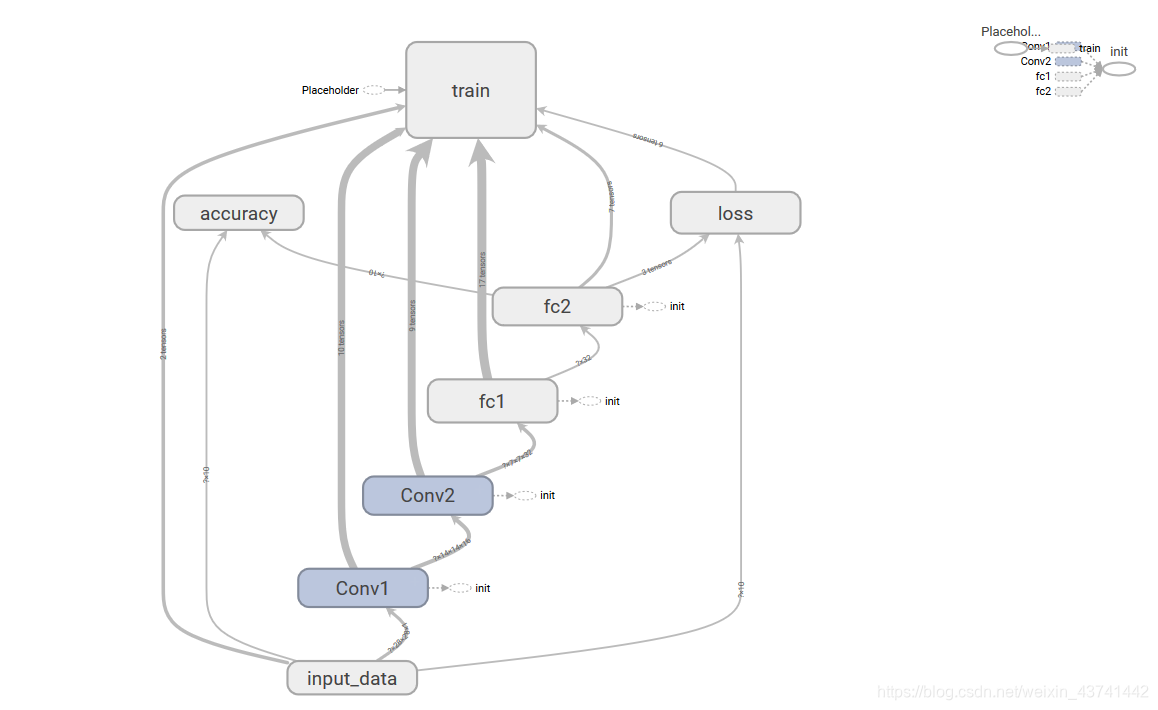

先看看训练的tensorboard的图

详细解释看代码注释

- 准备工作

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

# 载入数据集,路径要找对自己的,数据集我的博客另外一片有下载链接

mnist = input_data.read_data_sets("../../tensorflow_code/mnist/", one_hot=True)

# 设置没批次的样本数据大小

batch_size = 50

# 定义一个学习率占位符,用于后面随着训练的次数增加来修改学习率,以便于更加好收敛

learn_rate = tf.placeholder(tf.float32)

# 学习率

# 初始值设置为0.15

rate = 0.15

# 计算一共有多少个批次, 后面好像也没有用它

n_batch = mnist.train.num_examples // batch_size

- 把随机生成权重,和偏置封装成函数

def weight_variable(shape, name=None):

"""

输入数据类型,随机初始化值返回

:param shape: [] 类型

:param name: 起的名字

:return: 随机初始化的值

"""

initial = tf.random_normal(shape=shape, stddev=0.1, name=name)

# 转化为tf.的变量类型才可以跟着训练改变,优化

return tf.Variable(initial)

def bias_variable(shape, name):

''' 初始化偏置 '''

initial = tf.constant(0.1, shape=shape)

return tf.Variable(initial, name=name)

3.第一层:卷积,激活,池化

经过第一层卷积池化:

卷积:就是窗口的每一个像素值乘于窗口的权重

5*5的采样窗口,32窗口卷积,x,y 步长为1

对于一张图片来说: 28 x 28 x 1

最后得到:32张 28 x 28 的图,因为步长全部为1

- 卷积层

def conv2(x, W):

'''卷积层,以为图片是2维的,所以使用2维的api tf.nn.conv2d()

x: 输入的图片数据的类型[batch(样本数), height(图片高), width(图片宽), channels(图片RGB通道数)]

W filter: 卷积内核的shape [filter_height, filter_width, in_channels, out_channels(输出多少张表)]

strides[0]:样本图片, strides[3]:RGB通道,这两个一般选1, 一般不会跨图片,跨通道,去卷积计算得到一张表

strides[1]代表x方向的步长,strides[2]代表y方向的步长

padding: 一般选"SAME"(不够就补零), "VALID"(不够就跳过)

'''

return tf.nn.conv2d(x, W, strides=[1, 1, 1, 1], padding='SAME')

-

激活函数选择relu函数(大于0就是本身,小于0就改为0)

-

池化

max池化:取窗口里面最大的像素值代替这个区

ksize: 池化窗口的size [1, 2, 2, 1], 表示,池化窗口为 2 x 2 池化(一张一张图片 通道数也是一个一个来, 这两个绝大部分都是1)

strides : 类似上面,步长x上面是2, y上面也是2

2828,池化后就成了 1414 ,也有32张

也就是传入第2次卷积你觉得数据为

[None, 14, 14, 32]

# 池化层

def max_pool_2x2(x):

# ksize [1,x,y,1]

return tf.nn.max_pool(value=x, ksize=[1, 2, 2, 1], strides=[1, 2, 2, 1], padding='SAME')

开始搭建第一层卷积网络

with tf.name_scope("input_data"):

# 定义两个placeholder

# 输入值的特征值784

x = tf.placeholder(tf.float32, [None, 784], name="x")

# 目标值 10个类别

y = tf.placeholder(tf.float32, [None, 10], name='y')

with tf.name_scope('x_image'):

# 改变x的格式转为4D的向量[batch, in_height, in_width, in_channels]`

x_image = tf.reshape(x, [-1, 28, 28, 1], name="x_image")

with tf.name_scope('Conv1'):

# 初始化第一个卷积层的权值和偏置

with tf.name_scope('W_conv1'):

# 随机生成 5*5的采样窗口,黑白图片,一个输入通道, 16个输出通道,16个卷积核从1个平面抽取特征,得到16张特征表

W_conv1 = weight_variable([5, 5, 1, 16], name='W_conv1')

with tf.name_scope('b_conv1'):

# # 每一个卷积核一个偏置值

b_conv1 = bias_variable([16], name='b_conv1')

# 把x_image和权值向量进行卷积,再加上偏置值,然后应用于relu激活函数

with tf.name_scope('conv2d_1'):

# conv2d_1 = [None, 28, 28, 16]

conv2d_1 = conv2(x_image, W_conv1) + b_conv1

# 使用relu激活函数,激活再经过池化

with tf.name_scope('relu'):

# relu: 小于0取0, 大于0取自己,像素值没有小于0的

h_conv1 = tf.nn.relu(conv2d_1)

with tf.name_scope('h_pool1'):

# 进行max-pooling

# tf.nn.max_pool(h_conv1, ksize=[1, 2, 2, 1], strides=[1, 2, 2, 1], padding='SAME')

# max_pool.池化就是取小框里面最大值代替这个框的值

# ksize: 池化窗口的size [1, 2, 2, 1], 表示,池化窗口为 2*2 池化(一张一张图片 通道数也是一个一个来, 这两个绝大部分都是1)

# strides : 类似上面,步长x上面是2, y上面也是2

# h_pool1 = [None, 14, 14, 16]

h_pool1 = max_pool_2x2(h_conv1)

- 第二层卷积

ith tf.name_scope('Conv2'):

# 初始化第二个卷积层的权值和偏置

with tf.name_scope('W_conv2'):

W_conv2 = weight_variable([5, 5, 16, 32], name='W_conv2') # 5*5的采样窗口,32个卷积核从16个平面抽取特征

with tf.name_scope('b_conv2'):

b_conv2 = bias_variable([32], name='b_conv2') # 每一个卷积核一个偏置值

# 把h_pool1和权值向量进行卷积,再加上偏置值,然后应用于relu激活函数

with tf.name_scope('conv2d_2'):

# conv2d_2 = [None, 14, 14, 32]

conv2d_2 = conv2(h_pool1, W_conv2) + b_conv2

with tf.name_scope('relu'):

h_conv2 = tf.nn.relu(conv2d_2)

with tf.name_scope('h_pool2'):

# h_pool2 = [None, 7, 7, 32]

h_pool2 = max_pool_2x2(h_conv2) # 进行max-pooling

# 28*28的图片第一次卷积后还是28*28,第一次池化后变为14*14

# 第二次卷积后为14*14,第二次池化后变为了7*7

# 进过上面操作后得到64张7*7的平面

# 输出的为[None,7,7,64]

- 第一层全连接层网络

with tf.name_scope("fc1"):

# 初始化第一个全连接层的权值

with tf.name_scope('W_fc1'):

# 输入为[None,7,7,64], 用1024个神经元运算

# 上一层有7*7*64个神经元,全连接层有1024个神经元

W_fc1 = weight_variable([7 * 7 * 32, 32], name='W_fc1')

# 1024个神经元就有1024个偏置

with tf.name_scope('b_fc1'):

b_fc1 = bias_variable([32], name='b_fc1') # 1024个节点

# 把池化层2的输出扁平化为1维

with tf.name_scope('h_pool2_flat'):

h_pool2_flat = tf.reshape(h_pool2, [-1, 7 * 7 * 32], name='h_pool2_flat')

# 求第一个全连接层的输出,输入 X 权值 + bias

with tf.name_scope('wx_plus_b1'):

wx_plus_b1 = tf.matmul(h_pool2_flat, W_fc1) + b_fc1

# 激活函数

with tf.name_scope('relu'):

h_fc1 = tf.nn.relu(wx_plus_b1)

# keep_prob用来表示神经元的输出概率

# 控制一部分的神经元在运作

"""

目的:防止过拟合。

在数据量很大的时候,每批次都让所有的权重参加训练更新数值,

最后可能有些还没训练够,有些就过拟合了

让某个神经元的激活值以一定的概率p,让其停止工作,这次训练过程中不更新权值,

也不参加神经网络的计算。但是它的权重得保留下来(只是暂时不更新而已),

因为下次样本输入时它可能又得工作了.

但在测试及验证中:每个神经元都要参加运算,但其输出要乘以概率p。

"""

# 定义占位符

with tf.name_scope('keep_prob'):

keep_prob = tf.placeholder(tf.float32, name='keep_prob')

# keep_prob:0.7,就是让70%的神经元再更新参数

with tf.name_scope('h_fc1_drop'):

h_fc1_drop = tf.nn.dropout(h_fc1, keep_prob, name='h_fc1_drop')

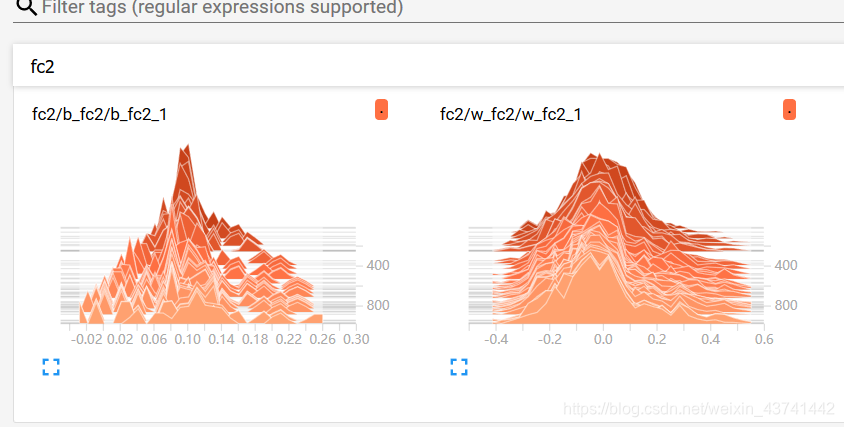

- 第二层全连接层

with tf.name_scope("fc2"):

# 上一层输入为 [None, 1024]

# 这一层要求输出[None, 10],因为有 10 个数字类别

# 故要求weigh = [1024, 10], bias = [10]

# 初始化第2个全连接层

with tf.name_scope('w_fc2'):

w_fc2 = weight_variable([32, 10], name="w_fc2")

# 收集最后一层的权值分布

tf.summary.histogram("w_fc2",w_fc2)

with tf.name_scope("b_fc2"):

b_fc2 = bias_variable(shape=[10], name="b_fc2")

tf.summary.histogram("b_fc2", b_fc2)

# 输入的数据于权值相乘 + bias

with tf.name_scope("wx_plus_b2"):

wx_plus_b2 = tf.matmul(h_fc1_drop, w_fc2) + b_fc2

# 计算输出每一个类别的概率

with tf.name_scope("softmax"):

prediction = tf.nn.softmax(wx_plus_b2)

- loss函数以及优化器

# 计算交叉熵损失函数

with tf.name_scope("loss"):

# 输入真实值跟预测值

loss = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y, logits=prediction), name="loss")

# 收集损失函数的变化

tf.summary.scalar("loss", loss)

# 使用AdamOptimizer进行优化

# with tf.name_scope('train'):

# train_step = tf.train.AdamOptimizer(0.01).minimize(loss)

# 使用梯度下降优化器

with tf.name_scope('train'):

train_step = tf.train.GradientDescentOptimizer(learn_rate).minimize(loss)

- 准确率

# 计算准确率

with tf.name_scope('accuracy'):

with tf.name_scope('correct_prediction'):

# 结果存放在一个布尔列表中, [None, 10]

correct_prediction = tf.equal(tf.argmax(prediction, 1), tf.argmax(y, 1)) # argmax返回一维张量中最大的值所在的位置

with tf.name_scope('accuracy'):

# 求准确率

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

tf.summary.scalar('accuracy', accuracy)

- 开始训练,保存模型

# 合并所有的summary

merged = tf.summary.merge_all()

# 最后开启会话进行训练

with tf.Session() as sess:

# 初始化所有的变量

sess.run(tf.global_variables_initializer())

train_writer = tf.summary.FileWriter("F:/mnist/model/train/", graph=sess.graph)

test_writer = tf.summary.FileWriter("F:/mnist/model/test/", graph=sess.graph)

for i in range(1000):

# 开始训练模型

# 训练模型

batch_xs, batch_ys = mnist.train.next_batch(batch_size)

sess.run(train_step, feed_dict={x: batch_xs, y: batch_ys, keep_prob: 0.5, learn_rate: rate})

# 记录训练集计算的参数

summary = sess.run(merged, feed_dict={x: batch_xs, y: batch_ys, keep_prob: 1.0, learn_rate: rate})

train_writer.add_summary(summary, i)

# 记录测试集计算的参数

batch_xs, batch_ys = mnist.test.next_batch(batch_size)

summary = sess.run(merged, feed_dict={x: batch_xs, y: batch_ys, keep_prob: 1.0, learn_rate: rate})

test_writer.add_summary(summary, i)

if i % 100 == 0:

# 每50次下降一点学习率

rate = rate * 0.93

test_acc = sess.run(accuracy, feed_dict={x: mnist.test.images, y: mnist.test.labels, keep_prob: 1.0, learn_rate: rate})

train_acc = sess.run(accuracy, feed_dict={x: mnist.train.images[:10000], y: mnist.train.labels[:10000],

keep_prob: 1.0})

print("Iter " + str(i) + ", Testing Accuracy= " + str(test_acc) + ", Training Accuracy= " + str(train_acc))