一、概述

GBDT(Gradient Boosting Decision Tree) 又叫 MART(Multiple Additive Regression Tree),是一种迭代的决策树算法,该算法由多棵决策树组成,所有树的结论累加起来做最终答案。它在提出之初就和SVM一起被认为是泛化能力(generalization)较强的算法。GBDT的思想使其具有天然优势可以发现多种有区分性的特征以及特征组合。GBDT主要由三个概念组成:Regression Decision Tree(即DT)、Gradient Boosting(即GB)、Shrinkage(算法的一个重要演进分支,目前大部分源码都按该版本实现)。理解这三个概念后就能明白GBDT是如何工作。

二、DT(Regression Decision Tree回归树)

提到决策树(DT, Decision Tree),绝大部分人首先想到的就是C4.5分类决策树。但如果一开始就把GBDT中的树想成分类树,那就是一条歪路走到黑,千万不要以为GBDT是很多棵分类树。决策树分为两大类,回归树和分类树。前者用于预测实数值,如明天的温度、用户的年龄、网页的相关程度;后者用于分类标签值,如晴天/阴天/雾/雨、用户性别、网页是否是垃圾页面。这里要强调的是,前者的结果加减是有意义的,如10岁+5岁-3岁=12岁;后者则无意义,如男+男+女=男还是女?GBDT的核心在于累加 所有树的结果作为最终结果,而分类树的结果显然是无法累加的。所以 GBDT中的树都是回归树,不是分类树,这点对理解GBDT相当重要,尽管GBDT调整后也可用于分类,但不代表GBDT的树是分类树。下面以对人的性别判别/年龄预测为例来说明,每个实例都是一个已知性别/年龄的人,而特征则包括这个人上网的时长、上网的时段、网购所花的金额等。

作为对比,先说分类树。我们知道C4.5分类树在每次分支时,是穷举每一个feature的每一个阈值,找到使得按照feature<=阈值和feature>阈值分成的两个分支的熵最大的feature和阈值,按照该标准分支得到两个新节点,用同样方法继续分支直到所有人都被分入性别唯一的叶子节点,或达到预设的终止条件,若最终叶子节点中的性别不唯一,则以多数人的性别作为该叶子节点的性别。

回归树总体流程也是类似,不过在每个节点(不一定是叶子节点)都会得到一个预测值。以年龄为例,该预测值等于属于这个节点的所有人年龄的平均值。分支时穷举每一个feature的每个阈值找最好的分割点,但衡量最好的标准不再是最大熵,而是最小化均方差,即每个人的年龄与预测年龄的误差平方和除以N。这很好理解,被预测出错的人数越多,均方差越大,通过最小化均方差能够找到最靠谱的分支依据。分支直到每个叶子节点上人的年龄都唯一或者达到预设的终止条件(如叶子个数上限)。若最终叶子节点上人的年龄不唯一,则以该节点上所有人的平均年龄作为该叶子节点的预测年龄。

三、GB(Gradient Boosting梯度提升)

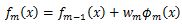

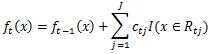

提升树是迭代多棵树来共同决策,怎么实现呢?难道每棵树独立训练一遍,取平均值吗?当然不是,这是投票方法,并不是GBDT,此外只要训练集不变,独立训练三次的三棵树必定完全相同,这样没有意义。GBDT是把所有树的结论累加起来得出最终结论的,其核心在于,每一棵树学的是之前所有树结论之和的残差。比如A的真实年龄是18岁,第一棵树的预测年龄是12岁,差了6岁,即残差为6岁。那么在第二棵树里把A的年龄设为6岁去学习,如果第二棵树真的能把A分到6岁的叶节点,那么累加两棵树的结论就是A的真实年龄;如果第二棵树的结论是5岁,则仍然存在1岁的残差,第三棵树里A的年龄就变成1岁,继续学习。这就是Gradient Boosting的意义。3.1 前向分步算法

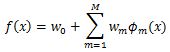

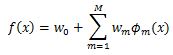

AdaBoost算法是模型为加法模型、损失函数为指数函数、学习算法为前向分步算法的二类分类学习方法,是boosting提升方法的一个特例。Boosting可以表示为

和参数

和参数

时不去修改之前已经求好的分类器和参数。

时不去修改之前已经求好的分类器和参数。

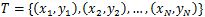

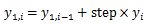

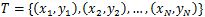

输入:训练数据集

;损失函数

;损失函数

;基函数集

;基函数集

输出:加法模型f(x)

(1) 初始化

(2) 对m=1, 2, …, M

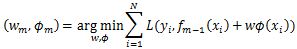

a) 极小化损失函数得到参数

,

,

3.2 各种提升方法

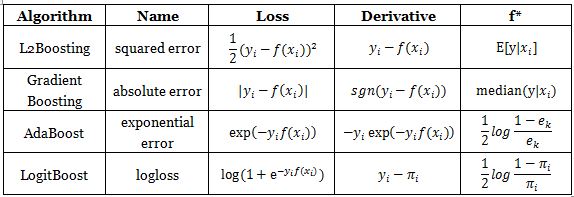

不同的损失函数和极小化损失函数方法决定了boosting算法的最终效果,下面是几个常见的boosting: 此外还有Huber损失和分位数损失,主要用于健壮回归,也就是减少异常点对损失函数的影响。

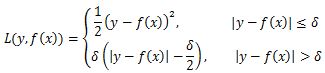

Huber损失是均方差和绝对损失的折衷产物,对于远离中心的异常点,采用绝对损失,而中心附近的点采用均方差。这个界限一般用分位数点度量。损失函数如下:

对应的负梯度误差为:

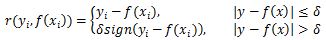

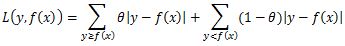

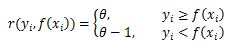

分位数损失对应的是分位数回归的损失函数,表达式为:

其中θ为分位数,需要在回归前指定。对应的负梯度误差为:

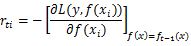

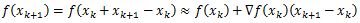

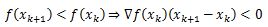

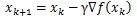

3.3 Gradient Descent

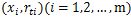

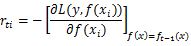

对于一般的损失函数,往往每一步优化没那么容易,如上面的绝对值损失函数。针对这一问题,Freidman提出了梯度提升算法,利用最速下降的近似方法,即利用损失函数的负梯度在当前模型中的值作为回归问题中提升树算法的残差近似值,拟合一个回归树。第t轮第i个样本的损失函数负梯度表示为:

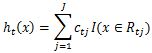

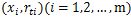

可以拟合一棵CART回归树,得到第t棵回归树,其对应的叶节点区域

可以拟合一棵CART回归树,得到第t棵回归树,其对应的叶节点区域

,其中J为叶节点的个数。

,其中J为叶节点的个数。

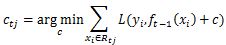

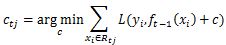

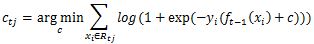

针对每一个叶节点里的样本,求出使损失函数最小,也就是拟合叶节点最好的输出值c_tj如下:

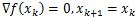

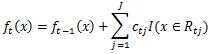

,函数收敛,迭代停止。由于在做泰勒展开时,要求

,函数收敛,迭代停止。由于在做泰勒展开时,要求

足够小,因此需要γ比较小才行,一般设置为0~1的小数。γ也叫做学习率。

足够小,因此需要γ比较小才行,一般设置为0~1的小数。γ也叫做学习率。

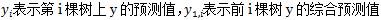

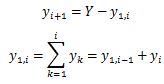

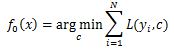

四、Shrinkage

Shrinkage(缩减)的思想认为,每次走一小步逐渐逼近结果的效果,要比每次迈一大步很快逼近结果的方式更容易避免过拟合。即它不完全信任每一棵残差树,认为每棵树只学到了真理的一小部分,累加的时候只累加一小部分,通过多学习几棵树来弥补不足。不使用Shrinkage时,

,Y表示真实值。

,Y表示真实值。

五、GBDT回归算法

输入:训练样本集 ,最大迭代次数T,损失函数L

,最大迭代次数T,损失函数L

输出:强学习器f(x)

(1) 初始化弱学习器

a) 对样本i=1,2,…,N,计算负梯度

可以拟合一棵CART回归树,得到第t棵回归树,其对应的叶节点区域

可以拟合一棵CART回归树,得到第t棵回归树,其对应的叶节点区域

,其中J为叶节点的个数。

,其中J为叶节点的个数。

c) 针叶子区域j=1,2,…,J,计算最佳拟合值:

六、GBDT分类算法

GBDT的分类算法从思想上和GBDT的回归算法没有区别,但是由于样本输出不是连续的值,而是离散的类别,导致无法直接从输出类别去拟合类别输出的误差。为了解决这个问题,主要有两个方法,一个是用指数损失函数,此时GBDT退化为Adaboost算法。另一种方法是用类似于逻辑回归的对数似然损失函数的方法。也就是说,采用类别的预测概率值和真实概率值的差来拟合损失。本文仅讨论用对数似然损失函数的GBDT分类。而对于对数似然损失函数,又有二元分类和多元分类的区别。

6.1 二元GBDT分类算法

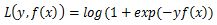

对于二元GBDT,如果用类似于逻辑回归的对数似然损失函数,则损失函数为:

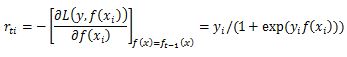

。则此时的负梯度误差为

。则此时的负梯度误差为

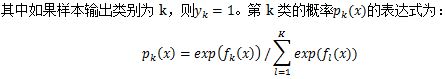

6.2 多元GBDT分类算法

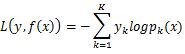

多元GBDT要比二元GBDT复杂一些,对应的是多元逻辑回归和二元逻辑回归的复杂度差别。假设类别数为K,则此时对数似然损失函数为:

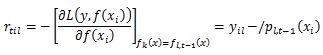

集合上两式,可以计算出第t轮的第i个样本对应类别l的负梯度误差为

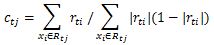

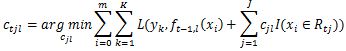

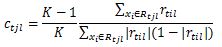

对于生成的决策树,各个叶子节点的最佳残差拟合值为

七、GBDT小结

GDBT本身并不复杂,不过要吃透的话需要对集成学习的原理、策树原理和各种损失函树有一定的了解。由于GBDT的卓越性能,只要是研究机器学习都应该掌握这个算法,包括背后的原理和应用调参方法。目前GBDT的算法比较好的库是xgboost。当然scikit-learn也可以。最后总结下GBDT的优缺点。

GBDT主要的优点有:

1) 可以灵活处理各种类型的数据,包括连续值和离散值。

2) 在相对少的调参时间情况下,预测的准确率也可以比较高。

3) 使用一些健壮的损失函数,对异常值的鲁棒性非常强。比如 Huber损失函数和Quantile损失函数。

缺点:

1) 由于弱学习器之间存在依赖关系,难以并行训练数据。不过可以通过自采样的SGBT来达到部分并行。