0 - Abstract

深度神经网络(DNNs)最近在图像分类任务上表现出了突出的性能。在这篇文章中,我们进一步深入探究使用DNNs进行目标检测的问题,这个问题不仅需要对物体进行分类,并且还需要对各种各样类别的物体进行精确定位。我们提出了简单但依然有效的将目标检测问题形式化为回归问题从而来对物体边界框进行定位。我们提出了一个多尺度推理程序(模型?),它可以通过应用少量网络层来产生高分辨率的具有小误差的目标检测。并在Pascal VOC上展示了当前最好方法的效果。

1 - Introduction

随着我们更加关注完整图像的理解,更加精确和细致的目标识别变得越来越重要。在本文内容中,我们不仅关注图像的分类,同时也关注图像中包含的目标的类别的精确评估及其坐标,该问题成为目标检测问题。

目标检测的主要改进归功于目标表示以及机器学习模型的提升。一个当前最先进的检测系统突出例子是the Deformable Part-based Model(DPM)。它是基于仔细设计的表示以及目标在运动学上的分解而构建起来的图解模型。对图解模型进行分离的学习使得能够对于各种各样的目标类别构造高精度的基于部分(part-based)模型。

结合人工手工设计表示的浅层分离训练模型是关于目标分类的相关问题的最佳范例之一。然而,在过去几年里,深度神经网络(DNNs)作为有利的机器学习模型而出现了。

DNNs展示了与传统分类方法的主要区别。首先,它们的深度架构使得它们相比浅层网络能够学习更加复杂的模型。这种表示性以及健壮性训练算法使得模型能够脱离手工设计特征而学习到有效的目标表示。这通过了ImageNet的上千个类别的分类任务挑战进行了经验上的证明。

在这篇文章中,我们探索DNNs对于目标检测问题的能力,这其中我们不仅解决分类任务,也尝试进行精确目标定位。我们在此提出的这个问题是具有挑战性的,因为我们想要使用有限的计算资源在同一幅图像中检测出潜在的许多具有不同尺寸的目标实例。

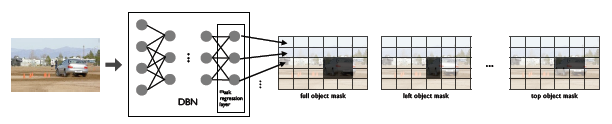

我们提出一种形式化,其能够对于给定的一张图像预测出多个目标的边界框。更准确地说,我们将基于DNN的回归形式化为输出目标边界框的二进制掩码(以及部分盒子 and portions of the box as well),如图1所示。此外,我们实现了一个简单的边界框推理去从掩码中提取检测结果。为了提高定位的准确率,我们DNN掩码生成器应用在完整图像的多尺度表示以及小数量的大图片切片上,后续跟着一个精心制作的步骤(见于图2)。用这种方法,只需要经过一些DNN回归我们就获得了当前最佳的边界框定位性能。

图1:基于DNN的回归模型的目标检测框图

图2:在对多个尺度和大图像框的目标掩码进行回归后,我们进行目标边界框提取。获得的边界框通过在子图像(通过当前对象边界框进行裁剪)上重复应用相同的程序来进行确认。为了简洁起见,我们只显示了完整的对象掩码,但我们使用了所有五个对象的掩码。

在这篇文章中,我们证明了基于DNN的回归模型是有能力学习特征的,其不只是胜任分类任务,也能够捕获有效的几何信息。我们使用用来做分类任务的通用架构,而将其最后一层替换成一个回归层。是我们有几分惊喜同时也有效的是该网络在一定程度能够在编码的同时保持不变性并且也能够捕获目标的位置。

其次,我们介绍了多尺度边界框推理加上一个精心设计的步骤来产生精确的检测。用这种方法,我们能够应用DNN来预测一个低分辨率的受限于输出层尺寸掩码而在像素方面的准确率上只有少量的误差——每一张输入图片只应用了少量次数的该网络。

另外,现在的方法很简单。它不需要手工设计一个模型去捕获部分的以及它们之间明确的联系的信息。这种简单性的优点不仅容易适用于广泛的类别,而且对于更大范围的目标检测中显示了更好的性能——不管对于固定的还是变化的对象。在Sec. 7中在Pascal VOC挑战上比较了该模型与当前最先进的检测结果。