在OpenCV中,可以使用calibrateCamera函数,通过多个视角的2D/3D对应,求解出该相机的内参数和每一个视角的外参数。

使用C++接口时的输入参数如下:

objectPoints - 每一个视角中,关键点的世界坐标系。可以使用vector < vector <Point3f> >类型,第一层vector表示每一个视角,第二层vector表示每一个点。

如果使用OpenCV自带的棋盘格,可以直接传入交叉点(不包括边角)的实际坐标,以物理世界尺度(例如毫米)为单位。

写坐标时,要保证z轴为0,按照先x变化,后y变化,从小到大的顺序来写。如果网格尺寸为5厘米,写作:(0,0,0),(5,0,0), (10,0,0)...(0,5,0), (5,5,0), (10,5,0),...

如下图例子,x方向是8个交叉点,y方向3个较差点。

imagePoints - 每一个视角中,关键点的图像坐标系。可以使用vector < vector <Point2f> >类型。

这个值可以通过findChessboardCorners函数从图像中获得。注意:传入findChessboardCorners函数的patternSize参数,要和objectPoints中的行列数统一。

imageSize - 图像尺寸。

flags - 参数。决定是否使用初始值,扭曲参数个数等。

输出参数如下:

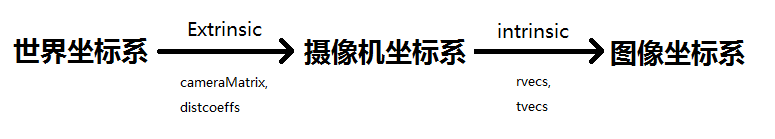

cameraMatrix - 3*3的摄像机内矩阵。

distCoeffs - 4*1(具体尺寸取决于flags)。对图像坐标系进行进一步扭曲。

这两个参数是内参数,可以把摄像机坐标系转换成图像坐标系。

rvecs - 每一个视图的旋转向量。vector<Mat>类型,每个vec为3*1,可以用Rodrigues函数转换为3*3的旋转矩阵。

tvecs - 每一个视图的平移向量。vector<Mat>类型,每个vec为3*1。

这两个参数是外参数,每一个视图不同,可以把世界坐标系转换成摄像机坐标系。

* 在2.10文档中,写的是from the model coordinate space (in which object points are specificed) to the world coordinate space。提到model容易引起歧义。

看到这里,问题来了:这个世界坐标系是什么样的?

在objectPoints中,我们实际只设定了每个交叉点的间隔,具体xyz指向哪里却没有给出。

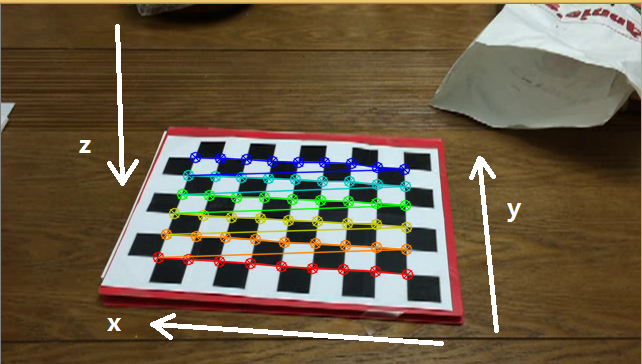

这时候,需要使用drawChessboardCorners函数,把检测到的2D点在原图上显示出来:

这个函数按照先变化x,而后变化y的方式依次画点。先画的行为红色,逐渐变为蓝色。

回顾我们写objectPoints时的方式,可以推断出世界坐标的方向:图中x轴正方向向左,y轴正方向远离镜头,根据右手螺旋,z轴正方向向下。

总结来说,calibrateCamera函数给出的世界坐标方向,是由obejctPoints的设定顺序,以及findChessboardCorners的检测顺序共同决定的。

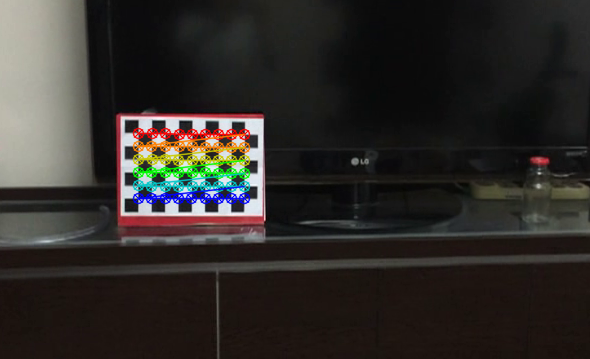

但是,findChessboardCorners先检测那个角点并不确定。前例从右下角开始,以下就从左上角开始:

另一种常见用法是:先用calibrateCamera标定好摄像机内参,而后使用solvePnP函数只求解外参。solvePnP函数的参数意义和calibrateCamera类似。

https://blog.csdn.net/shenxiaolu1984/article/details/50165635