目录

LRCV(LogisticRegressionCV )- 逻辑回归

RLR(RandomizedLogisticRegression)-随机逻辑回归

logistic回归--因变量一般有1和0两种取值,将因变量的取值范围控制再0-1范围内,表示取值为1的概率。

数据源一般是这种类型(其中前8列是自变量,最后一列是因变量,因变量一般是0/1):

| 年龄 | 婚姻状况 | 子嗣 | 工龄 | 住宅类型 | 房产类型 | 月收入 | 合同金额 | 是否逾期 |

| 47 | 2 | 1 | 25 | 4 | 3 | 12800 | 50627 | 0 |

| 40 | 2 | 1 | 7 | 1 | 1 | 50000 | 28573 | 1 |

| 45 | 2 | 1 | 8 | 5 | 4 | 40000 | 57088 | 1 |

| 55 | 2 | 1 | 10 | 5 | 4 | 150000 | 58835 | 1 |

| 37 | 3 | 1 | 7 | 2 | 1 | 40000 | 57146 | 1 |

| 62 | 2 | 1 | 21 | 2 | 1 | 5600 | 42859 | 1 |

| 38 | 3 | 2 | 5 | 4 | 3 | 2800 | 54717 | 0 |

在sklearn ,与逻辑回归有关的主要有三类:LogisticRegression(LR)、LogisticRegressionCV (LRCV)、logistic_regression_path。

LR和LRCV的主要区别是LRCV使用了交叉验证来选择正则化系数C,而LR需要自己每次指定一个正则化系数。例如这样:

model = LogisticRegression(C=0.000001);除此之外,两者用法基本相同。

logistic_regression_path比较特殊,它只能提供逻辑回归后最佳拟合函数的系数,不能直接给出预测结果,这有点不潮流。因此这里不做讲述,对比一些其他网站会发现,logistic_regression_path只是作为一个名字存在了。

除了上述三个类之外,这里还讲到了MLPRegressor(MLP)和RandomizedLogisticRegression(RLR)。

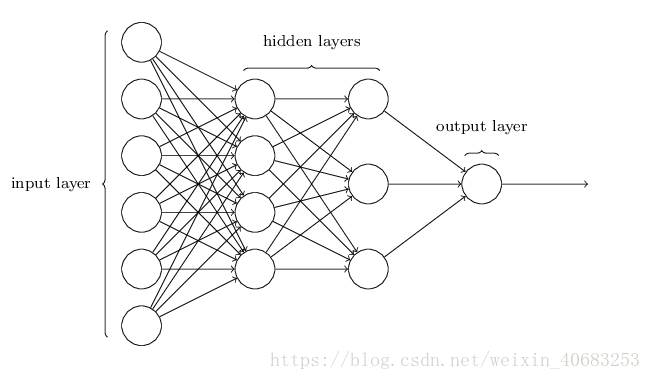

MLP即多层感知器,是一种前向结构的人工神经网络,映射一组输入向量到一组输出向量(如下图所示)。但是由于MLP的学习过程过于简单,大家一般不会单独拿来用,但是对于deep learning新手来说,还是可以入个门的。

RLR看起来特别像LR的兄弟,但是RLR属于维度规约的算法类,不属于我们常说的分类算法的范畴。在本例中,由于我们选择了8个自变量,但是其中或许有不必要的自变量,我们需要通过维度规约(降维)来丢弃无用的自变量,这样可以降低算法存储量和时间的复杂度,优化模型。

LR(LogisticRegression) - 线性回归

代码实现:

# -*- coding:utf-8 -*-

from __future__ import division

import pandas as pd

datafile = u'E:\\pythondata\\data\\ycshk2.csv'#文件所在位置,u为防止路径中有中文名称,此处没有,可以省略

data = pd.read_csv(datafile)#datafile是excel文件,所以用read_excel,如果是csv文件则用read_csv

x = data.iloc[:,:8].as_matrix()#第1列到第7列的所有行

selection = [v for v in range(len(x)) if v % 10 != 0]#训练集所在的行数,只是一个索引,没有取到对应行的数据

selection2 = [v for v in range(len(x)) if v % 10 == 0]#每隔10行取一行作为检验集,v表示所在的行数,只是一个索引,没有取到对应行的数据

x2 = x[selection, :]#训练集数据-因素

x3 = x[selection2, :]#检验集数据-因素

y = data.iloc[:,-1:].as_matrix()#最后一列

y2 = y[selection, :]#训练集数据-结果

y3 = y[selection2, :]#检验集数据-结果

print(x2)

print(y2)

from sklearn.linear_model import LogisticRegression as LR

#创建逻辑回归对象(3种情况:1.自设参数;2.balanced; 3.默认参数

##########################################################

# 1 .自己设置模型参数

#penalty = {0: 0.2, 1: 0.8}

#lr = LR(class_weight = penalty)#设置模型分类的权重为penalty

# 2. 选择样本平衡-balanced

#lr = LR(class_weight='balanced')#样本平衡

# 3. 默认参数,class_weight=none

lr = LR()

##############################################################

# 调用LogisticRegression中的fit函数/模块用来训练模型参数

lr.fit(x2, y2)

print(u'逻辑回归模型筛选特征结束。')

#通过检验集和预测模型来判断准确率

y22 = lr.predict(x2)#用训练集x2的数据通过模型进行预测,结果储存在变量y22中。

print(u'模型的平均准确率(训练集)为:%s'% lr.score(x2, y2))#使用逻辑回归模型自带的评分函数score获得模型在测试集上的准确性结果。

print(u'模型的平均准确率(训练集,y=0)为:%s'% (sum(y22[i] == 0 for i,v in enumerate(y2) if v == 0) / sum(1 for i,v in enumerate(y2) if v == 0)))

print(u'模型的平均准确率(训练集,y=1)为:%s'% (sum(y22[i] == 1 for i,v in enumerate(y2) if v == 1) / sum(1 for i,v in enumerate(y2) if v == 1)))

#上述准确率计算的解释:enumerate()表示遍历y2中的数据下标i和数据v,若y2[i]=v==0,且y22[i]==0,则求和,

#类似统计在预测变量y22中,预测结果与原结果y2是一致为0的个数,除以y2中所有为0的个数,得到预测变量y22的准确率

y32 = lr.predict(x3)#用检验集x3的数据通过模型进行预测,结果储存在变量y32中。

print(u'模型的平均准确率(检验集)为:%s'% lr.score(x3, y3))#使用逻辑回归模型自带的评分函数score获得模型在测试集上的准确性结果。

print(u'模型的平均准确率(检验集,y=0)为:%s'% (sum(y32[i] == 0 for i,v in enumerate(y3) if v == 0) / sum(1 for i,v in enumerate(y3) if v == 0)))

print(u'模型的平均准确率(检验集,y=1)为:%s'% (sum(y32[i] == 1 for i,v in enumerate(y3) if v == 1) / sum(1 for i,v in enumerate(y3) if v == 1)))

print(lr)#查看模型

print(lr.coef_)#查看模型的最佳拟合曲线各变量的参数

print(lr.intercept_)#查看模型的最佳拟合曲线的截距(常数项)

#y2 = lr.predict_proba(x)准确率对比:

1.自设参数:模型的平均准确率为:0.9563838146700168

2.banlance:模型的平均准确率为:0.5679417157381089

3.默认参数:模型的平均准确率为:0.9563838146700168

权重怎么设置和业务紧密相关,但是在这里我的自设参数和默认参数得到的结果是一样的,不知何故???

LRCV(LogisticRegressionCV )- 逻辑回归

两种算法基本相同,因此将上述代码中的

“from sklearn.linear_model import LogisticRegression as LR”

改为“from sklearn.linear_model import LogisticRegressionCV as LRCV”

“lr = LR()”改为“lr = LRCV()”,即可!

MLP(MLPRegressor) - 人工神经网络

上述两段代码改为:

from sklearn.neural_network import MLPRegressor as MLP

lr = MLP(activation='tanh', learning_rate='adaptive')#创建mlp神经网络对象RLR(RandomizedLogisticRegression)-随机逻辑回归

代码实现:

#-*- coding: utf-8-*-

import pandas as pd

datafile = u'E:\\pythondata\\kehu.xlsx'#文件所在位置,u为防止路径中有中文名称,此处没有,可以省略

data = pd.read_excel(datafile)#datafile是excel文件,所以用read_excel,如果是csv文件则用read_csv

x = data.iloc[:,:8].as_matrix()#第1列到第8列

y = data.iloc[:,8].as_matrix()#第9列

from sklearn.linear_model import RandomizedLogisticRegression as RLR

rlr = RLR()

rlr.fit(x, y)#训练模型

rlr.get_support(indices=True)

print(u'通过随机逻辑回归模型筛选特征结束。')

print(u'有效特征为:%s'%','.join(data.columns[rlr.get_support(indices=True)]))

x = data[data.columns[rlr.get_support(indices=True)]].as_matrix()这个代码需要注意的是,.join(data.columns[rlr.get_support(indices=True)]这部分的包更新删减了,因此会报错。