本文关于深度学习的softmax函数做了详细的介绍,并给出深度学习中损失函数的对比链接。

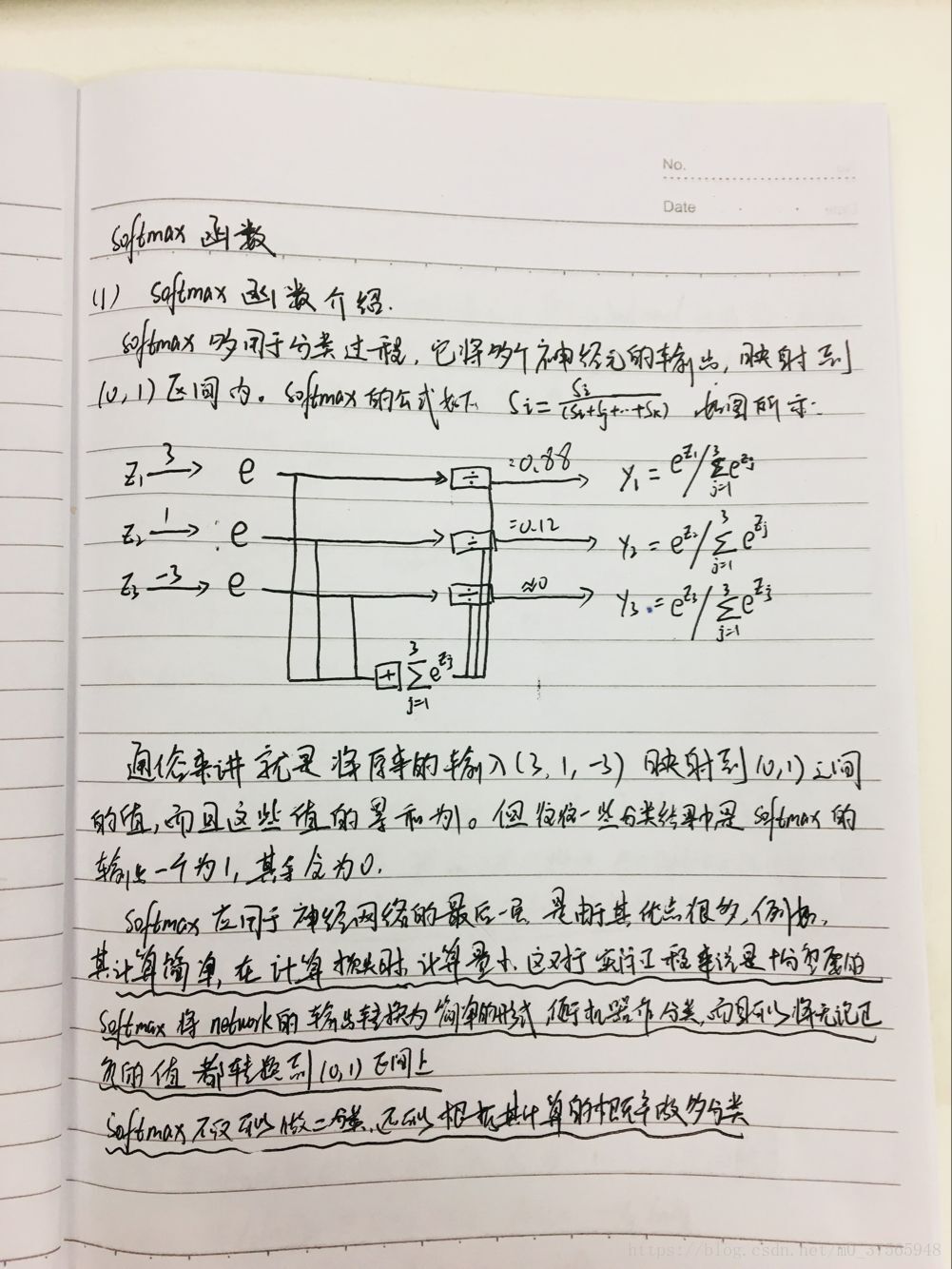

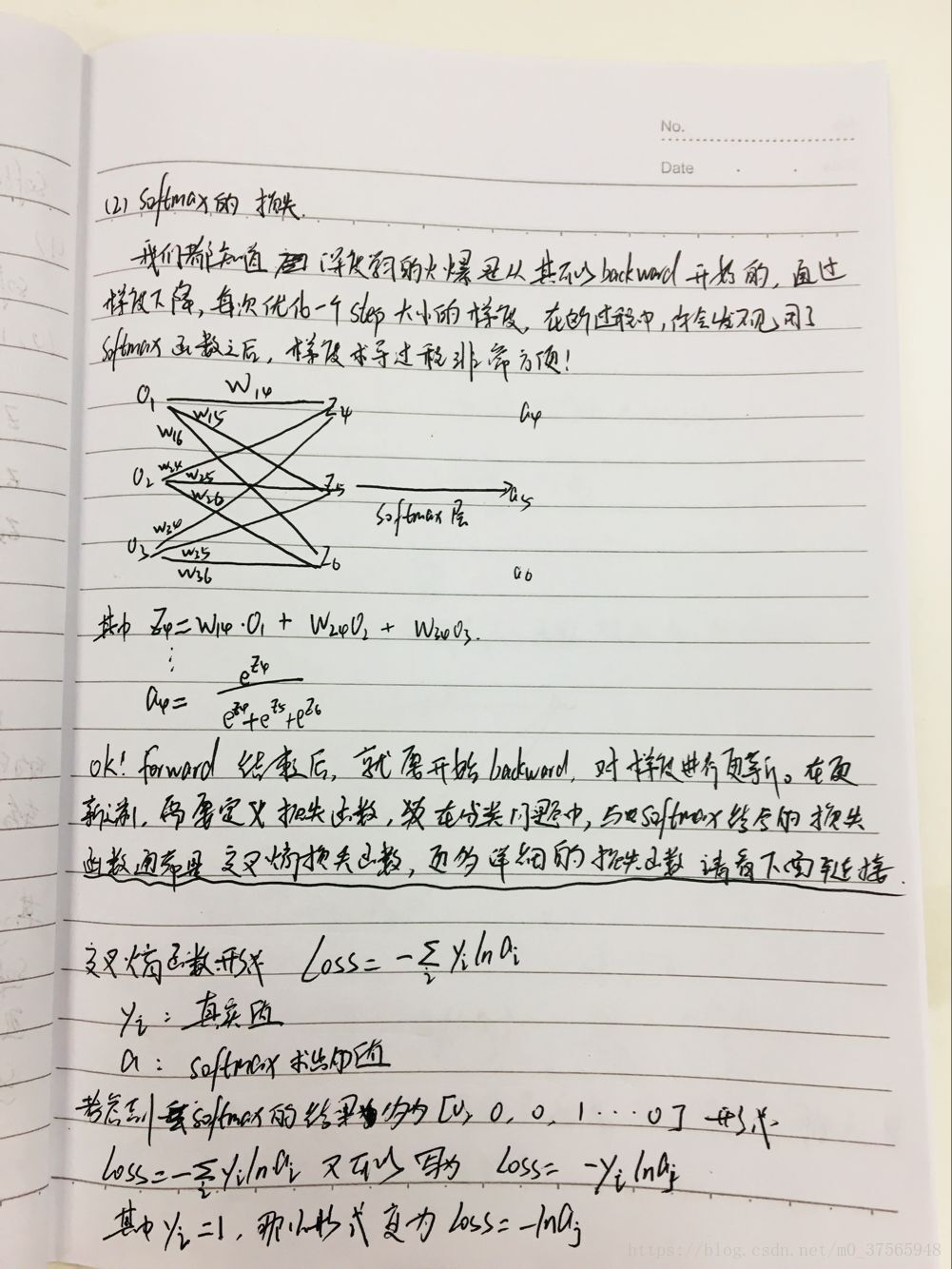

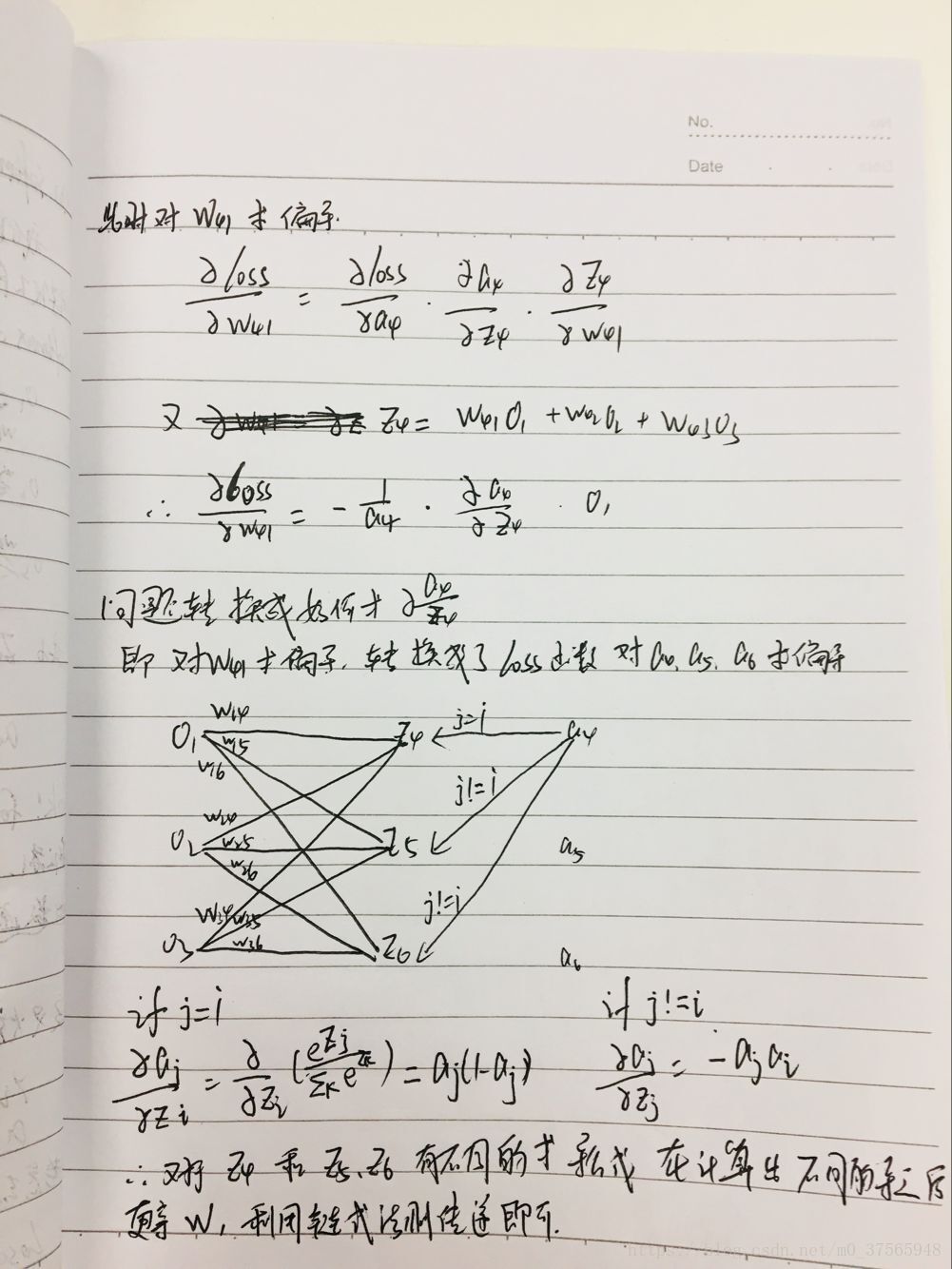

一、Softmax详解

二、Logistic函数

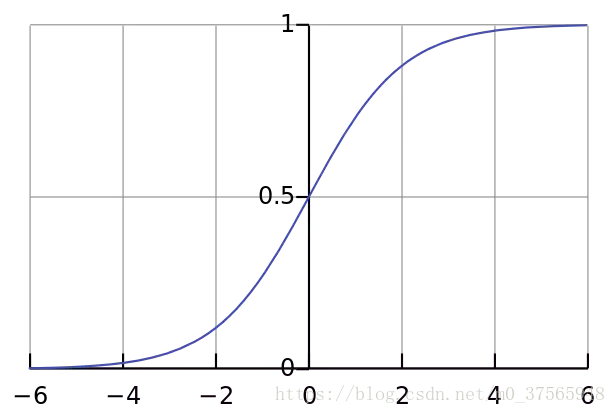

Logistic函数又称逻辑斯谛函数,也就是经常说的sigmoid函数,它的几何形状也就是一条sigmoid曲线。

logistic函数的公式形式如下:

logistic函数的图像如下:

是一条值区间为[0, 1]的曲线

在传统的机器学习和统计学习中Logistic作为一种对数线性模型被广泛的应用于分类和回归场景中。此外Logistic函数也是神经网络中最常用的激活函数,即Sigmod函数。

三、Softmax和Logistic的关系

(1)Logistic具体针对的是二分类问题,而softmax针对的是多分类问题

(2)从概率角度来看,softmax建模使用的分布是多项式分布,而logistic则基于伯努利分布

(3)多个logistic回归通过叠加也同样可以实现多分类的效果,softmax回归进行的多分类,类与类之间是互斥的,即一个输入只能被归为一类,多个logistic回归进行多分类,输出的类别并不是互斥的,即"苹果"这个词语既属于"水果"类也属于"3C"类别。