来源 | 机器之心 ID | almosthuman2014

说到科技圈的近期新闻,没有比小马和小扎约架这件事更热闹的八卦话题了。

前几天,马斯克直播了自己上门寻找扎克伯格的过程。虽然最终无功而返,但小马显然 “醉翁之意不在酒”,而是想借机展示特斯拉最新的 FSD V12 自动驾驶功能。

可就在小马得意洋洋的向观众介绍时,自动驾驶系统却出了状况,在一个路口时作出了错误的判断,逼得小马手动干预了驾驶。小马尴尬地表示要 “给网络喂更多的相关数据”。

马斯克演示 FSD V12 时,唯一一次人工干预发生在交通环境复杂的路口

可见强如特斯拉的 FSD v12,也存在处理复杂场景时决策推理能力不足的问题。这让人不禁想问,有没有什么办法能解决这一难题?

上海人工智能实验室 OpenDriveLab 认为,要解决这一难题,引入时下大热的大模型可能是一个解决方案。

DriveLM | 动机

大模型已经在自然语言处理问题上证明了自己的威力。然而要想让它大显神威,海量数据必不可少。在自动驾驶领域,通过量产车大规模采集数据来支持自动驾驶系统的想法尚停留在建设阶段,各家车厂间的竞争也使得数据集的开源共享变得不切实际。

但如果换一个角度思考,大语言模型中的推理范式和常识在现实世界是通用的。如果能利用起现有的成熟大语言模型和海量语料数据库,再加上 CoT(Chain of Thought)、GoT (Graph of Thougtht) 等推理 Prompt 技术,站上巨人的肩膀,就可以让自动驾驶系统应对复杂状况的能力更上一层楼。

据此,上海人工智能实验室 OpenDriveLab、德国图宾根大学 Autonomous Vision Group、德国图宾根 AI Center 联合推出了世界首个语言 + 自动驾驶全栈开源数据集——DriveLM,旨在借助大语言模型和海量自然语言数据集,构筑复杂场景下安全、精准、可解释的自动驾驶系统,突破现有自动驾驶推理能力上限。

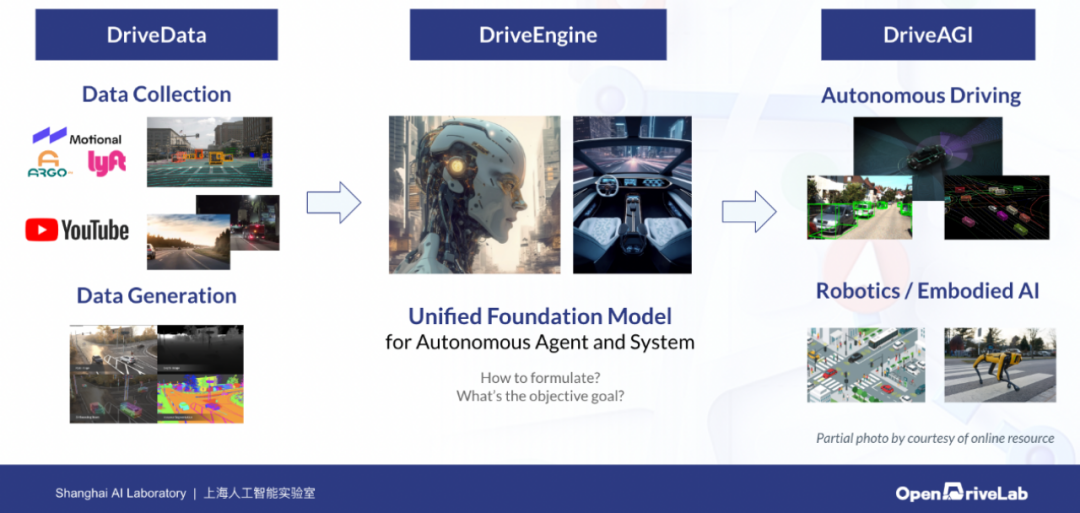

同时,DriveLM 也是 OpenDriveLab 提出的 DriveAGI 的重要组成部分。OpenDriveLab 之后将围绕 DriveLM 举办一系列语言 + 自动驾驶竞赛,以推动自然语言处理领域和自动驾驶领域的交流与技术交叉进步。

OpenDriveLab 提出的 DriveAGI 总体框架

不过今天,机器之心先带大家一起来看看这个融合语言信息的自动驾驶数据集是如何在大语言模型和自动驾驶系统之间搭建起桥梁,让大语言模型帮助自动驾驶系统获得更强大的、可解释的推理能力的。

Repository:https://github.com/OpenDriveLab/DriveLM

Page:https://opendrivelab.github.io/DriveLM

Hugging Face:https://huggingface.co/datasets/OpenDrive/DriveLM

DriveLM | 特点

-

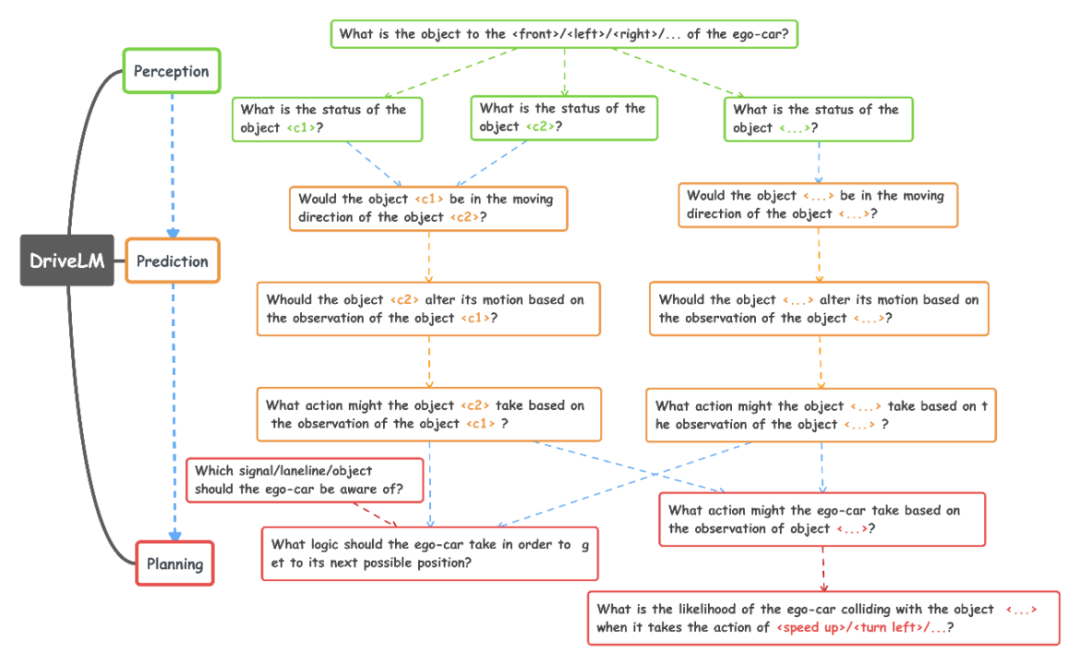

结构化推理与思维图评测

DriveLM 提供了量化的推理能力评估标准,改变了模型的结构化推理(Structured-reasoning)或思维图(Graph of Thoughts)能力难以量化评估的现状。如下图所示,DriveLM 提供了从物体识别、物体运动状态判断到物体未来运动轨迹预测、自车运动规划的完整逻辑链条,确保了整个决策过程中每一步的合理性和可解释性。

-

全栈数据覆盖

DriveLM 的标注覆盖了自动驾驶系统中的感知(perception)、预测(prediction)、规划(planning)等模块,为整个自动驾驶系统提供了全栈式的语言标注数据。

-

假设推理

DriveLM 的标注中包含了基于假设进行推理的内容("What if..."),这有助于训练模型对尚未发生的未来事件进行预判。

-

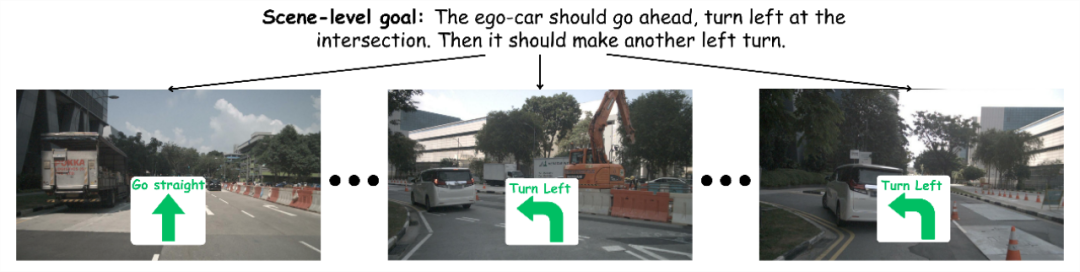

驾驶目标分解

DriveLM 提供了场景级别的全局驾驶目标描述和对应的帧级别的驾驶目标描述,引入了驾驶目标分解任务。通过将复杂的宏观驾驶任务分解为更具体、更简单的子任务,让自动驾驶系统学会应对更复杂多变的交通环境。

DriveLM | 数据与标注

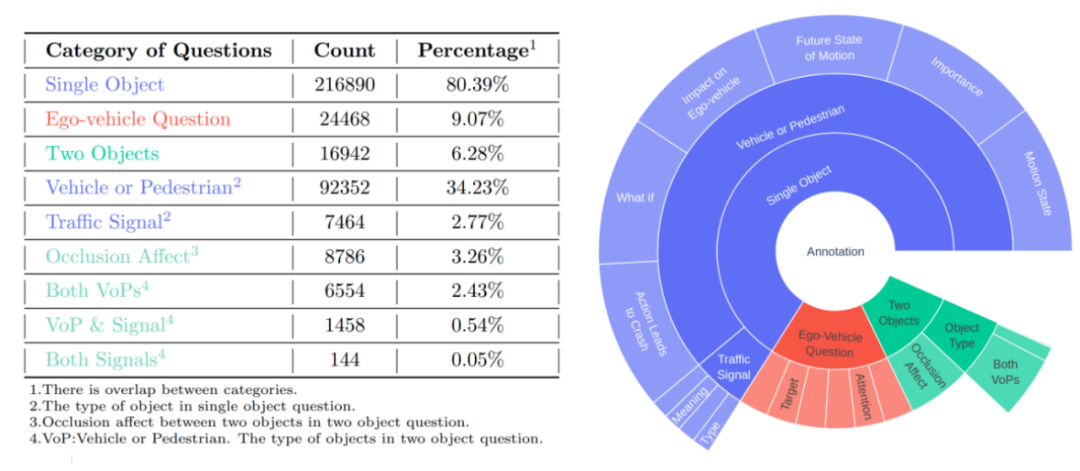

DriveLM 标注中不同类别问题的分布情况

DriveLM 是一个基于 nuScenes 自动驾驶数据集构建的、以关键帧描述 + 问答对(Description+Q&A)为核心的数据集。

数据集中的问答对主要可以分为三类:感知(Perception)、预测(Prediction)和规划(Planning)。感知部分着重于询问物体相对自车的位置或运动状态;预测部分询问车辆或行人的未来可能行为和状态;规划部分询问自车可以采取的行动。

整个数据集分为训练集和验证集两部分,训练集共包含 697 个场景,验证集包含 150 个场景。每个场景包含大约 40 帧(采样频率约为 2 赫兹),标注员会在其中选择 4-8 个关键帧进行标注。

想要了解数据集的更多细节,请参考 OpenDriveLab 发布在 Github 上的 DriveLM 演示数据。