基本只关注开源大模型资料,非开源就不关注了,意义也不大。

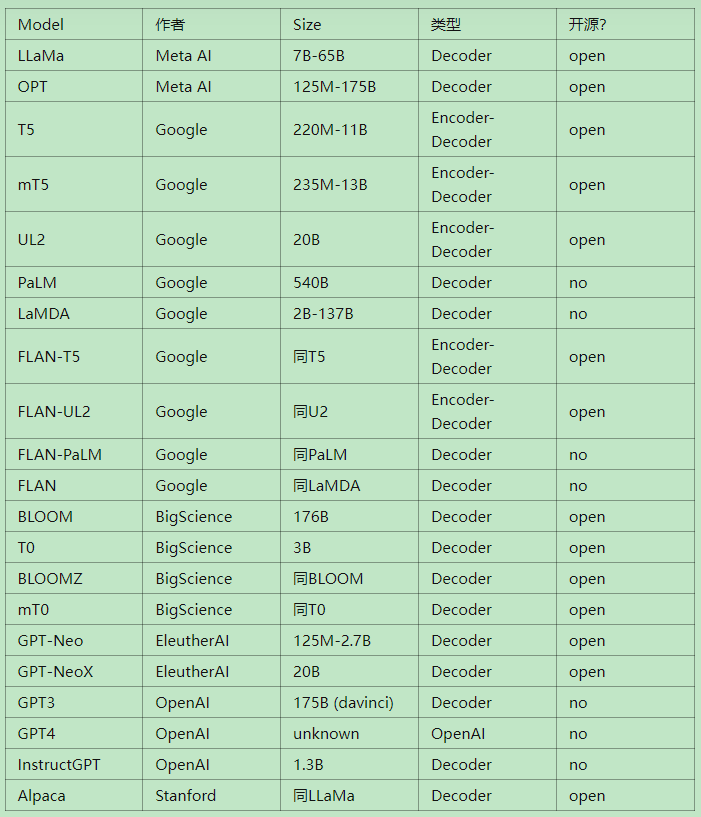

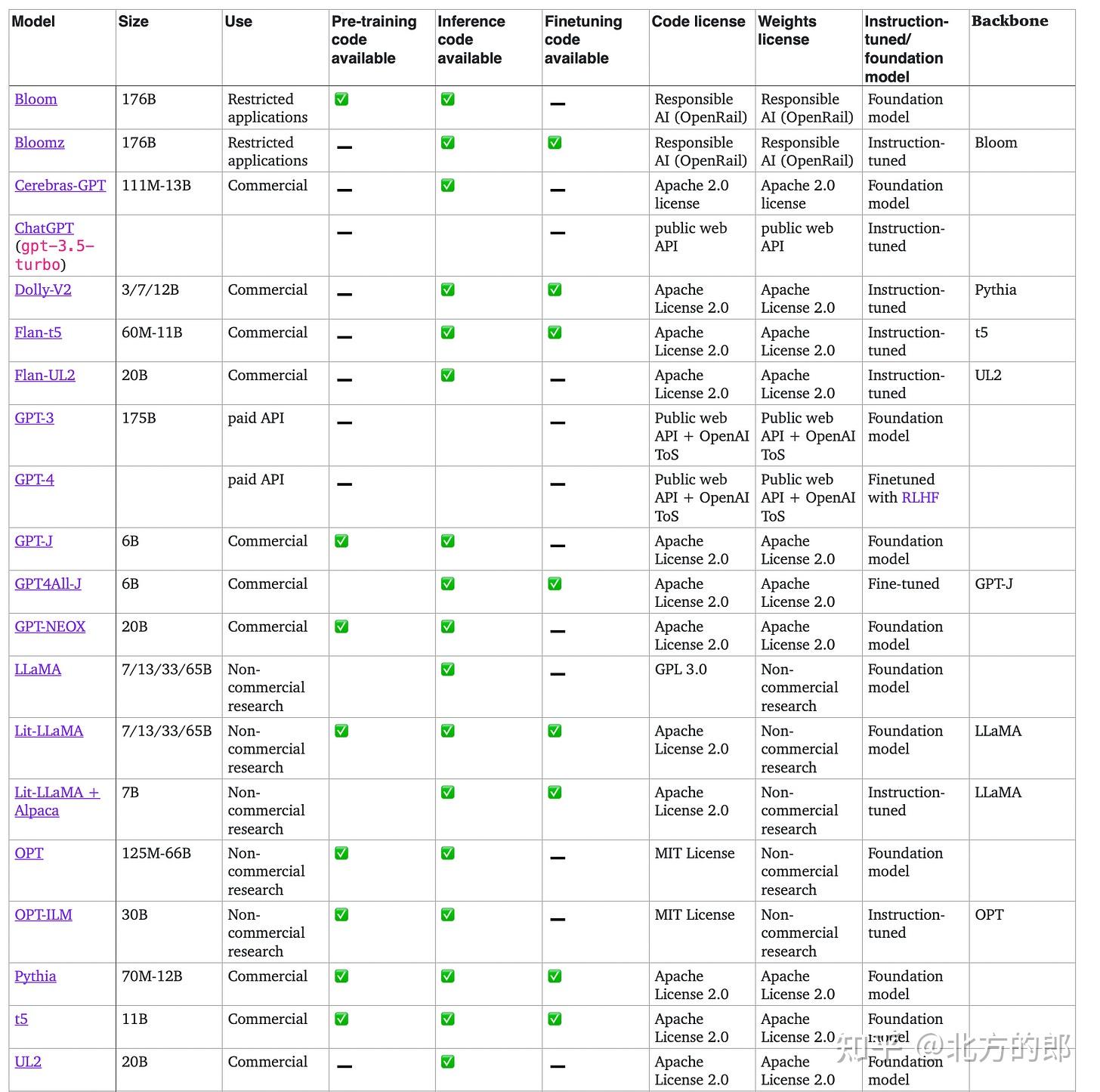

基座大模型:

LLaMA:7/13/33/65B,1.4T token

GLM:6/130B,

ChatGLM基座:GLM(General Language Model)

GPT-J:

OPT:125M、350M、1.3B、2.7B、6.7B、13B、30B、66B、175B 9个不同的参数规模和版本,175B需要申请

BLOOM:BLOOM-560M、BLOOM-1.1B、BLOOM-1.7B、BLOOM-3B、BLOOM-7.1B

对话大模型:

中文

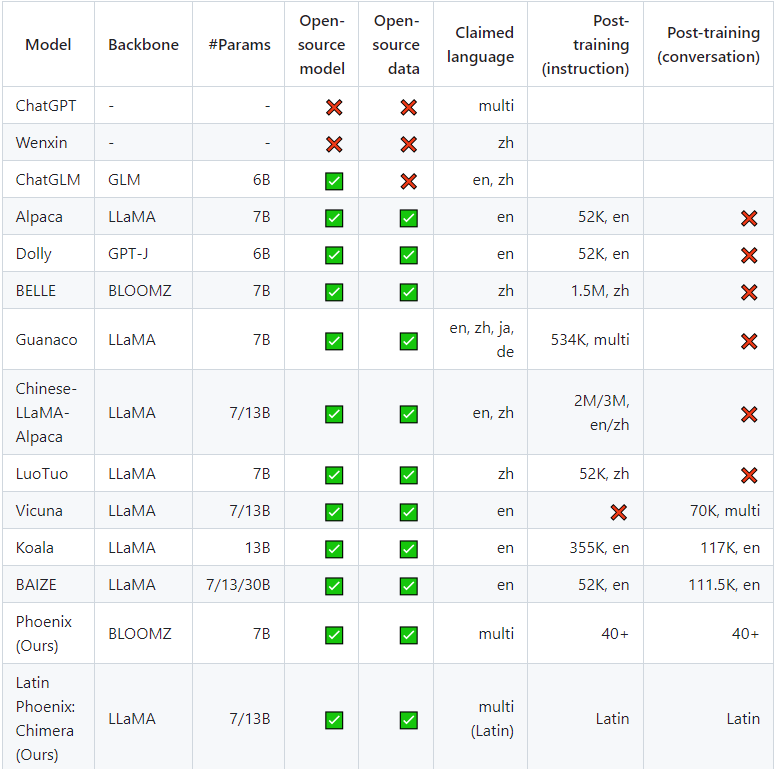

chatglm,GLM,6B,中/英:

GitHub - LemonQu-GIT/ChatGLM-6B-Engineering: ChatGLM-6B Prompt Engineering Project

GitHub - yanqiangmiffy/InstructGLM: ChatGLM-6B 指令学习|指令数据|Instruct

https://github.com/liucongg/ChatGLM-Finetuning

GitHub - mymusise/ChatGLM-Tuning: 一种平价的chatgpt实现方案, 基于ChatGLM-6B + LoRA

GitHub - hiyouga/ChatGLM-Efficient-Tuning: Fine-tuning ChatGLM-6B with PEFT | 基于 PEFT 的高效 ChatGLM 微调

BELLE,BLOOMZ,7B,中,instruction:1.5M

GitHub - LianjiaTech/BELLE: BELLE: Be Everyone's Large Language model Engine(开源中文对话大模型)

Guanaco,LLaMA,7B,中/英,instruction:534k,

Chinese-LLaMA-Alpaca,LLaMA,7/13B,中英,instruction:2/3M,

https://github.com/ymcui/Chinese-LLaMA-Alpaca

Luotuo,LLaMA,7/13B,中,instruction:52k

https://github.com/LC1332/Luotuo-Chinese-LLM

Phoenix,BLOOMZ,7B,中英,instruction:40+,conversation:40+

HuatuoGPT,

Chinese-Vicuna:

Ziya-LLaMA-13B-v1:

Linly LLaMa

Chinese chat T5:

GitHub - core-power/Chinese_Chat_T5_Base: 中文聊天小模型,用t5 base在大量数据上有监督。

Firefly,BLOOM

GitHub - yangjianxin1/Firefly: Firefly(流萤): 中文对话式大语言模型

英文:

Alpaca,LLaMA,7B,instrucation:52k,

Dolly,GPT-J,6B,intruction:52k,

https://github.com/databrickslabs/dolly

Vicuna,LLaMA,7/13B,conversation:70k,

Koala,LLaMA,13B,instruction:355k,conversation:117k

成本不到100美元!UC伯克利再开源类ChatGPT模型「考拉」:数据量大没有用,高质量才是王道 - 知乎

BAIZE,LLaMA,7/13/30B,instruction:52k,conversation:111.5k

https://github.com/project-baize/baize-chatbot

Deepspeed Chat,OPT

DeepSpeed/README.md at master · microsoft/DeepSpeed · GitHub

多模态:

VPGTrans

VPGTrans: 用10%的成本定制一个你自己的GPT4多模态对话模型

MiniGPT-4:

LLaVA:

VisualGLM-6B:

VisionLLM:

MMGPT:

MMGPT (Multi-modal GPT) 安装指南和初体验 - 知乎

OpenFlamingo:

GitHub - mlfoundations/open_flamingo: An open-source framework for training large multimodal models.

X-LLM:

中科院发布多模态 ChatGPT,图片、语言、视频都可以 Chat ?中文多模态大模型力作

测评:

C-EVAL:

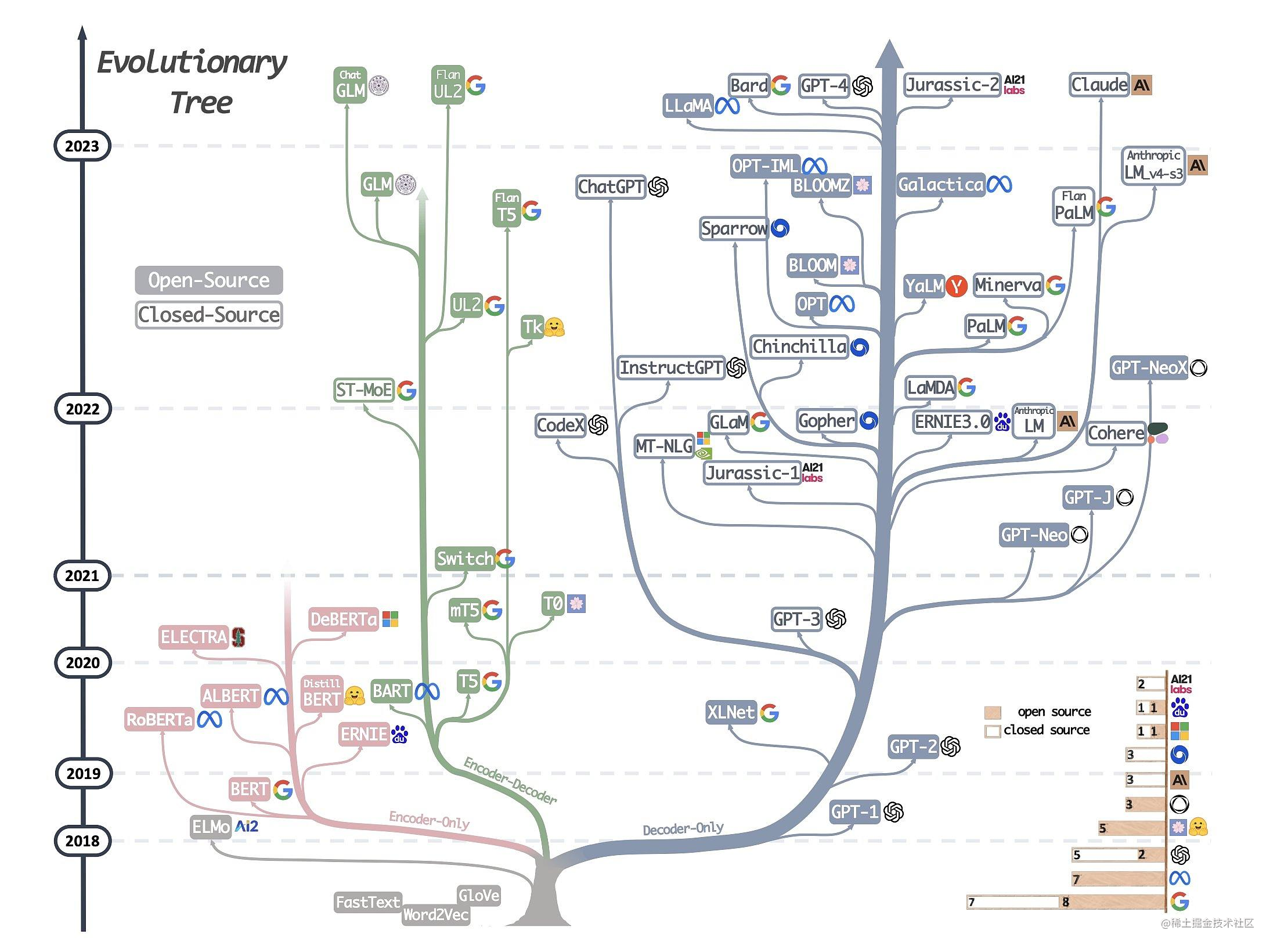

综述: