一、文章摘要

卷积神经网络(CNN)由于能够捕捉空间-光谱特征表示,在高光谱(HS)图像分类中受到越来越多的关注。然而,他们对样本之间关系建模的能力仍然有限。除了网格采样的局限性,最近提出了图卷积网络(GCN),并成功地应用于不规则(或非网格)数据的表示和分析。在本文中,我们从HS图像分类的角度对CNN和GCN(定性和定量)进行了深入研究。由于在所有数据上构造邻接矩阵,传统的GCN通常会遭受巨大的计算成本,尤其是在大规模遥感(RS)问题中。为此,我们开发了一种新的小批量GCN(以下称为小批量GCN),它允许以小批量方式训练大规模GCN。更重要的是,我们的miniGCN能够在不重新训练网络和提高分类性能的情况下推断出样本数据。此外,由于CNN和GCN可以提取不同类型的HS功能,打破单一型号性能瓶颈的直观解决方案是将它们融合在一起。由于MiniGCN可以执行分批网络训练(支持CNN和GCN的组合),我们探索了三种融合策略:加法融合、元素乘法融合和级联融合,以测量获得的性能增益。在三个HS数据集上进行的大量实验证明了MiniGCN优于GCN,以及测试的融合策略相对于单个CNN或GCN模型的优越性。

二、文章创新点

1、第一次在调查GCN(与CNN相比)的潜力和缺点。

2、提出了一种新的GCN监督版本:简称miniGCNs。顾名思义,miniGCNs可以以小批量的方式进行训练,试图找到更好、更健壮的局部最优解。与传统的GCN不同,miniGCN不仅能够使用训练集训练网络,而且还允许使用训练模型直接推断大规模样本外的网络。

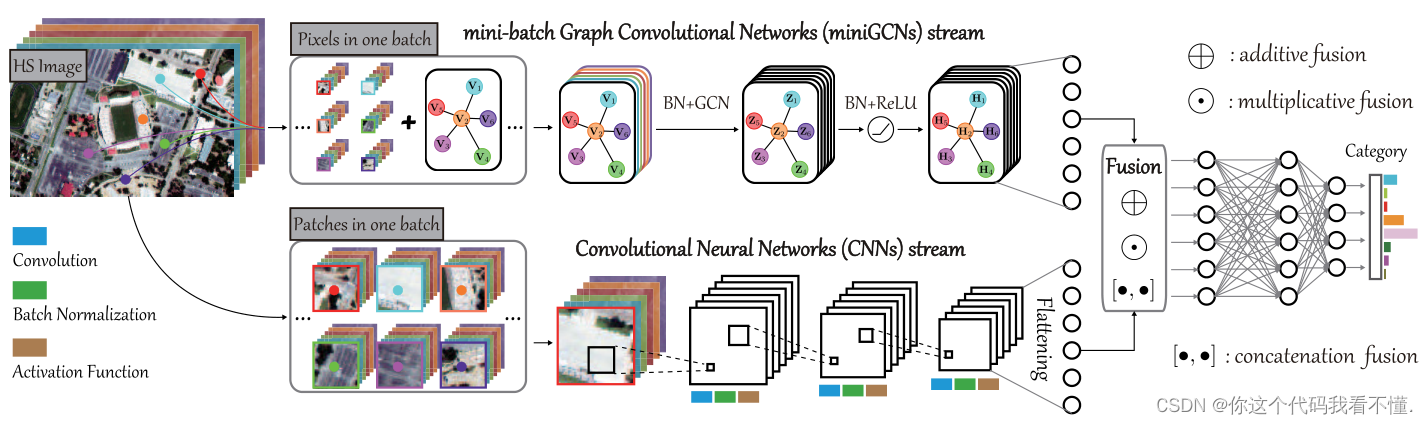

3、开发了三种融合方案,包括加法融合、元素乘法融合和级联融合,通过在端到端可训练网络中集成从CNN和miniGCNs中提取的特征,在HS图像中获得更好的分类结果。(文章中并未详细解释三种融合方法具体是如何使用的)

三、模型构造

(1)为什么使用图神经网络?

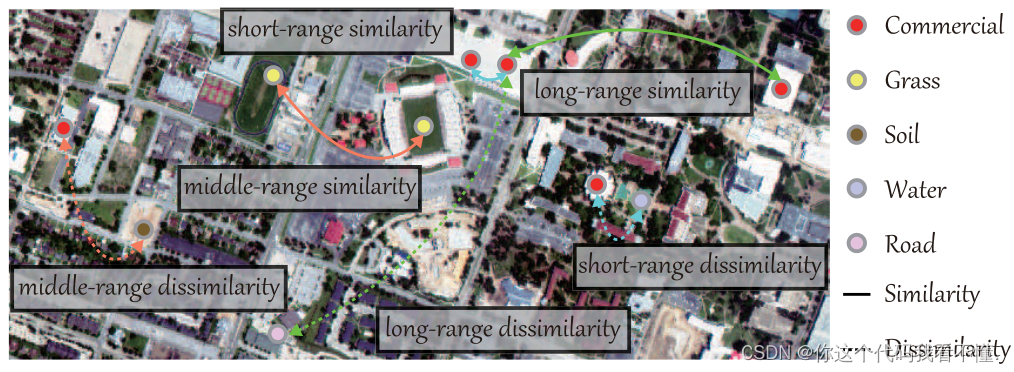

HS图像中短期、中期和长期空间关系如上图所示。CNN倾向于提取局部空间信息,而GCN能够捕获样本之间的中长期空间关系(相似性或不相似性)。 GCN能够借助周围信息对预测点进行更加详细的判断。

(2)图是如何选点的?

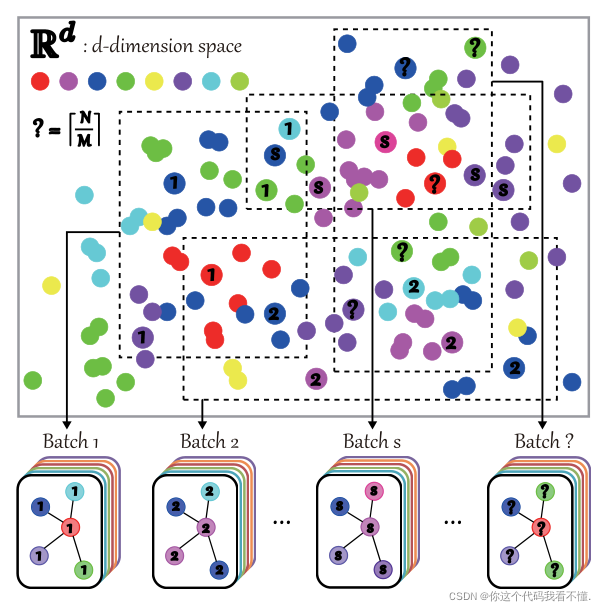

示例说明miniGCNs如何从完整图G中采样子图(或批次),旨在以minibatch方式训练网络。实心圆:不同颜色表示高维特征空间中不同类别的光谱特征。虚线框:每个批次的随机抽样区域 。

(3)文章的模型结构

这张图很清楚的说明了实验的模型结构,对于参与训练的点,上面的图卷积神经网络,利用像素进行构造与输出特征,下面的CNN利用像素及其周边的batch学习特征,最后将GCN与CNN学习到的特征通过三种方法进行融合,然后利用全连接层分类。

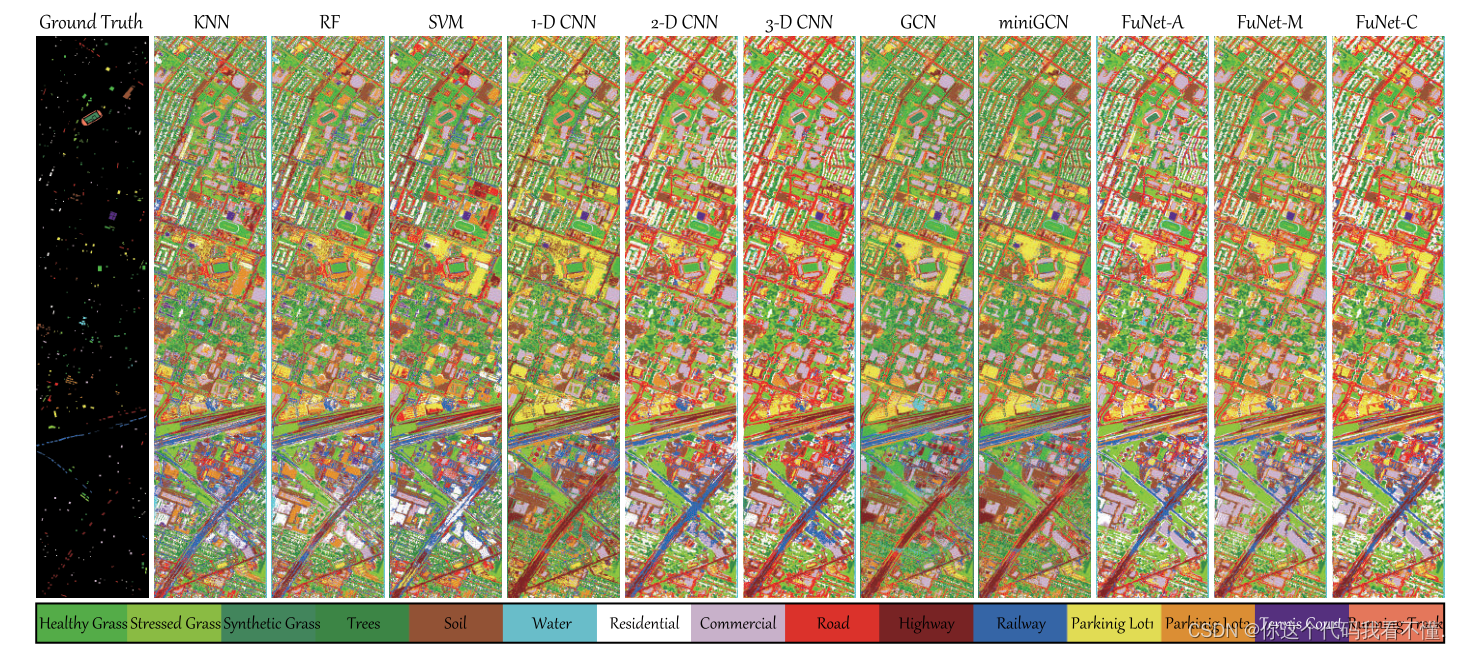

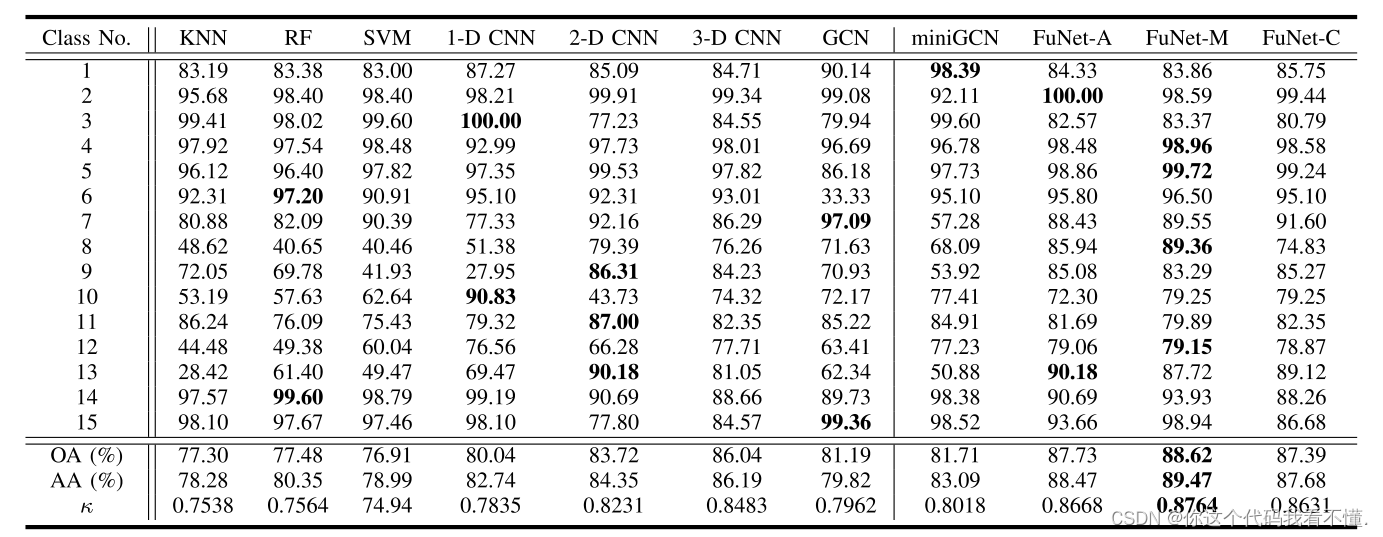

四、模型结果

这一部分不是重点,就放几张图的表看一下吧。

三种融合方法在三个数据集上的结果各不相同,说明其中并没有最好的方法,只有最合适的融合方法。

五、结论

由于嵌入了图(或拓扑)结构,GCNs可以在高维空间中正确描述HS图像的底层数据结构,但不可避免地会带来一些缺点,例如计算邻接矩阵时存储和计算成本高,梯度爆炸或消失问题(由于全批量网络训练)以及在输入新数据时重新训练这些网络的需要。为了解决这些问题,在本文中开发了一种新的有监督的GCNs版本,称为miniGCNs,它允许我们以小批量的方式训练大规模图形网络。由于其分批式网络训练策略,新提出的miniGCNs更加灵活,因为它们不仅在训练阶段产生较低的计算成本和稳定的局部最优解,而且可以直接预测新的输入样本,即样本外情况,而无需重新训练网络。更重要的是,可训练小批量策略使我们能够联合使用CNN和GCN为HS图像分类任务提取更多多样性和区分性的特征表示。为了利用这一特性,进一步研究了几个融合模块:A、M和C,它们集成了CNN和miniGCNs 以端到端可培训的方式。在三个广泛使用的HS数据集上进行的实验结果表明,与传统GCN相比,我们新提出的微型GCN具有有效性和优越性。此外,FuNet(具有不同的融合策略)已被证明优于使用单一模型(例如CNN和miniGCNs)。未来,我们将研究不同深度网络和我们的MiniGCN的可能组合,并开发更先进的融合模块,例如加权融合,以充分利用HS图像中包含的丰富光谱信息。

TGRS期刊上面利用GCN做高光谱图像分类的文章有很多,还有一篇动态图卷积神经网络也非常值得一看。