一. 使用Pytorch实现RNN循环神经网络

1. 读取数据集

上篇博文记录了RNN从零实现过程,现在使用Pytorch的高级API提供的函数实现RNN,首先读取时光机器数据集:

import torch

import d2l.torch

from torch import nn

from torch.nn import functional as F

batch_size,num_steps = 32,35

train_iter,vocab = d2l.torch.load_data_time_machine(batch_size,num_steps)

2. 模型定义

Pytorch高级API提供了循环神经网络的实现,构造一个具有256个隐藏单元的单隐藏层的循环神经网络层rnn_layer。

num_hiddens = 256

rnn_layer = nn.RNN(len(vocab),num_hiddens)

使用张量来初始化隐状态,它的形状是(隐藏层数,批量大小,隐藏单元数)。

state = torch.zeros(size=(1,batch_size,num_hiddens))

state.shape

通过一个隐状态和一个输入,就可以用更新后的隐状态计算输出。注意:rnn_layer的“输出”(Y)不涉及输出层的计算: 它是指每个时间步的隐状态,这些隐状态可以用作后续输出层的输入。

X = torch.rand(size=(num_steps,batch_size,len(vocab)))

Y,new_state = rnn_layer(X,state)

Y.shape,new_state.shape

'''

输出结果如下:

(torch.Size([35, 32, 256]), torch.Size([1, 32, 256]))

'''

为一个完整的循环神经网络模型定义一个RNNModel类, 注意rnn_layer只包含隐藏的循环层,我们还需要创建一个单独的输出层。

"""循环神经网络模型"""

class RNNModel(nn.Module):

def __init__(self,rnn_layer,vocab_size):

super(RNNModel, self).__init__()

self.rnn = rnn_layer

self.vocab_size = vocab_size

self.num_hiddens = rnn_layer.hidden_size

# 如果RNN是双向的,num_directions应该是2,否则应该是1

if not self.rnn.bidirectional:

self.num_directions = 1

self.linear = nn.Linear(self.num_hiddens,self.vocab_size)

else:

self.num_directions = 2

self.linear = nn.Linear(self.num_hiddens*2,self.vocab_size)

def forward(self,inputs,state):

X = F.one_hot(inputs.T.long(),self.vocab_size)

X = X.to(torch.float32)

Y,state = self.rnn(X,state)

# 全连接层输出层首先将Y的形状改为(时间步数*批量大小,隐藏单元数)

# 它的输出形状是(时间步数*批量大小,词表大小)。

outputs = self.linear(Y.reshape((-1,Y.shape[-1])))

return outputs,state

def begin_state(self,device,batch_size=1):

if not isinstance(self.rnn,nn.LSTM):

# nn.GRU,nn.RNN以张量作为隐状态

return torch.zeros(

size=(self.num_directions*self.rnn.num_layers,batch_size,self.num_hiddens),device=device)

else:

# nn.LSTM以元组作为隐状态,LSTM有两个隐状态

return(torch.zeros(

size=(self.num_directions*self.rnn.num_layers,batch_size,self.num_hiddens),device=device),

torch.zeros(

size=(self.num_directions*self.rnn.num_layers,batch_size,self.num_hiddens),device=device))

3. 训练与预测

在训练模型之前,让我们先基于一个具有随机权重的模型进行预测。

device = d2l.torch.try_gpu()

net = RNNModel(rnn_layer,vocab_size=len(vocab))

net = net.to(device)

d2l.torch.predict_ch8('time traveller',10,net,vocab,device)

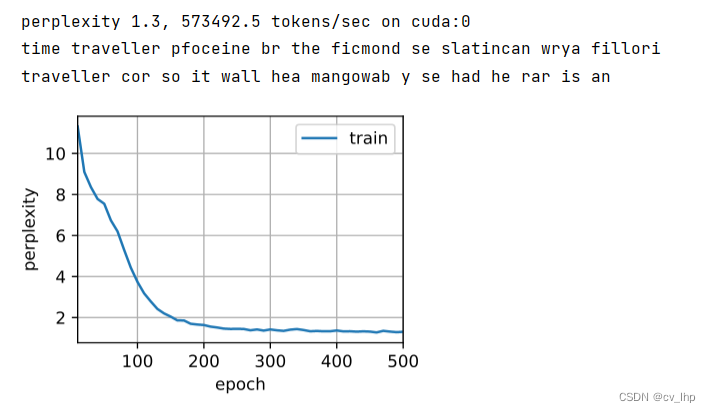

下面进行模型训练,训练结果如下图所示,与RNN循环神经网络从零实现相比,由于pytorch框架的高级API对代码进行了更多的优化, 该模型在较短的时间内达到了较低的困惑度,同时训练速度也很快:

num_epochs,lr = 500,1

d2l.torch.train_ch8(net,train_iter,vocab,lr,num_epochs,device,use_random_iter=False)

4. 小结

- pytorch框架的高级API提供了循环神经网络层的实现。

- pytorch框架的高级API的循环神经网络层返回一个输出和一个更新后的隐状态,我们还需要计算整个模型的输出层。

- 相比从零开始实现的循环神经网络,使用pytorch框架的高级API实现可以加速训练。

5. 全部代码

import torch

import d2l.torch

from torch import nn

from torch.nn import functional as F

batch_size, num_steps = 32, 35

train_iter, vocab = d2l.torch.load_data_time_machine(batch_size, num_steps)

num_hiddens = 256

rnn_layer = nn.RNN(len(vocab), num_hiddens)

state = torch.zeros(size=(1, batch_size, num_hiddens))

state.shape

X = torch.rand(size=(num_steps, batch_size, len(vocab)))

Y, new_state = rnn_layer(X, state)

Y.shape, new_state.shape

"""循环神经网络模型"""

class RNNModel(nn.Module):

def __init__(self, rnn_layer, vocab_size):

super(RNNModel, self).__init__()

self.rnn = rnn_layer

self.vocab_size = vocab_size

self.num_hiddens = rnn_layer.hidden_size

# 如果RNN是双向的,num_directions应该是2,否则应该是1

if not self.rnn.bidirectional:

self.num_directions = 1

self.linear = nn.Linear(self.num_hiddens, self.vocab_size)

else:

self.num_directions = 2

self.linear = nn.Linear(self.num_hiddens * 2, self.vocab_size)

def forward(self, inputs, state):

X = F.one_hot(inputs.T.long(), self.vocab_size)

X = X.to(torch.float32)

Y, state = self.rnn(X, state)

# 全连接层输出层首先将Y的形状改为(时间步数*批量大小,隐藏单元数)

# 它的输出形状是(时间步数*批量大小,词表大小)。

outputs = self.linear(Y.reshape((-1, Y.shape[-1])))

return outputs, state

def begin_state(self, device, batch_size=1):

if not isinstance(self.rnn, nn.LSTM):

# nn.GRU,nn.RNN以张量作为隐状态

return torch.zeros(

size=(self.num_directions * self.rnn.num_layers, batch_size, self.num_hiddens), device=device)

else:

# nn.LSTM以元组作为隐状态,LSTM有两个隐状态

return (torch.zeros(

size=(self.num_directions * self.rnn.num_layers, batch_size, self.num_hiddens), device=device),

torch.zeros(

size=(self.num_directions * self.rnn.num_layers, batch_size, self.num_hiddens), device=device))

device = d2l.torch.try_gpu()

net = RNNModel(rnn_layer, vocab_size=len(vocab))

net = net.to(device)

d2l.torch.predict_ch8('time traveller', 10, net, vocab, device)

num_epochs, lr = 500, 1

d2l.torch.train_ch8(net, train_iter, vocab, lr, num_epochs, device, use_random_iter=False)

6. 链接

循环神经网络RNN第一篇:李沐动手学深度学习V2-NLP序列模型和代码实现

循环神经网络RNN第二篇:李沐动手学深度学习V2-NLP文本预处理和代码实现

循环神经网络RNN第三篇:李沐动手学深度学习V2-NLP语言模型、数据集加载和数据迭代器实现以及代码实现

循环神经网络RNN第四篇:李沐动手学深度学习V2-RNN原理

循环神经网络RNN第五篇:李沐动手学深度学习V2-RNN循环神经网络从零实现

循环神经网络RNN第六篇:李沐动手学深度学习V2-使用Pytorch框架实现RNN循环神经网络

循环神经网络GRU第七篇:李沐动手学深度学习V2-GRU门控循环单元以及代码实现

循环神经网络LSTM第八篇:李沐动手学深度学习V2-LSTM长短期记忆网络以及代码实现

深度循环神经网络第九篇:李沐动手学深度学习V2-深度循环神经网络和代码实现

双向循环神经网络第十篇:李沐动手学深度学习V2-双向循环神经网络Bidirectional RNN和代码实现