0 准备工作:安装库

这是我自己的环境,目前是兼容的。

- Python :3.7

- Scikit-learn 0.22.1

- numpy 1.19

- pandas 1.2.5

- matplotlib 2.2.3

- scipy 1.7.3

1 介绍怎么使用XGBoost

方法一:可以直接调用xgboost库(pip install xgboost)

方法二:可以选择调用scikit-learn的API

建议:xgboost 库的调参会容易很多

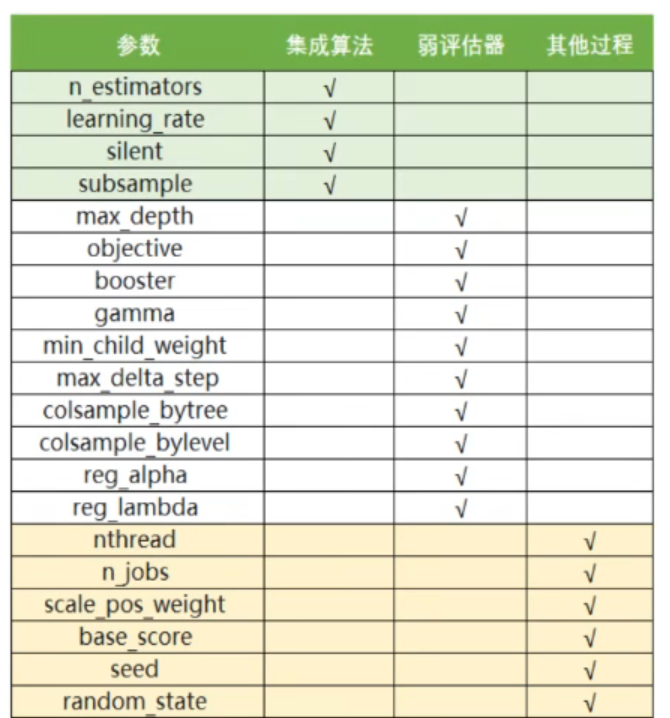

2 XGBoost的三大板块

- 集成算法本身 涉及到的参数

- 用于集成的弱评估器

- 以及应用中的其他过程

3 提升集成算法:重要参数 n_estimators

- XGBoost 的基础是梯度提升算法

- 弱评估器,也就是单个的基础评估器,这些评估器的预测准确率是不低于50%的

3.1 集成弱评估器方法

- 装袋法(bagging) : 一次性建立多个平行独立的弱评估器

- 提升法(boosting):逐一构建弱评估器,经过多次迭代逐渐积累多个弱评估器的预测能力。提升法中最著名的算法包括Adaboost 和 梯度提升树,XGBoost就是由梯度提升树发展而来的。

XGBoost 的背后也是CART树,这里所有的树都是二叉的。