Anaconda中安装python版的XGBoost和LightGBM库

XGboost 和LightGBM是目前机器学习中两个非常强大的算法。在之前的电脑上已经安装过着两个算法。最近换了一台新电脑,在重新安装的过程中,好像有点忘记了步骤,好在摸索出结果了,所以重新整理了一下。一方面是给需要的人作为借鉴,另一方面也是作为笔记方便以后查看。

安装过程主要分为3步:

- 下载相关**.whl**文件

- 导入到Anaconda中

- 在Anaconda Prompt中用命令行安装

.whl的下载

这两个包我已经下载好,需要的话直接在我分享的百度云链接中下载:

XGBoost和LightGBM我放在一个文件夹下的:链接地址

密码:4nxj

导入Anaconda

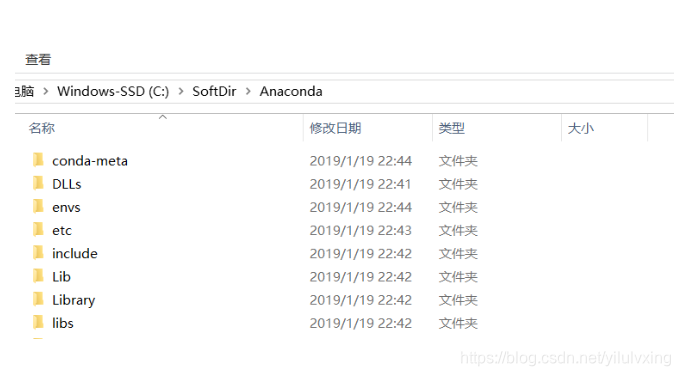

找到安装的Anaconda的目录,例如我的目录如下:

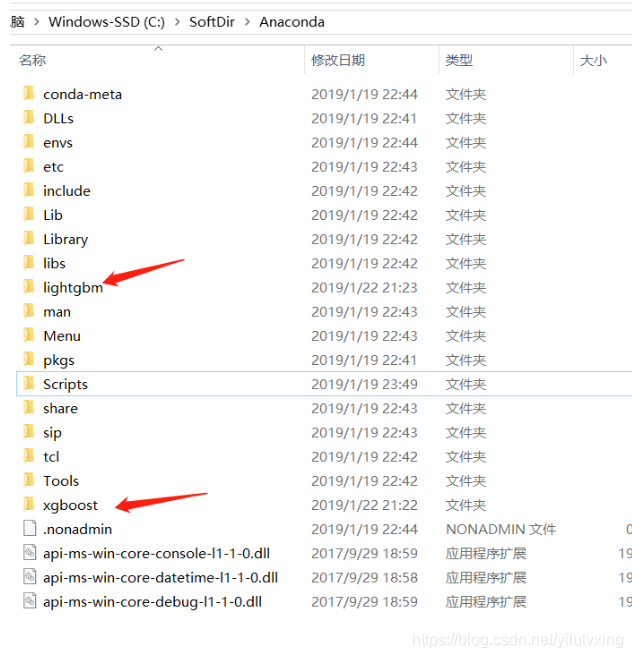

然后分别新建一个XGBoost和LightGBM文件夹

接着把刚刚从百度云链接中下载好的XGBoost和LightGBM的**.whl文件分别放在相应的文件夹下**

在Anaconda Prompt中用命令行安装

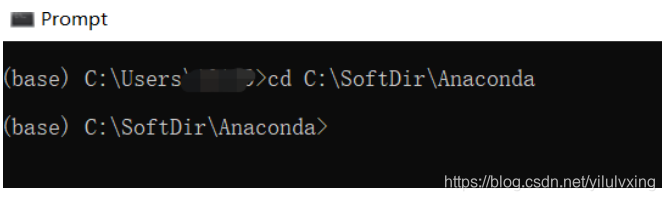

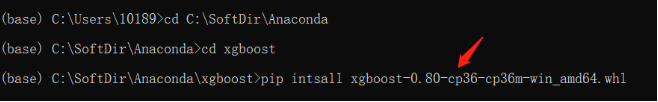

接着打开Anaconda Prompt,进入你的Anaconda 目录:

cd + C:\SoftDir\Anaconda (注意这是我自己电脑上的路径)

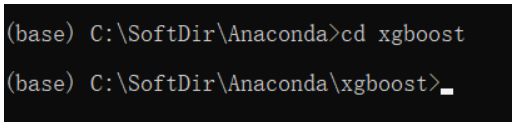

接着首先进入刚刚创建的XGBoost文件夹,来安装XGBoost库

输入: cd xgboost

然后在用pip安装

输入: pip intsall xgboost-0.80-cp36-cp36m-win_amd64.whl

(注意:xgboost-0.80-cp36-cp36m-win_amd64.whl是从刚刚百度云链接上下载完整包的名字)

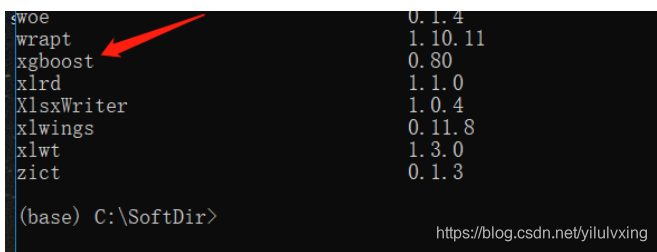

等待安装结束后,输入:pip list查看是否有显示

显示了xgboost,表示安装成功

写一段测试xgboost的案例,检查是否可用:

import numpy as np

import xgboost as xgb

data = np.random.rand(5,10) # 5 entities, each contains 10 features

label = np.random.randint(2, size=5) # binary target

dtrain = xgb.DMatrix( data, label=label)

dtest = dtrain

param = {'bst:max_depth':2, 'bst:eta':1, 'silent':1, 'objective':'binary:logistic' }

param['nthread'] = 4

param['eval_metric'] = 'auc'

evallist = [(dtest,'eval'), (dtrain,'train')]

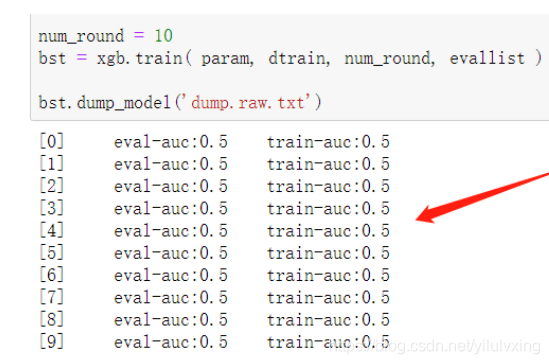

num_round = 10

bst = xgb.train( param, dtrain, num_round, evallist )

bst.dump_model('dump.raw.txt')

运行结果:

能正常运行,表明确实可用

以上同样的步骤,安装LightGBM,即:

首先,在Anaconda Prompt中,cd 进入刚刚创建的LightGBM文件夹,

然后输入命令:

pip install lightgbm-2.0.3-py2.py3-none-win_amd64.whl

在输入pip list 查看是否有显示即可