周志华老师的书上省略了很多矩阵运算,而这些运算是PCA的核心之处。建议各位同学 看看我给出的参考文章,学习完之后,再回过来看看西瓜书。

为什么要降维?

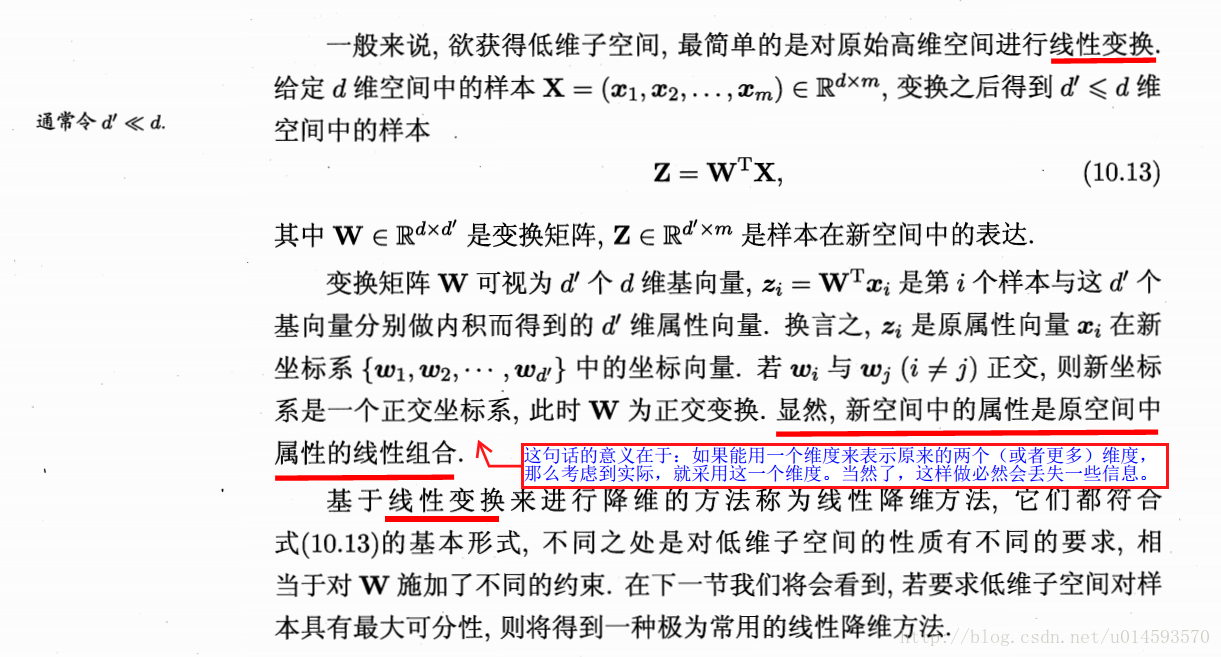

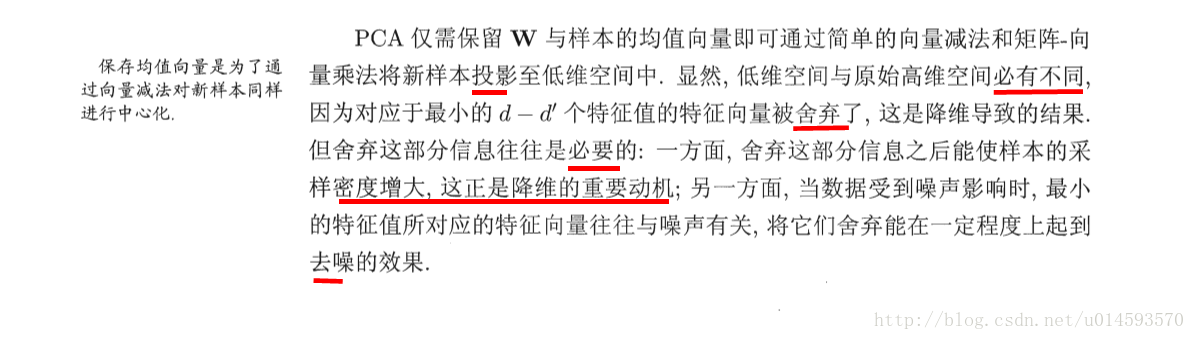

机器学习中紧接过拟合之后的最大问题就是维度灾难(curse of dimensionality)。这一概念是由贝尔曼(Bellman)在1961年首先提出的,用来描述以下事实:许多在低维空间表现很好的算法,当输入是高维度的时候,就变得计算不可行(intractable)了。但在机器学习领域,这有更多的意义。随着样例维度(即特征数目)的增长,正确泛化的难度会以指数级增加,原因是同等规模的训练集只能覆盖越来越少的输入空间比例。

因此如果不降维的话,数据中真正有用的部分会淹没在海量的无用数据中。

【参考文章】

机器学习-周志华

主成分分析(Principal components analysis)-最大方差解释

主成分分析(Principal components analysis)-最小平方误差解释

最大方差和最小协方差解释(线性代数看PCA)

机器学习中的数学(5)-强大的矩阵奇异值分解(SVD)及其应用