在欧式空间中使用的CNN卷积具有平移不变性,权值共享,局部连接,分层次表达的特点;但是图网络是一种非欧式结构的数据,网络是不规整的关系型数据,所以其不存在平移不变形(每个节点的周围邻居数不固定),导致图网络无法使用传统的CNN。不使用卷积核卷积的话,只能按照全连接网络的方式进行线性映射,这样又将失去权值共享,局部连接,分层次表达这些优势,需要大量的参数。在《Spectral Networks and Deep Locally Connected Networks on Graphs》 中,作者想办法把传统欧式空间的卷积迁移到图网络中去,作者提出了两个结构,把欧式空间的卷积迁移到了图网络的空间域和频域。

无向图:

G

=

(

Ω

,

W

)

G=(\Omega,W)

G = ( Ω , W )

Ω

\Omega

Ω

W

W

W

W

W

W

W

W

W

W

i

,

j

W_{i,j}

W i , j

在传统的欧式空间中(以图像为例),在卷积时需要设置一定大小的卷积核,如 kernel = (3,3),就是相当于中心像素点的邻域为周围的8个像素点。

W

W

W

N

δ

(

j

)

=

{

i

∈

Ω

:

W

i

,

j

>

δ

}

(1)

N_\delta(j)=\{i\in\Omega:W_{i,j}>\delta\}\tag{1}

N δ ( j ) = { i ∈ Ω : W i , j > δ } ( 1 )

N

δ

(

j

)

N_\delta(j)

N δ ( j )

j

j

j

δ

\delta

δ

j

j

j

δ

\delta

δ

j

j

j

2.2节中作者在介绍一个传统卷积的分层次表达的特点,这里就不再解释,直接进入2.3节。

N

k

=

{

N

k

,

i

;

i

=

1...

d

k

−

1

}

(2)

N_{k}=\{N_{k,i};i=1...d_{k-1}\}\tag{2}

N k = { N k , i ; i = 1 . . . d k − 1 } ( 2 )

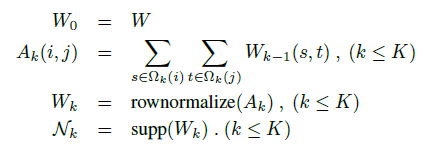

在公式(2)中 ,k表示第k个尺度,类比传统卷积,意思就是第k层卷积层,

Ω

k

\Omega_{k}

Ω k

d

k

−

1

d_{k-1}

d k − 1

Ω

k

=

d

k

−

1

\Omega_{k} = d_{k-1}

Ω k = d k − 1

Ω

k

+

1

=

d

k

\Omega_{k+1}=d_{k}

Ω k + 1 = d k

N

k

,

i

N_{k,i}

N k , i

Ω

k

=

d

k

−

1

\Omega_{k} = d_{k-1}

Ω k = d k − 1

N

k

N_{k}

N k

x

k

+

1

,

j

=

L

k

h

(

∑

i

=

1

f

k

−

1

F

k

,

i

,

j

x

k

,

j

)

(

j

=

1...

f

k

)

(3)

x_{k+1,j}=L_{k}h(\sum_{i=1}^{f_{k-1}}{F_{k,i,j}x_{k,j}})(j=1...f_{k})\tag{3}

x k + 1 , j = L k h ( i = 1 ∑ f k − 1 F k , i , j x k , j ) ( j = 1 . . . f k ) ( 3 )

在公式(3)中,

f

k

−

1

f_{k-1}

f k − 1

x

k

=

(

x

k

,

i

;

i

=

1...

f

k

−

1

)

x_{k}=(x_{k,i};i=1...f_{k-1})

x k = ( x k , i ; i = 1 . . . f k − 1 )

x

k

x_{k}

x k

d

k

−

1

,

f

k

−

1

d_{k-1},f_{k-1}

d k − 1 , f k − 1

x

k

,

i

x_{k,i}

x k , i

d

k

−

1

d_{k-1}

d k − 1

d

k

−

1

d_{k-1}

d k − 1

F

k

,

i

,

j

F_{k,i,j}

F k , i , j

d

k

−

1

,

d

k

−

1

d_{k-1},d_{k-1}

d k − 1 , d k − 1

F

k

,

i

,

j

F_{k,i,j}

F k , i , j

N

k

N_{k}

N k

F

k

,

i

,

j

(

x

,

y

)

F_{k,i,j}(x,y)

F k , i , j ( x , y )

W

W

W

∑

i

=

1

f

k

−

1

F

k

,

i

,

j

x

k

,

j

\sum_{i=1}^{f_{k-1}}{F_{k,i,j}x_{k,j}}

∑ i = 1 f k − 1 F k , i , j x k , j

(

d

k

−

1

,

1

)

(d_{k-1},1)

( d k − 1 , 1 )

h

(

∗

)

h(*)

h ( ∗ )

L

k

(

∗

)

L_{k}(*)

L k ( ∗ )

(

d

k

−

1

,

1

)

(d_{k-1},1)

( d k − 1 , 1 )

(

d

k

,

1

)

(d_{k},1)

( d k , 1 )

x

k

+

1

,

j

.

s

h

a

p

e

=

(

d

k

,

1

)

x_{k+1,j}.shape = (d_{k},1)

x k + 1 , j . s h a p e = ( d k , 1 )

f

k

f_{k}

f k

x

k

+

1

=

(

x

k

+

1

,

i

;

i

=

1...

f

k

)

x_{k+1}=(x_{k+1,i};i=1...f_{k})

x k + 1 = ( x k + 1 , i ; i = 1 . . . f k )

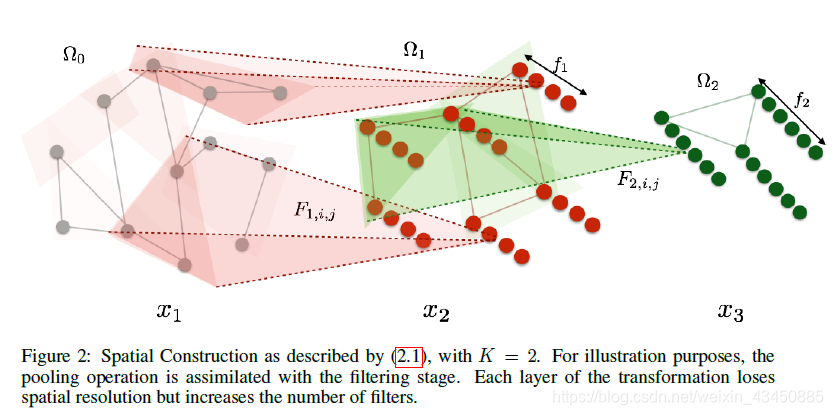

图上的空间域卷积如下图所示: k =1时:

n

u

m

(

Ω

0

)

=

12

,

x

1

.

s

h

a

p

e

=

(

12

,

f

0

)

,

f

1

=

4

,

F

1

,

i

,

j

.

s

h

a

p

e

=

(

12

,

12

)

,

1

≤

i

≤

f

0

,

1

≤

j

≤

f

1

,

d

1

=

6

num(\Omega_{0})=12,x_{1}.shape=(12,f_{0}),f_{1}=4,F_{1,i,j}.shape=(12,12),1 \leq i \leq f_{0},1 \leq j \leq f_{1},d_{1}=6

n u m ( Ω 0 ) = 1 2 , x 1 . s h a p e = ( 1 2 , f 0 ) , f 1 = 4 , F 1 , i , j . s h a p e = ( 1 2 , 1 2 ) , 1 ≤ i ≤ f 0 , 1 ≤ j ≤ f 1 , d 1 = 6 k =2时:

n

u

m

(

Ω

1

)

=

d

1

=

6

,

x

2

.

s

h

a

p

e

=

(

6

,

f

1

)

,

f

2

=

6

,

F

2

,

i

,

j

.

s

h

a

p

e

=

(

6

,

6

)

,

1

≤

i

≤

f

1

=

4

,

1

≤

j

≤

f

2

,

d

2

=

3

num(\Omega_{1})=d_{1}=6,x_{2}.shape=(6,f_{1}),f_{2}=6,F_{2,i,j}.shape=(6,6),1 \leq i \leq f_{1}=4,1 \leq j \leq f_{2},d_{2}=3

n u m ( Ω 1 ) = d 1 = 6 , x 2 . s h a p e = ( 6 , f 1 ) , f 2 = 6 , F 2 , i , j . s h a p e = ( 6 , 6 ) , 1 ≤ i ≤ f 1 = 4 , 1 ≤ j ≤ f 2 , d 2 = 3 网络输出:

x

3

.

s

h

a

p

e

=

(

d

2

,

f

2

)

=

(

3

,

6

)

x_{3}.shape=(d_{2},f_{2})=(3,6)

x 3 . s h a p e = ( d 2 , f 2 ) = ( 3 , 6 )

离散域的卷积公式:

(

f

∗

g

)

=

∑

τ

=

−

∞

∞

f

(

τ

)

g

(

n

−

τ

)

(f*g)=\sum_{\tau=-\infty}^{\infty}{f(\tau)g(n-\tau)}

( f ∗ g ) = ∑ τ = − ∞ ∞ f ( τ ) g ( n − τ )

X

(

k

)

=

F

(

x

(

n

)

)

=

∑

n

=

0

N

−

1

x

(

n

)

e

−

j

k

2

π

N

n

X(k)=F(x(n))=\sum_{n=0}^{N-1}{x(n)e^{-jk\frac{2\pi}{N}n}}

X ( k ) = F ( x ( n ) ) = ∑ n = 0 N − 1 x ( n ) e − j k N 2 π n

k

∈

[

0

,

N

−

1

]

k\in[0,N-1]

k ∈ [ 0 , N − 1 ]

x

(

n

)

x(n)

x ( n )

{

e

−

j

k

2

π

N

n

}

\{e^{-jk\frac{2\pi}{N}n}\}

{ e − j k N 2 π n }

x

(

n

)

x(n)

x ( n )

{

e

−

j

k

2

π

N

n

}

\{e^{-jk\frac{2\pi}{N}n}\}

{ e − j k N 2 π n }

X

(

k

)

X(k)

X ( k )

x

(

n

)

=

F

−

1

(

X

(

k

)

)

=

1

N

∑

k

=

0

N

−

1

X

(

k

)

e

j

k

2

π

N

n

x(n) = F^{-1}(X(k))=\frac{1}{N}\sum_{k=0}^{N-1}{X( k)e^{jk\frac{2\pi}{N}n}}

x ( n ) = F − 1 ( X ( k ) ) = N 1 ∑ k = 0 N − 1 X ( k ) e j k N 2 π n

n

∈

[

0

,

N

−

1

]

n\in[0,N-1]

n ∈ [ 0 , N − 1 ]

(

f

∗

g

)

=

F

−

1

[

F

[

f

]

⨀

F

[

g

]

]

(4)

(f*g)=F^{-1}[F[f]\bigodot F[g]]\tag{4}

( f ∗ g ) = F − 1 [ F [ f ] ⨀ F [ g ] ] ( 4 )

⨀

\bigodot

⨀

D

D

D

D

D

D

W

W

W

L

=

D

−

W

L=D-W

L = D − W

L

L

L

L

=

V

Λ

V

T

L=V\Lambda V^{T}

L = V Λ V T

V

=

(

v

1

,

.

.

.

,

v

i

,

.

.

.

v

n

)

,

v

i

V=(v_{1},...,v_{i},...v_{n}),v_{i}

V = ( v 1 , . . . , v i , . . . v n ) , v i

L

L

L

Λ

=

d

i

a

g

(

λ

1

.

.

.

λ

i

.

.

.

λ

n

)

\Lambda=diag(\lambda_{1}...\lambda_{i}...\lambda_{n})

Λ = d i a g ( λ 1 . . . λ i . . . λ n )

λ

i

\lambda_{i}

λ i

L

L

L

L

v

i

=

λ

i

v

i

(5)

Lv_{i}=\lambda_{i}v_{i}\tag{5}

L v i = λ i v i ( 5 )

而所有的基向量

{

e

−

j

k

2

π

N

n

}

\{e^{-jk\frac{2\pi}{N}n}\}

{ e − j k N 2 π n }

∇

2

f

=

∂

2

e

−

j

k

2

π

N

n

∂

n

2

=

−

(

k

2

π

N

)

2

e

−

j

k

2

π

N

n

=

−

w

2

f

(6)

\nabla^{2}f=\frac{\partial^{2} e^{-jk\frac{2\pi}{N}n}}{\partial n^{2}}=-(k\frac{2\pi}{N})^{2}e^{-jk\frac{2\pi}{N}n}=-w^{2}f\tag{6}

∇ 2 f = ∂ n 2 ∂ 2 e − j k N 2 π n = − ( k N 2 π ) 2 e − j k N 2 π n = − w 2 f ( 6 )

∇

2

\nabla^{2}

∇ 2

e

−

j

k

2

π

N

n

e^{-jk\frac{2\pi}{N}n}

e − j k N 2 π n

∇

2

\nabla^{2}

∇ 2

−

w

2

-w^{2}

− w 2

e

−

j

k

2

π

N

n

e^{-jk\frac{2\pi}{N}n}

e − j k N 2 π n

v

i

v_{i}

v i

−

w

2

-w^{2}

− w 2

λ

i

\lambda_{i}

λ i

f

f

f

f

^

\hat{f}

f ^

f

^

(

k

)

=

∑

n

=

0

N

−

1

f

(

n

)

e

−

j

k

2

π

N

n

=

∑

n

=

0

N

−

1

f

(

n

)

v

k

(

n

)

=

v

k

T

f

(7)

\hat{f}(k) =\sum_{n=0}^{N-1}{f(n)e^{-jk\frac{2\pi}{N}n}}=\sum_{n=0}^{N-1}{f(n)v_{k}(n)}= v_{k}^{T}f\tag{7}

f ^ ( k ) = n = 0 ∑ N − 1 f ( n ) e − j k N 2 π n = n = 0 ∑ N − 1 f ( n ) v k ( n ) = v k T f ( 7 )

由式(7)可知:

f

^

=

V

T

f

(8)

\hat{f}=V^{T}f\tag{8}

f ^ = V T f ( 8 )

将式(8)带入卷积公式得:

(

g

∗

f

)

=

V

[

V

T

g

⨀

V

T

f

]

(9)

(g*f)=V[V^{T}g\bigodot V^{T}f ]\tag{9}

( g ∗ f ) = V [ V T g ⨀ V T f ] ( 9 )

由于

V

T

g

=

(

v

1

T

g

,

.

.

.

,

v

n

T

g

)

T

V^{T}g=(v_{1}^{T}g,...,v_{n}^{T}g)^{T}

V T g = ( v 1 T g , . . . , v n T g ) T

V

T

g

⨀

V

T

f

=

d

i

a

g

(

v

1

T

g

,

.

.

.

,

v

n

T

g

)

V

T

f

V^{T}g\bigodot V^{T}f=diag(v_{1}^{T}g,...,v_{n}^{T}g)V^{T}f

V T g ⨀ V T f = d i a g ( v 1 T g , . . . , v n T g ) V T f

g

θ

=

d

i

a

g

(

v

1

T

g

,

.

.

.

,

v

n

T

g

)

g_{\theta}=diag(v_{1}^{T}g,...,v_{n}^{T}g)

g θ = d i a g ( v 1 T g , . . . , v n T g )

(

g

∗

f

)

(

n

)

=

V

g

θ

V

T

f

(10)

(g*f)(n)=Vg_{\theta}V^{T}f\tag{10}

( g ∗ f ) ( n ) = V g θ V T f ( 1 0 )

论文中所给的频域公式为:

x

k

+

1

,

j

=

h

(

V

∑

i

=

1

f

k

−

1

F

k

,

i

,

j

V

T

x

k

,

i

)

(11)

x_{k+1,j}=h(V\sum_{i=1}^{f_{k-1}}{F_{k,i,j}V^{T}x_{k,i}})\tag{11}

x k + 1 , j = h ( V i = 1 ∑ f k − 1 F k , i , j V T x k , i ) ( 1 1 )

在式(11)中

F

k

,

i

,

j

F_{k,i,j}

F k , i , j

g

θ

g_{\theta}

g θ

x

k

,

i

就

是

f

x_{k,i}就是f

x k , i 就 是 f

f

f

f

x

x

x

x

k

,

i

x_{k,i}

x k , i

F

k

,

i

,

j

F_{k,i,j}

F k , i , j

j

j

j

i

i

i

h

(

∗

)

h(*)

h ( ∗ )

论文其他内容: