【转载】机器学习算法实现解析——word2vec源码解析 --- 作者:zhiyong_will- 【转载】word2vec 中的数学原理详解(一)目录和前言 --- 作者:peghoty

- 【转载】word2vec数学原理

- 【转载】word2vec有什么应用?--- 来自知乎各位大牛现身说法

- 【转载】[NLP] 秒懂词向量Word2vec的本质 --- 知乎穆文『数据挖掘机养成记』

- 【转载】word2vec Parameter Learning Explained --- 作者:Xing rong

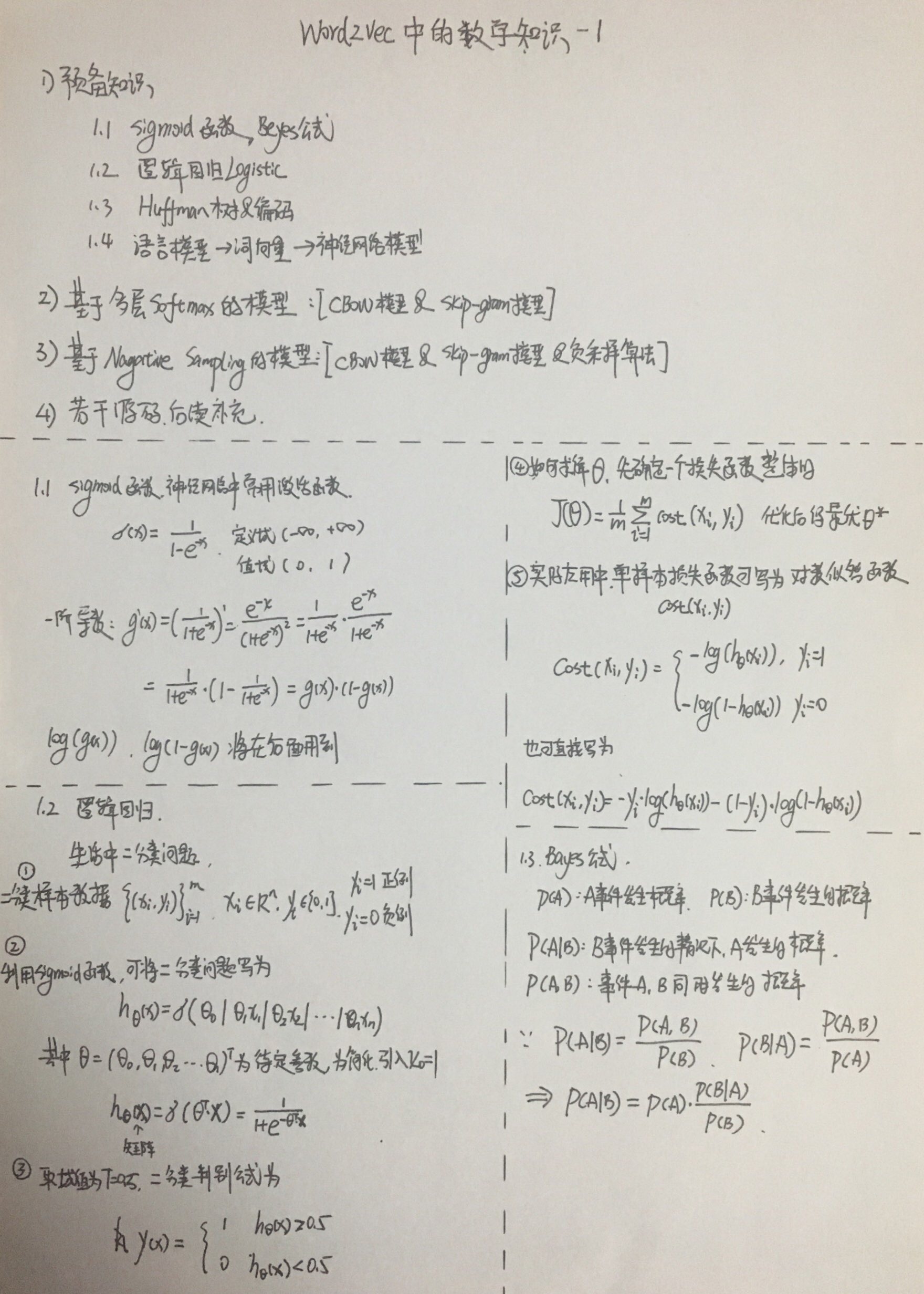

- 预备知识

- sigmoid函数、逻辑回归、Bayes公式

- Huffman树& Huffman编码、 统计语言模型、n-gram模型(词出现概率与前面固定数目词相关)

- 神经概率语言模型(利用词向量,利用神经网络构造F)、与n-gram模型的对比优势(输入层到投影层累加非首位拼接、无隐藏层、输出层为树形结构非线性)

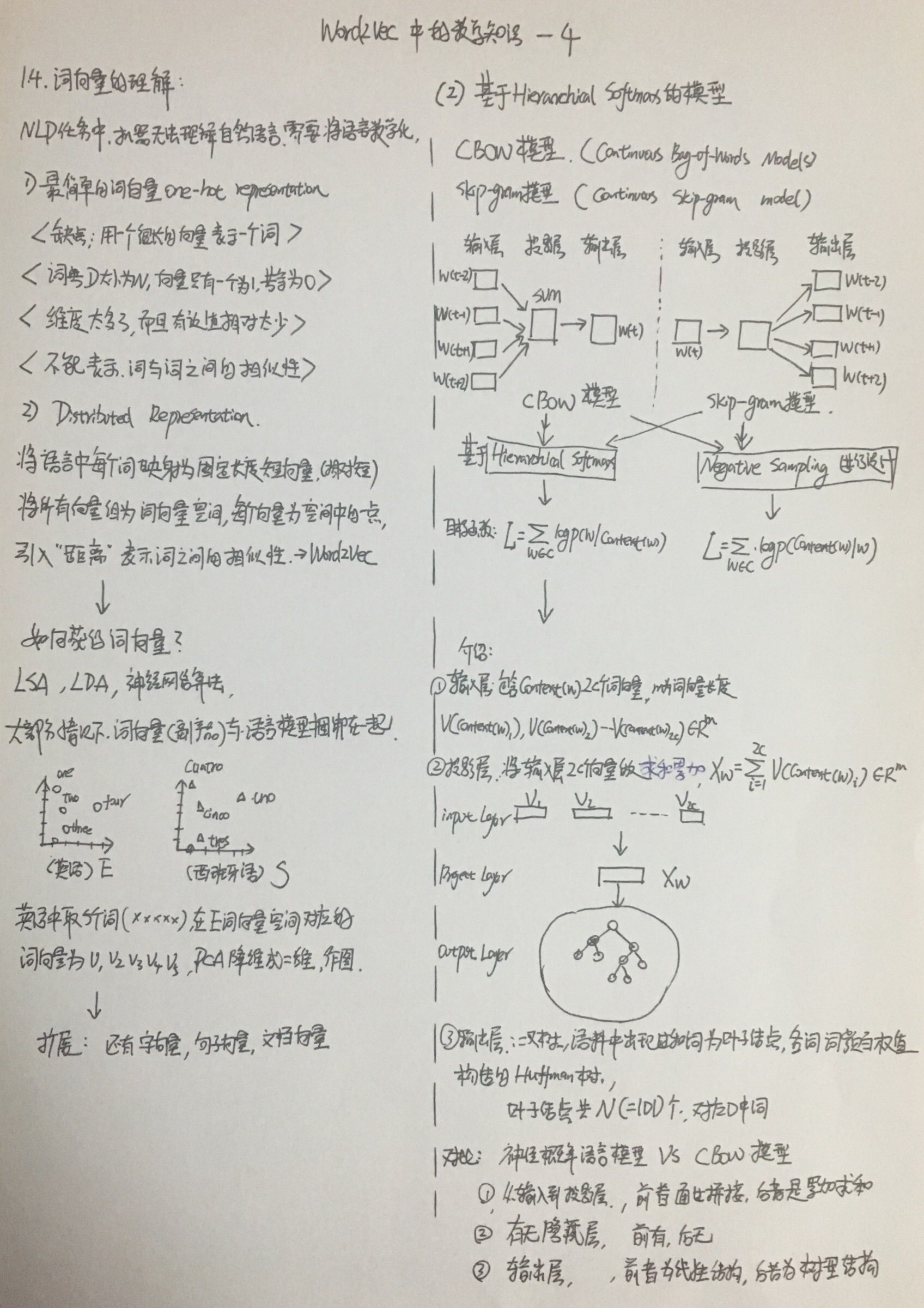

- 词向量的理解(与One-hot的区别,One-hot维度太高,不能表示相似性)、基于Hierarchial Softmax的模型:CBOW(Continuous Bag-of-Words model) & Skip-gram (Continuous skip-gram model)、对比神经概率语言模型与CBOW模型

- 梯度计算(随机梯度上升)求最大概率值推导、最终得到Xw、q、g、e、θ, CBOW伪代码 & Skip-gram伪代码

- 基于Negative Sampling 的模型:CBOW (Continuous Bag-of-Words model) & Skip-gram (Continuous skip-gram model)

数学推导对应上方6点

- 1) sigmoid函数、逻辑回归、Bayes公式

- 2) Huffman树 & Huffman编码、 统计语言模型、n-gram模型(词出现概率与前面固定数目词相关)

- 3) 神经概率语言模型(利用词向量,利用神经网络构造F)、与n-gram模型的对比优势(输入层到投影层累加非首位拼接、无隐藏层、输出层为树形结构非线性)

- 4) 词向量的理解(与One-hot的区别,One-hot维度太高,不能表示相似性)、基于Hierarchial Softmax的模型:CBOW(Continuous Bag-of-Words model) & Skip-gram (Continuous skip-gram model)、对比神经概率语言模型与CBOW模型

- 5) 梯度计算(随机梯度上升)求最大概率值推导、最终得到Xw、q、g、e、θ, CBOW伪代码 & Skip-gram伪代码

- 6) 基于Negative Sampling 的模型:CBOW (Continuous Bag-of-Words model) & Skip-gram (Continuous skip-gram model)

# 后期应该补上 Word2vec的源码解读:

#