1. 分词word tokenize

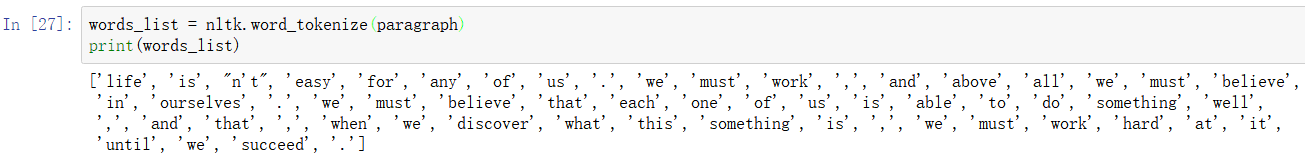

(1) 使用nltk.word_tokenize(text), 其中"isn't"被分割为"is"和"n't"

(2)使用WordPunctTokenizer(),单词标点分割,其中"isn't"被分割为"isn","'" 和“t"

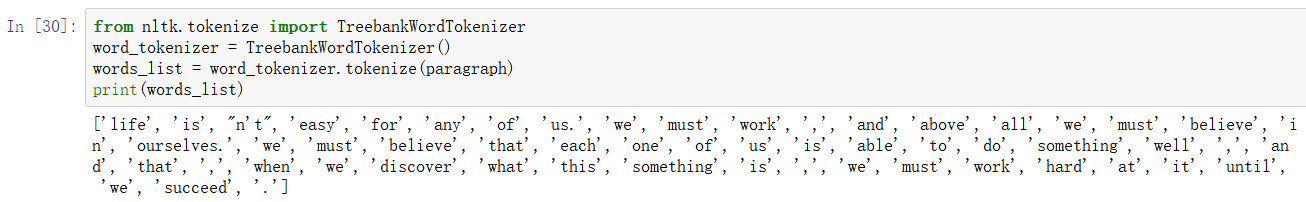

(3) 使用TreebankWordTokenizer (宾夕法尼亚州立大学 Treebank单词分割器), 其中"isn't"被分割为"is"和"n't"

(4) 使用WhitespaceTokenizer(), 空格符号分割,就是split(' ') 最简单的一个分词器。"isn't"作为一个整体,没有被分割。

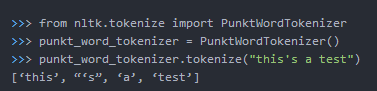

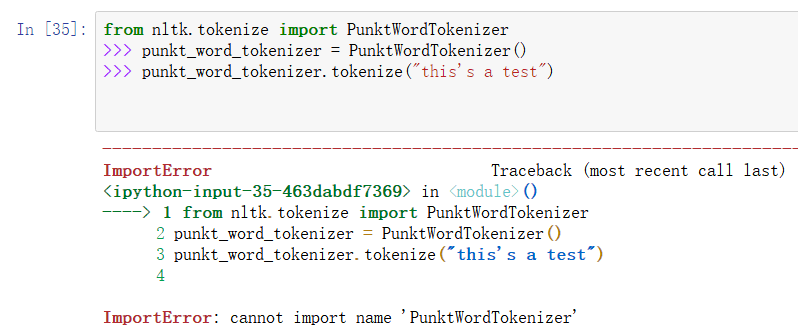

(5) PunktWordTokenizer():导入失败,未找到原因,欢迎交流讨论。