- Prólogo :…

-

Tabla de contenido

0 Introducción

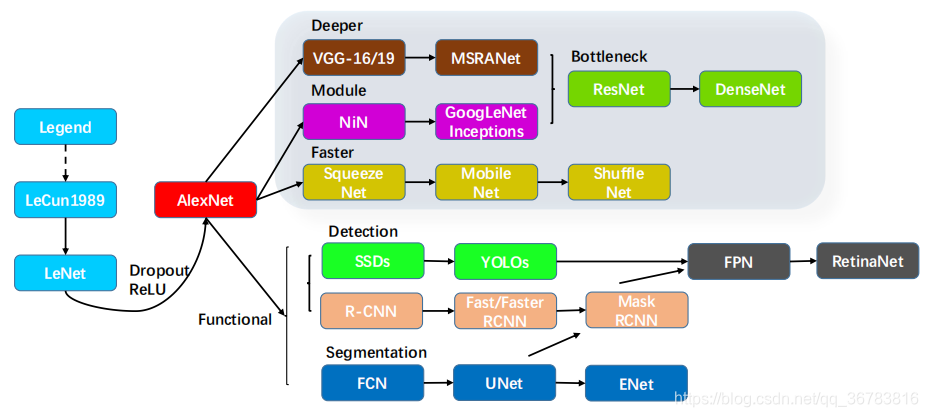

Normalmente, CNN ahora toma la forma de columna vertebral + cabeza funcional. La columna vertebral se puede reemplazar entre sí.

1 marco de red

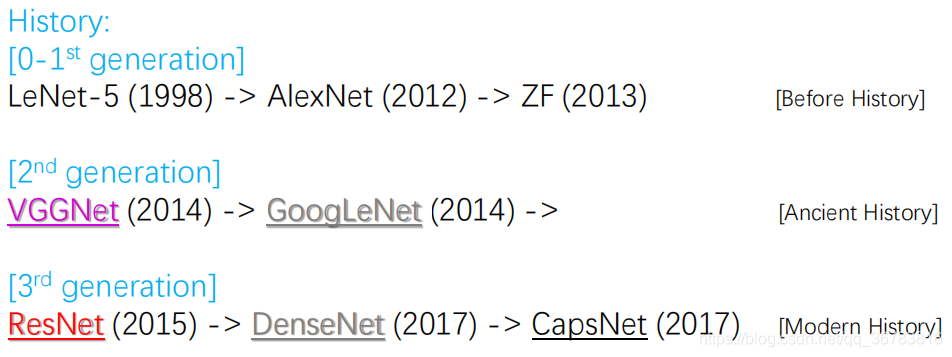

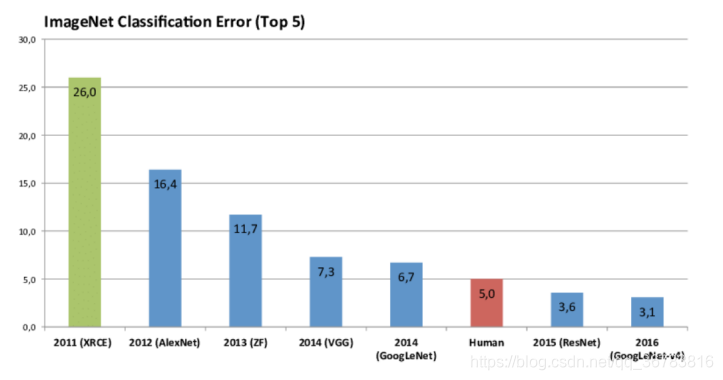

Es algo muy moderno que se use CNN en CV.

En 1986, Geoffrey Hinton propuso el algoritmo BP. También es el autor de Dropout & Relu.

En 1989, se aplicó el algoritmo BP a la red CNN de Yann LeCun y se propuso LeNet. Debido a la falta de potencia informática de alto rendimiento, LeNet no ha atraído la atención de la gente. Este es también el creador de la CNN moderna.

En 2012, Alexnet logró buenos resultados en la competencia, por lo que comenzó a ser popular en el campo del CV.

En 2015, se propuso ResNet, ha llegado la hora de CNN.

1.1 Marcos de red clásicos tradicionales

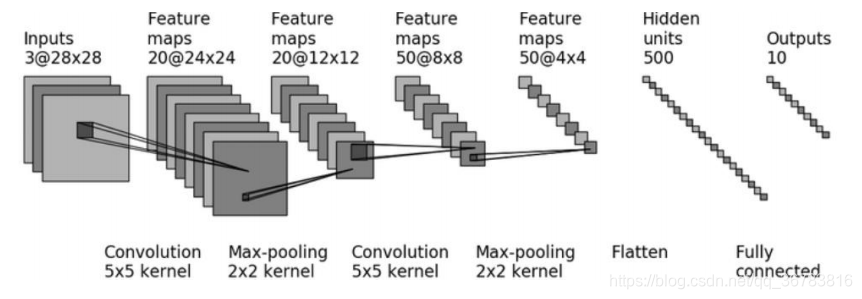

1.1.1 LeNet-5

1.1.2 AlexNet

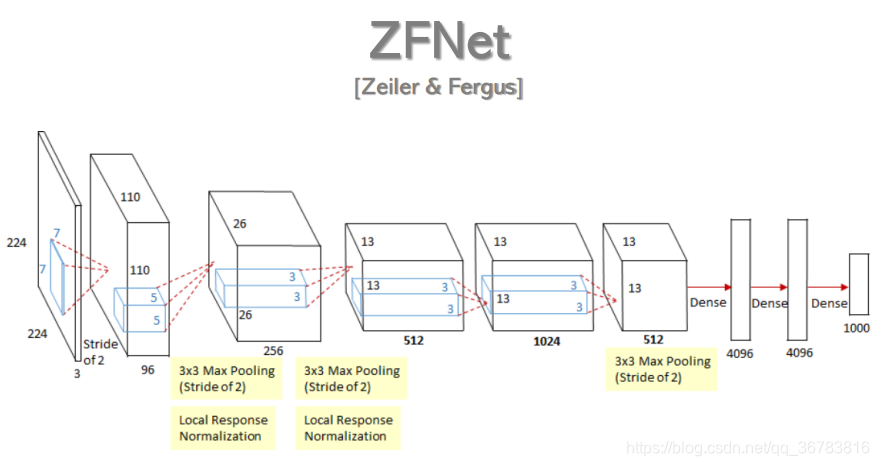

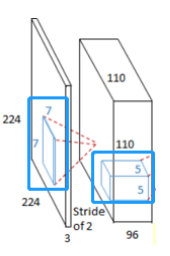

1.1.3 ZFNet

Fórmula empírica:

Entrada - n * (Conv - ReLU - MaxPool) - 1/2 * FC - Salida

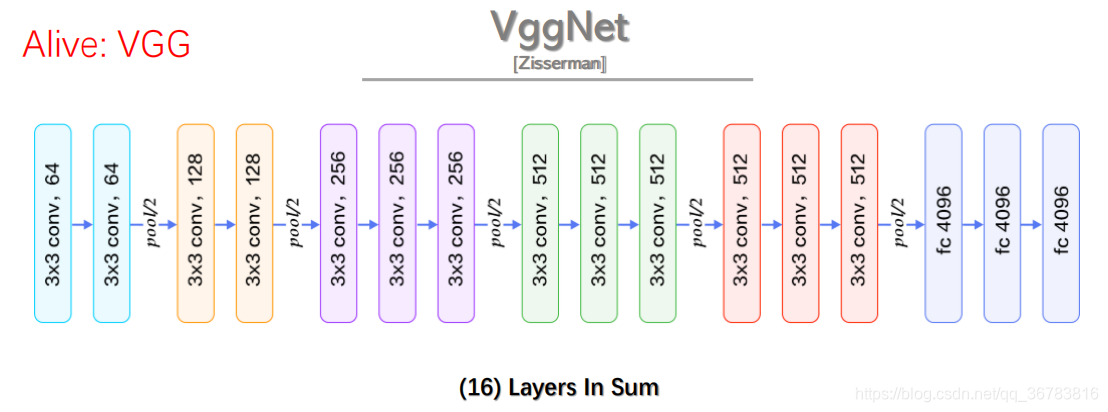

1.1.4 VggNet

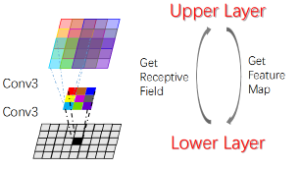

(1) ¿Por qué el kernel es 3 * 3?

Campo receptivo: la región del espacio de entrada que afecta a una unidad particular de la red.

(2) ¿El núcleo pequeño siempre es mejor?

Responderemos a esto en ResNet.

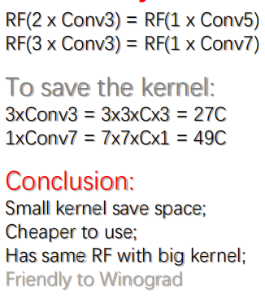

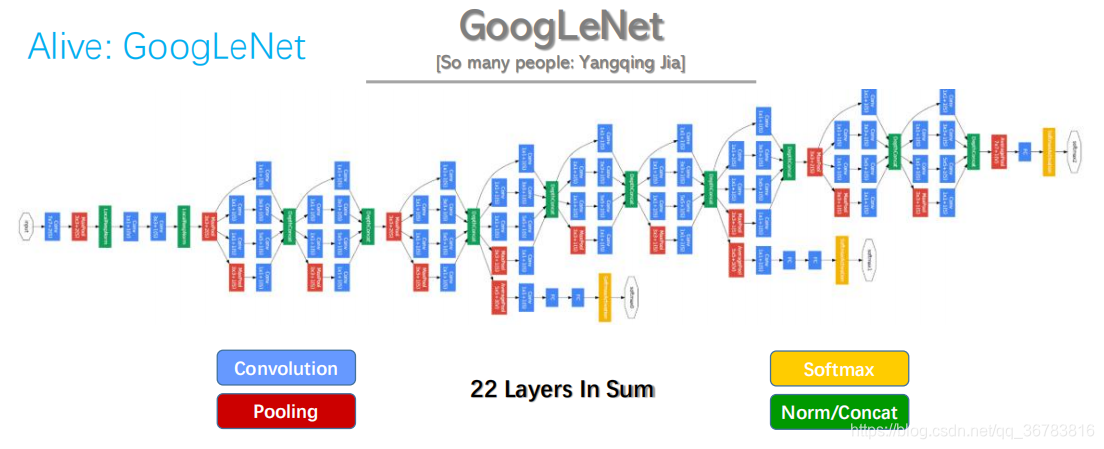

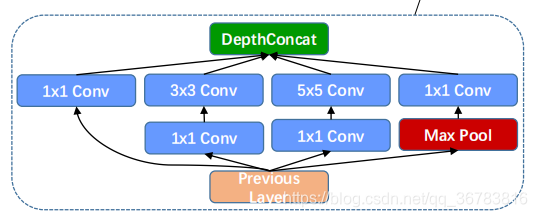

1.1.5 GoogLeNet

Yangqing Jia también es el autor de Caffe.

Características de GooLeNet:

(1) Conv. 1 * 1:

reducir dimensión / canal

(2) Módulo de inicio:

resolución múltiple

(3) Piscina Global Ave:

mejor resultado que FC

obtener el vector de características también

reemplazar FC

(4) Softmax auxiliar:

pérdida de montaje ponderada

menos overfit

1.1.6 ResNet-Link

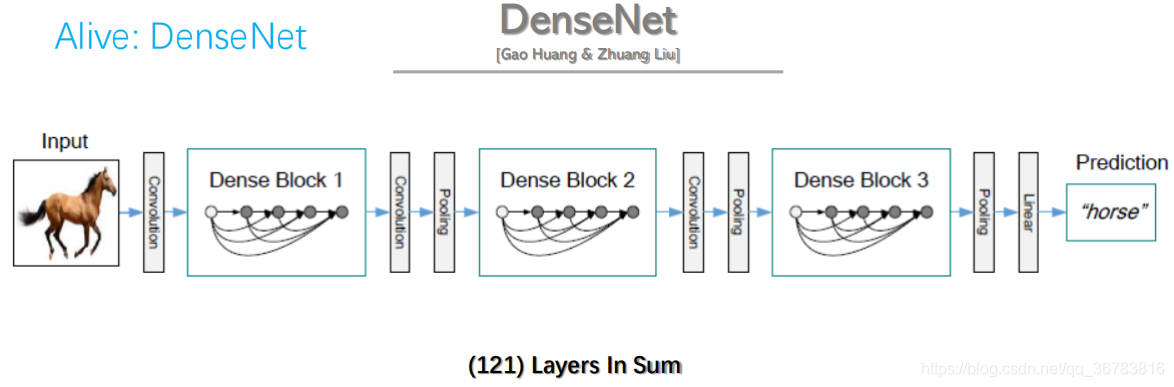

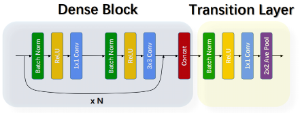

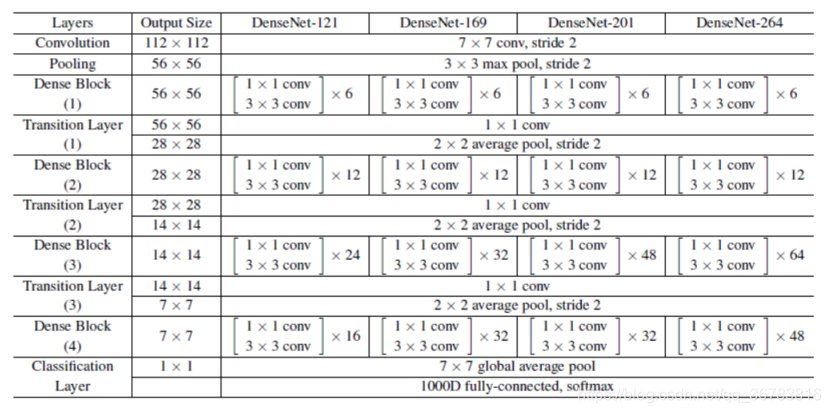

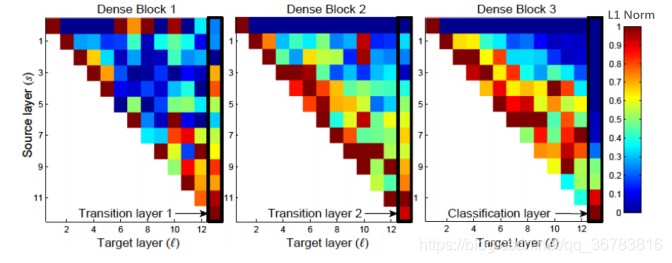

1.1.7 DenseNet

Cuanto más cerca esté la capa anterior,

Cuanto más importante sea la capa,

Cuantos más usos tendrá la capa.

Pros contras

Más adentro

Menos parámetros

Mejores resultados

Se necesitan muchos más recuerdos

(mejor no lo intentes en tus propios dispositivos)

[BP necesita salida de todas las capas]

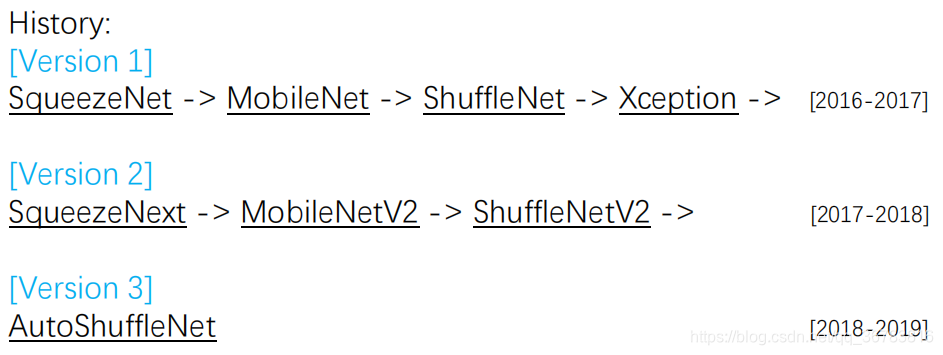

1.2 Marcos ligeros

Problemas: demasiado grande (memoria), demasiado lento (velocidad)

Características: muchos menos parámetros, mucho más rápido, enfoque en los dispositivos finales (es decir, sin GPU, teléfonos móviles, FPGA ...)

Cómo: encoger el modelo, cambiar la estructura

Ideas para la aceleración:

(1) Optimizar el marco de red: Shuffle Net

(2) Disminución de parámetros: Squeeze Net

(3) Optimizar Conv: Orden de cálculo: Red móvil; Método de cálculo: Winograd

(4) Eliminar FC: Squeeze Net, LightCNN

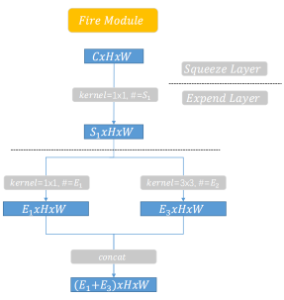

1.2.1 SqueezeNet

Ideas (de GogLeNet):

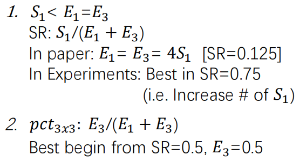

1 Use más 1 1 grano, MENOS CANTIDAD de 3 3 granos. 1 * 1 puede reducir el canal manteniendo el tamaño

2 CANALES MENOS NÚMERO de 3 * 3 granos. Reducir el número de parámetros directamente

3 Retraso para bajar la muestra (retraso para usar la combinación). Aumente el campo visual para obtener más información. Una compensación por la menor cantidad de parámetros.

Módulo Estructura-Fuego:

Algunos detalles:

Estructura-Macro: ¡La

estructura de cuello de botella es mejor!

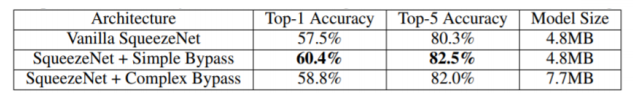

Precisión de SqueezeNet y tamaño de modelo usando diferentes configuraciones de microarquitectura