本课程是百度官方开设的零基础入门深度学习课程,主要面向没有深度学习技术基础或者基础薄弱的同学,帮助大家在深度学习领域实现从0到1+的跨越。从本课程中,你将学习到:

- 深度学习基础知识

- numpy实现神经网络构建和梯度下降算法

- 计算机视觉领域主要方向的原理、实践

- 自然语言处理领域主要方向的原理、实践

- 个性化推荐算法的原理、实践

本周为开讲第三周,百度深度学习技术平台部资深研发工程师孙高峰,开始讲解深度学习在计算机视觉方向实践应用。今天为大家带来的是卷积神经网络基础之池化和Relu。

池化(Pooling)

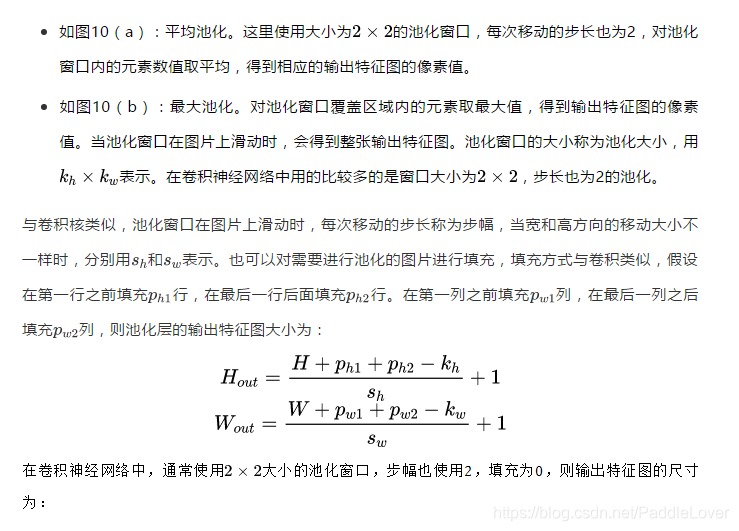

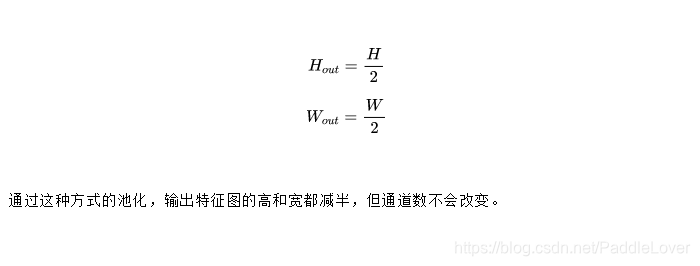

池化是使用某一位置的相邻输出的总体统计特征代替网络在该位置的输出,其好处是当输入数据做出少量平移时,经过池化函数后的大多数输出还能保持不变。比如:当识别一张图像是否是人脸时,我们需要知道人脸左边有一只眼睛,右边也有一只眼睛,而不需要知道眼睛的精确位置,这时候通过约化某一片区域的像素点来得到总体统计特征会显得很有用。由于池化之后特征图会变得更小,如果后面连接的是全连接层,能有效的减小神经元的个数,节省存储空间并提高计算效率。如 图10 所示,将一个2*2的区域池化成一个像素点。通常有两种方法,平均池化和最大池化。

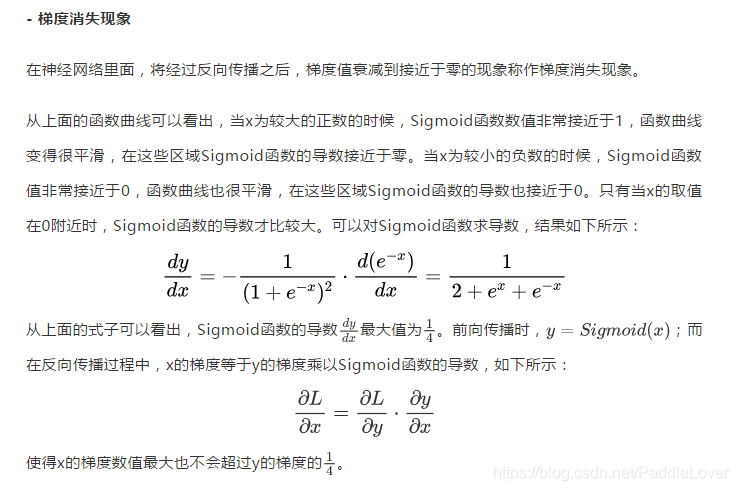

ReLU激活函数

# ReLU和Sigmoid激活函数示意图

import numpy as np

import matplotlib.pyplot as plt

import matplotlib.patches as patches

plt.figure(figsize=(10, 5))

# 创建数据x

x = np.arange(-10, 10, 0.1)

# 计算Sigmoid函数

s = 1.0 / (1 + np.exp(0. - x))

# 计算ReLU函数

y = np.clip(x, a_min=0., a_max=None)

#####################################

# 以下部分为画图代码

f = plt.subplot(121)

plt.plot(x, s, color='r')

currentAxis=plt.gca()

plt.text(-9.0, 0.9, r'$y=Sigmoid(x)$', fontsize=13)

currentAxis.xaxis.set_label_text('x', fontsize=15)

currentAxis.yaxis.set_label_text('y', fontsize=15)

f = plt.subplot(122)

plt.plot(x, y, color='g')

plt.text(-3.0, 9, r'$y=ReLU(x)$', fontsize=13)

currentAxis=plt.gca()

currentAxis.xaxis.set_label_text('x', fontsize=15)

currentAxis.yaxis.set_label_text('y', fontsize=15)

plt.show()

总结

本文重点展开讲解了卷积神经网络里面的常用模块,如池化和Relu。在后期课程中,将继续为大家带来内容更丰富的课程,帮助学员快速掌握深度学习方法。

【如何学习】

如何观看配套视频?如何代码实践?

视频+代码已经发布在AI Studio实践平台上,视频支持PC端/手机端同步观看,也鼓励大家亲手体验运行代码哦。扫码或者打开以下链接:

https://aistudio.baidu.com/aistudio/course/introduce/888

学习过程中,有疑问怎么办?

加入深度学习集训营QQ群:726887660,班主任与飞桨研发会在群里进行答疑与学习资料发放。

如何学习更多内容?

百度飞桨将通过飞桨深度学习集训营的形式,继续更新《零基础入门深度学习》课程,由百度深度学习高级研发工程师亲自授课,每周二、每周四8:00-9:00不见不散,采用直播+录播+实践+答疑的形式,欢迎关注~