一、 摘要

refinement module 包含2个模块(anchor refinement module 和 object detection module)

anchor refinement module --- 去掉负样本的anchor, 缩小分类器的搜索空间

object detection module --- 粗略的调整anchors 的位置和大小,为后面的回归提供更优质的anchors

同时设计一个transfer connection block, 将 anchor refinement module的特征transfer到object detection module模块进行预测目标的位置,大小和类别

二、 引言

相比于one-stage detector, Faster RCNN , R-FCN, FPN有3个优点:

1. two-stage structure 启发式的采样能够处理类别不均衡的问题。

2. 利用two-stage 级联回归目标box的参数。

3. 使用two-stage 特征来描述目标

40.2 FPS on Tian X GPU (320x320)

24.1FPS on Tian X GPU (512x512)

三、相关工作

经典的目标检测:

采用划动窗机制,利用手工特征和分类器在稠密的图像网格中找到目标。Viola and Jones 利用haar 特征和adaBoost为人脸检测训练一系列的级联分类器。DPM 利用部件形变模型来处理变化较大的目标。

two-stage 方法:

two-satge包含两部分,第一部分生成稀疏的object proposals,第二部分定义目标的位置和类别

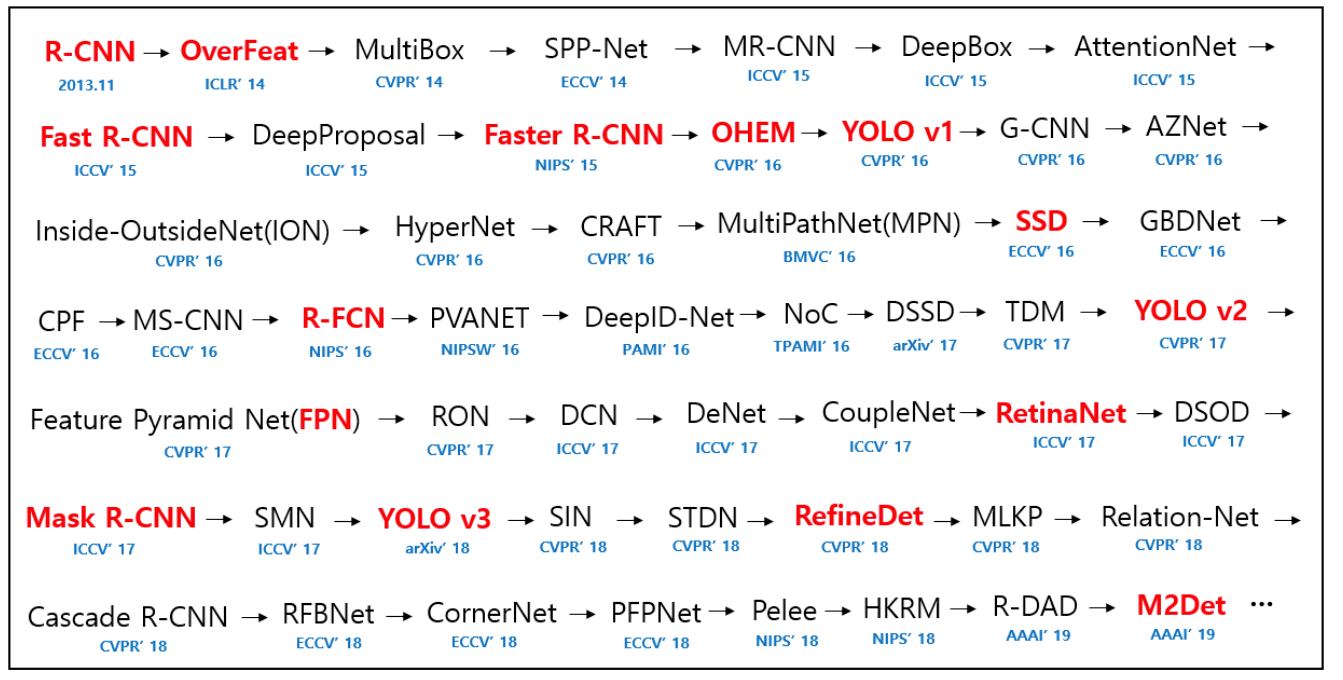

one-stage方法:

yolo1-yolo3

yolo1直接利用一个前向网络预测目标的位置和类别,yolo2在yolo1的基础上增加了bn, 使用高分辨率的分类器,anchor boxes等,SSD在不同的层采用不同尺度的anchors,不同的层进行预测。 Focal loss处理类别不均衡问题。

四、网络结构

1. Transfer connection block

TCBs的一个功能是将ARM中不同层的特征转换到ODM所需要的形式,另一个功能是融合大尺度的上下文信息到转换的特征中去提升检测精度,为了匹配他们的维度,采用deconv操作提高高层特征的尺度,然后与转换的特征对应元素相加,在相加之后增加一个卷积层确保特征的判别性。

2. two-stage 级联回归

使用ARM首先调整anchors的位置和大小,然后传递给ODM。在每个特征图的cell中,从原始的anchors 中预测4个偏移量和相应的置信度,得到refined的anchors之后,将其传递给ODM进一步的生成目标的类别和精确的目标位置和大小。每个refined anchors 生成c+4的输出。

3. Negative anchors filtering

在训练阶段,对于一个refined anchor, 如果他的负样本得分高于一个阈值(0.99),则在训练ODM时舍弃该样本,仅仅传递hard negative anchor和 refined positive anchor来训练ODM, 同时,在测试阶段,Negative anchor高于一个阈值,则舍弃。

五、 训练和推理

1. data augmentation

随机扩大和裁剪训练图像(方法参照SSD: single shot multibox detector)

2. backbone network

VGG-16, ResNet-101

3. anchors design 和matching

按照total stride size 8, 16, 32 ,64选择四个特征层,每个特征层有一个特定尺度的anchor(这个anchor 的大为该层total stride的4倍大小)和3个其他尺度的anchor(0.5, 1.0, 2.0)

4. hard negative mining

大部分的anchor为负样本Negative:positive= 3:1,选择loss值大的负样本

5. loss function

loss=loss_arm+loss_odm

在ARM阶段,给每个anchor一个二元标签(是目标或者不是目标),并且回归位置和大小得到refined anchors, 然后pass refined anchors(negative anchor 置信度高于阈值的舍弃)到ODM,然后得到精确的目标位置和大小