1x1卷积的主要作用有以下几点:

1、降维( dimension reductionality )。比如,一张512 x 512且厚度depth为100 的图片在26个filter上做1x1的卷积,那么结果的大小为512*512*20。

2、加入非线性。卷积层之后经过激励层,1x1的卷积在前一层的学习表示上添加了非线性激励( non-linear activation ),提升网络的表达能力;

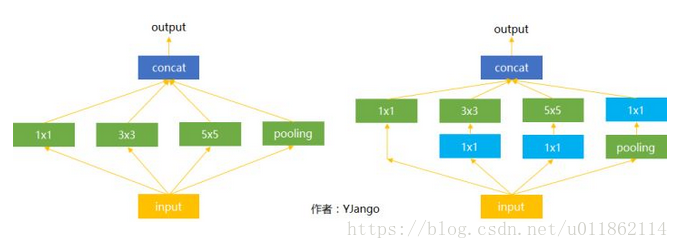

下图是Inception模块,为了消除尺寸对于识别结果的影响,一次性使用多个不同filter size来抓取多个范围不同的概念,让网络能够自己选择需要的特征。可以看到在Inception模块中,每个分支都加上一个1x1卷积的部分,这里1x1卷积的作用是让网络根据需要能够更灵活地控制数据的depth(即通道数),通过1x1卷积,可以将不同分支的feature map通道数调整到一直,便于后续操作(相加或concat)。这里的1x1卷积不止能降维,也可以升维,这完全取决与1x1卷积的通道数。

3、跨通道信息交互(channal 的变换)

如:使用1x1卷积核,实现降维和升维的操作其实就是channel间信息的线性组合变化,3x3x64channels的卷积核前面添加一个1x1x28channels的卷积核,就变成了3x3x28channels的卷积核,原来的64个channels就可以理解为跨通道线性组合变成了28channels,这就是通道间的信息交互。