文章目录

传统文件系统

HDFS文件系统

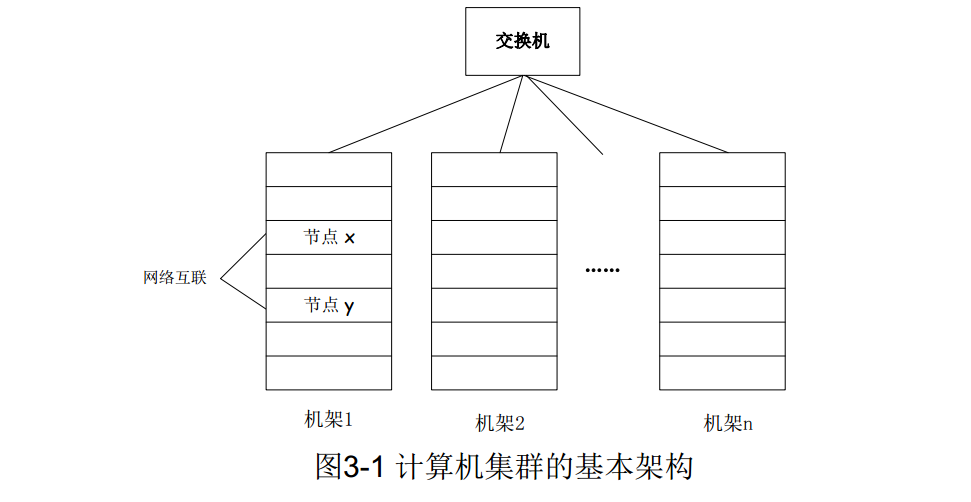

分布式文件系统,是建立结点(物理机器)的结构之上的,所以首先本部分将首先看看计算机物理集群结构的基本特点。随后,在此基础上,设计逻辑层面的结构,以最大化利用物理集群结构的特点。

所谓逻辑结构的设计,即在组件层面、进程层面的设计,到达此层面,底层的物理结构便不需要考虑了。即,可以理想认为所有的逻辑元素都在一个拥有无限资源的超级计算机上。

HDFS设计的目标

- 兼容廉价的硬件设备

- 流数据读写

- 大数据集

- 简单的文件模型

- 强大的跨平台兼容性

后面的设计,分别对应解决上面目标中的一个或者几个,所以有必要经常回顾下此处的目标。

计算机集群的基本结构

- 分布式文件系统把文件分布存储到多个计算机节点上,成千上万的计算机节点构成计

算机集群 - 与之前使用多个处理器和专用高级硬件的并行化处理装置不同的是,目前的分布式文

件系统所采用的计算机集群,都是由普通硬件构成的,这就大大降低了硬件上的开销(普通硬件,意味着易发生错误,降低可靠性,后面需要通过某种机制(如副本机制)将这种可靠性弥补回来)

建构在上述物理结构之上的逻辑结构

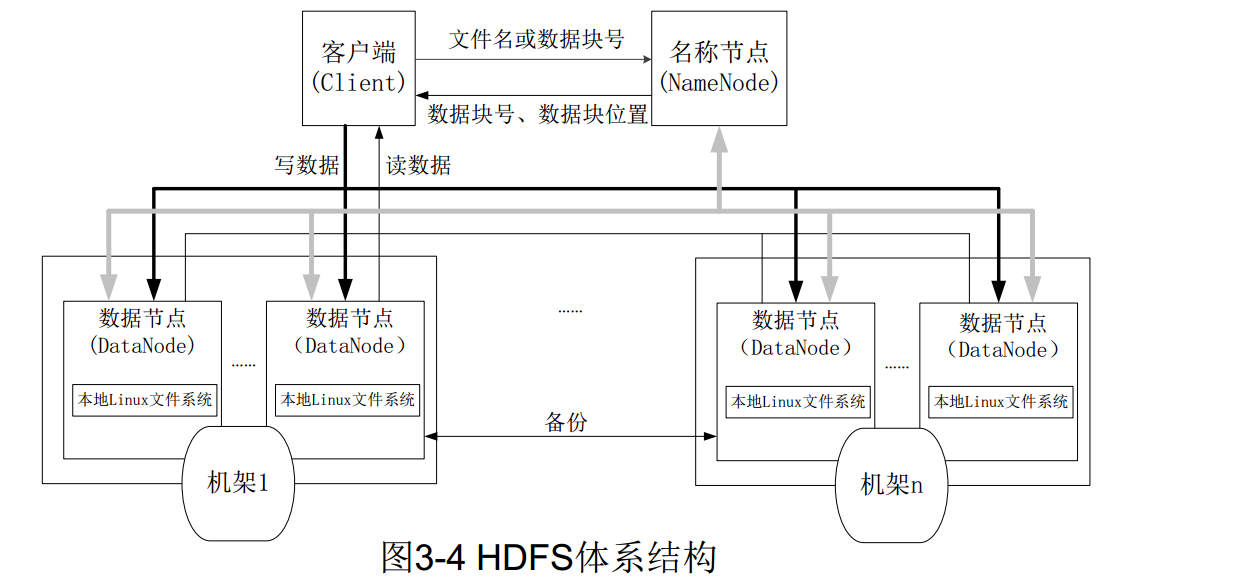

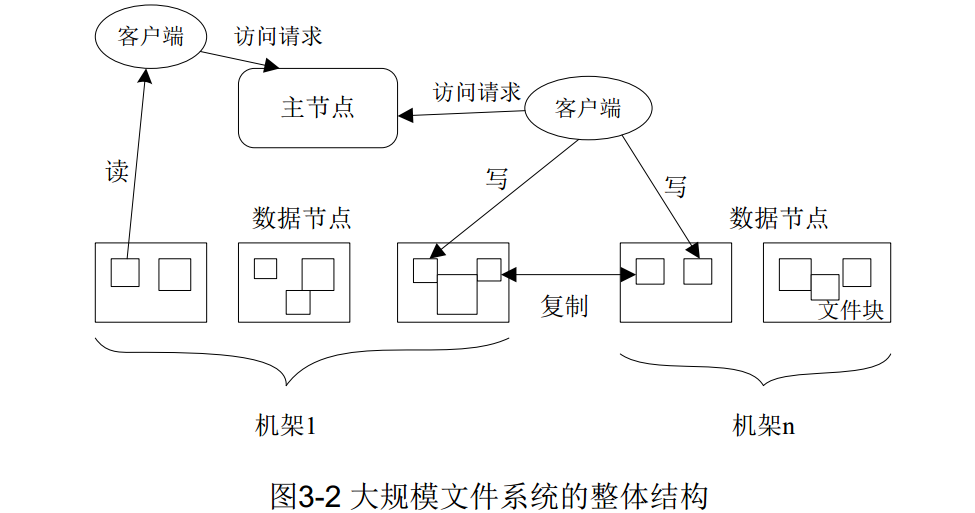

分布式文件系统在物理结构上是由计算机集群中的多个节点构成的,这些节点分为两类,一类叫“主节点” (Master Node)或者也被称为“名称结点” (NameNode),另一类叫“从节点”(Slave Node)或者也被称为“数据节点” (DataNode)

HDFS的基本架构

这里以hadoop1为例。

HDFS采用了主从(Master/Slave)结构模型,一个HDFS集群包括一个名称节点(NameNode)和若干个数据节点(DataNode)(如图3-4所示)。

- 名称节点作为中心服务器,负责管理文件系统的命名空间及客户端对文件的访问。

- 集群中的数据节点一般是一个节点运行一个数据节点进程,负责处理文件系统客户端的读/写请求,在名称节点的统一调度下进行数据

块的创建、删除和复制等操作。 - 每个数据节点的数据实际上是保存在本地Linux文件系统中的

【对于主从结构的理解】主从结构,站在图的角度来看,其形态更符合星形的结构。而这种结构中,结点是不对等的,入度、出度不同,意味着彼此影响的也是不同的。

HDFS命名空间管理

- HDFS的命名空间包含目录、 文件和块

- 在HDFS1.0体系结构中, 在整个HDFS集群中只有一个命名空间, 并且只有唯一一个

名称节点, 该节点负责对这个命名空间进行管理 - HDFS使用的是传统的分级文件体系, 因此, 用户可以像使用普通文件系统一样, 创

建、 删除目录和文件, 在目录间转移文件, 重命名文件等

通信协议

- HDFS是一个部署在集群上的分布式文件系统, 因此, 很多数据需要通过网络进行

传输 - 所有的HDFS通信协议都是构建在TCP/IP协议基础之上的

- 客户端通过一个可配置的端口向名称节点主动发起TCP连接, 并使用客户端协议与

名称节点进行交互 - 名称节点和数据节点之间则使用数据节点协议进行交互

- 客户端与数据节点的交互是通过RPC(Remote Procedure Call) 来实现的。 在设

计上, 名称节点不会主动发起RPC, 而是响应来自客户端和数据节点的RPC请求

客户端

- 客户端是用户操作HDFS最常用的方式, HDFS在部署时都提供了客户端

- HDFS客户端是一个库, 暴露了HDFS文件系统接口, 这些接口隐藏了HDFS实现中的

大部分复杂性 - 严格来说, 客户端并不算是HDFS的一部分

- 客户端可以支持打开、 读取、 写入等常见的操作, 并且提供了类似Shell的命令行

方式来访问HDFS中的数据 - 此外, HDFS也提供了Java API, 作为应用程序访问文件系统的客户端编程接口

HDFS体系结构的局限性

HDFS只设置唯一一个名称节点,这样做虽然大大简化了系统设计,但也带来了一些

明显的局限性,具体如下:

(1) 命名空间的限制:名称节点是保存在内存中的,因此,名称节点能够容纳的

对象(文件、块)的个数会受到内存空间大小的限制。

(2) 性能的瓶颈:整个分布式文件系统的吞吐量,受限于单个名称节点的吞吐量。

(3) 隔离问题:由于集群中只有一个名称节点,只有一个命名空间,因此,无法

对不同应用程序进行隔离。

(4) 集群的可用性:一旦这个唯一的名称节点发生故障,会导致整个集群变得不

可用。

HDFS 的关键底层结构

块(文件处理的基本单元)

HDFS默认一个块64MB,一个文件被分成多个块,以块作为存储单位。

块的大小远远大于普通文件系统,可以最小化寻址开销。

底层的基本结构,影响范围非常广。所以底层数据结构的设计一定要多花些时间,否则以后你可能要花费数倍的精力。

HDFS采用抽象的块概念可以带来以下几个明显的好处:

- 支持大规模文件存储:文件以块为单位进行存储,一个大规模文件可以被分拆

成若干个文件块,不同的文件块可以被分发到不同的节点上,因此,一个文件的大小

不会受到单个节点的存储容量的限制,可以远远大于网络中任意节点的存储容量 - 简化系统设计:首先,大大简化了存储管理,因为文件块大小是固定的,这样

就可以很容易计算出一个节点可以存储多少文件块;其次,方便了元数据的管理,元

数据不需要和文件块一起存储,可以由其他系统负责管理元数据 - 适合数据备份:每个文件块都可以冗余存储到多个节点上,大大提高了系统的

容错性和可用性

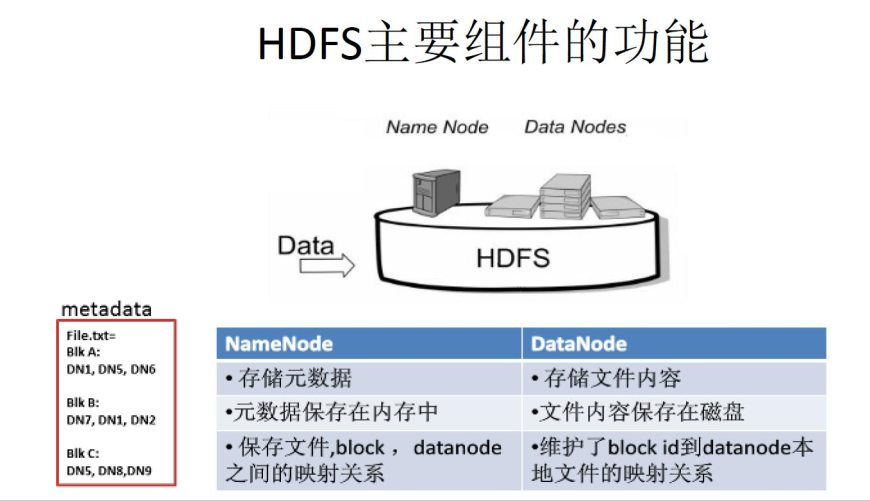

名称节点

文件树状结构组织方式

- HDFS整个文件系统的namespace在namenode的内存中,是以一棵树的结构来维护的。

- 在HDFS中,不管是目录还是文件,都被看作是INode,如果是目录,则其实际类标识为INodeDirectory,如果是文件,则其相应的类标识为INodeFile,这两个类都是INode的派生类。INodeDirectory中包含一个成员数组变量List children,如果该目录下有子目录或者文件,其子目录或文件的引用就会保存在children列表中。HDFS就是通过这种方式来维持整个文件系统的目录结构。

名称结点的关键数据结构(文件状态维护)

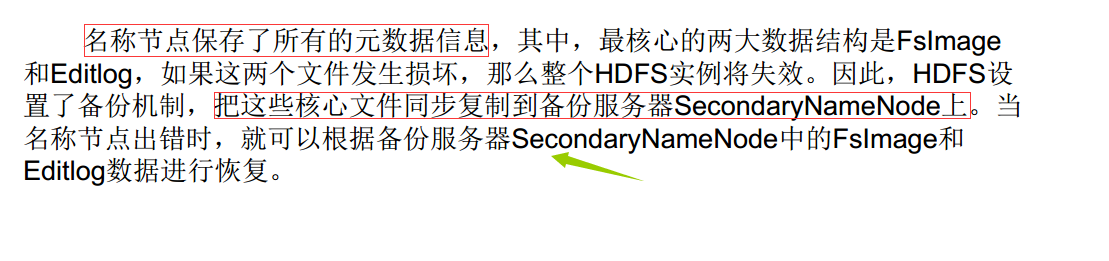

在HDFS中,名称节点(NameNode)负责管理分布式文件系统的命名空间

(Namespace),保存了两个核心的数据结构,即FsImage和EditLog

- 【FsImage】用于维护文件系统树以及文件树中所有的文件和文件夹的元数据

- 【EditLog】操作日志文件EditLog中记录了所有针对文件的创建、删除、重命名等操作(个人感觉主要是对文件元数据的修改)

- 名称节点记录了每个文件中各个块所在的数据节点的位置信息

给定初始数据及状态,及操作序列,那么很容易从初始推到某个时刻的状态。所以此处设计了FsImage及EditLog两个数据结构,其中FsImage存储状态,EditLog负责存储操作序列。两个结构结合,便能够推出某个时刻文件系统的状态。

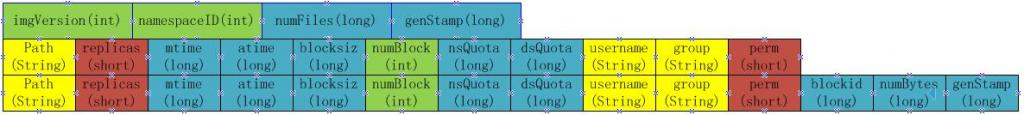

FsImage文件

该数据结构可存储在内存或磁盘中

- FsImage文件包含文件系统中所有目录和文件inode的序列化形式。每个inode是一

个文件或目录的元数据的内部表示,并包含此类信息:文件的复制等级、修改和访问

时间、访问权限、块大小以及组成文件的块。对于目录,则存储修改时间、权限和配

额元数据 - FsImage文件没有记录块存储在哪个数据节点。而是由名称节点把这些映射保留在

内存中,当数据节点加入HDFS集群时,数据节点会把自己所包含的块列表告知给名

称节点,此后会定期执行这种告知操作,以确保名称节点的块映射是最新的。

当namenode重启加载fsimage时,就是按照如下格式协议从文件流中加载元数据信息。从fsimag的存储格式可以看出,fsimage保存有如下信息:

-

首先是一个image head,其中包含:

a) imgVersion(int):当前image的版本信息

b) namespaceID(int):用来确保别的HDFS instance中的datanode不会误连上当前NN。

c) numFiles(long):整个文件系统中包含有多少文件和目录

d) genStamp(long):生成该image时的时间戳信息。

-

接下来便是对每个文件或目录的源数据信息,如果是目录,则包含以下信息:

a) path(String):该目录的路径,如”/user/build/build-index”

b) replications(short):副本数(目录虽然没有副本,但这里记录的目录副本数也为3)

c) mtime(long):该目录的修改时间的时间戳信息

d) atime(long):该目录的访问时间的时间戳信息

e) blocksize(long):目录的blocksize都为0

f) numBlocks(int):实际有多少个文件块,目录的该值都为-1,表示该item为目录

g) nsQuota(long):namespace Quota值,若没加Quota限制则为-1

h) dsQuota(long):disk Quota值,若没加限制则也为-1

i) username(String):该目录的所属用户名

j) group(String):该目录的所属组

k) permission(short):该目录的permission信息,如644等,有一个short来记录。

-

若从fsimage中读到的item是一个文件,则还会额外包含如下信息:

a) blockid(long):属于该文件的block的blockid,

b) numBytes(long):该block的大小

c) genStamp(long):该block的时间戳

当该文件对应的numBlocks数不为1,而是大于1时,表示该文件对应有多个block信息,此时紧接在该fsimage之后的就会有多个blockid,numBytes和genStamp信息。(序列化存储在本地文件中)

因此,在namenode启动时,就需要对fsimage按照如下格式进行顺序的加载,以将fsimage中记录的HDFS元数据信息加载到内存中。

EditLog此处不再详述

参考:深度了解namenode—其 内部关键数据结构原理简介

名称节点的启动

- 在名称节点启动的时候,它会将FsImage文件中的内容加载到内存中,之后再执行

EditLog文件中的各项操作,使得内存中的元数据和实际的同步,存在内存中的元数

据支持客户端的读操作。 - 一旦在内存中成功建立文件系统元数据的映射,则创建一个新的FsImage文件和一个

空的EditLog文件 - 名称节点起来之后, HDFS中的更新操作会重新写到EditLog文件中,因为FsImage

文件一般都很大(GB级别的很常见),如果所有的更新操作都往FsImage文件中添

加,这样会导致系统运行的十分缓慢,但是,如果往EditLog文件里面写就不会这样

,因为EditLog 要小很多。每次执行写操作之后,且在向客户端发送成功代码之前,

edits文件都需要同步更新

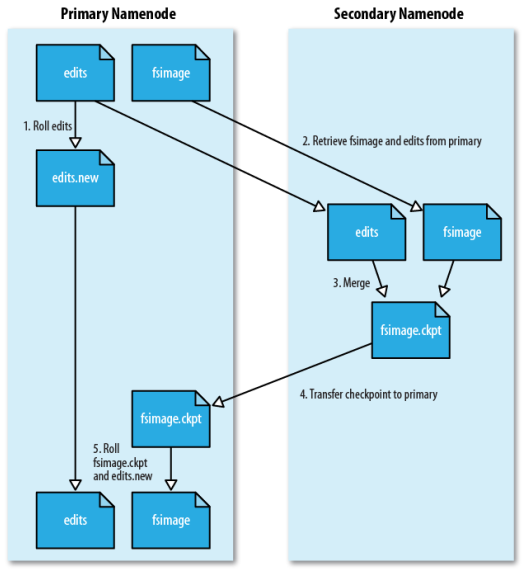

处理名称节点运行期间EditLog不断变大的问题

- 在名称节点运行期间, HDFS的所有更新操作都是直接写到EditLog中,久而久之, EditLog文

件将会变得很大 - 虽然这对名称节点运行时候是没有什么明显影响的,但是,当名称节点重启的时候,名称节点

需要先将FsImage里面的所有内容映像到内存中,然后再一条一条地执行EditLog中的记录,当

EditLog文件非常大的时候,会导致名称节点启动操作非常慢,而在这段时间内HDFS系统处于

安全模式,一直无法对外提供写操作,影响了用户的使用 - 第二名称节点是HDFS架构中的一个组成部分,它是用来保存名称节点中对HDFS 元

数据信息的备份,并减少名称节点重启的时间。 SecondaryNameNode一般是单独运

行在一台机器上

SecondaryNameNode的工作情况:

- SecondaryNameNode会定期和NameNode通信,请求其停止使用EditLog文件,暂时将新的写操作写到一个新的文件edit.new上来,这个操作是瞬间完成,上层写日志的函数完全感觉不到差别;

- SecondaryNameNode通过HTTP GET方式从NameNode上获取到FsImage和EditLog文件,并下载到本地的相应目录下;

- SecondaryNameNode将下载下来的FsImage载入到内存,然后一条一条地执行EditLog文件中各项更新操作,使得内存中的FsImage保持最新;这个过程就是EditLog和FsImage文件合并

- SecondaryNameNode执行完(3)操作之后,会通过post方式将新的FsImage文件发送到NameNode节点上

- NameNode将从SecondaryNameNodeNameNode将从SecondaryNameNode接收到的新FsImage替换旧的FsImage文件,同时将edit.new替换EditLog文件,通过这个过程EditLog就变小了

块到结点的映射(BlockMap)

每个block对应到datanodes列表的信息在hadoop中并没有进行持久化存储,而是在所有datanode启动时,每个datanode对本地磁盘进行扫描,将本datanode上保存的block信息汇报给namenode,namenode在接收到每个datanode的块信息汇报后,将接收到的块信息,以及其所在的datanode信息等保存在内存中。HDFS就是通过这种块信息汇报的方式来完成 block -> datanodes list的对应表构建。Datanode向namenode汇报块信息的过程叫做blockReport,而namenode将block -> datanodes list的对应表信息保存在一个叫BlocksMap的数据结构中。

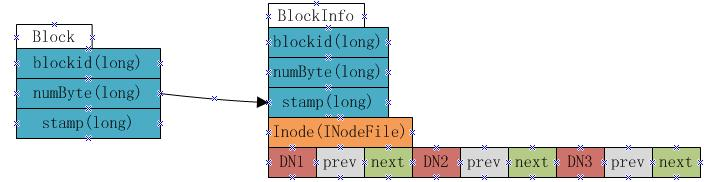

BlocksMap的内部数据结构如下:

BlocksMap实际上就是一个Block对象对BlockInfo对象的一个Map表,其中Block对象中只记录了blockid,block大小以及时间戳信息,这些信息在fsimage中都有记录。而BlockInfo是从Block对象继承而来,因此除了Block对象中保存的信息外,还包括代表该block所属的HDFS文件的INodeFile对象引用以及该block所属datanodes列表的信息(即上图中的DN1,DN2,DN3,该数据结构会在下文详述)。

因此在namenode启动并加载fsimage完成之后,实际上BlocksMap中的key,也就是Block对象都已经加载到BlocksMap中,每个key对应的value(BlockInfo)中,除了表示其所属的datanodes列表的数组为空外,其他信息也都已经成功加载。所以可以说:fsimage加载完毕后,BlocksMap中仅缺少每个块对应到其所属的datanodes list的对应关系信息。所缺这些信息,就是通过上文提到的从各datanode接收blockReport来构建。当所有的datanode汇报给namenode的blockReport处理完毕后,BlocksMap整个结构也就构建完成。

数据节点

- 数据节点是分布式文件系统HDFS的工作节点,负责数据的存储和读取,会根据客

户端或者是名称节点的调度来进行数据的存储和检索,并且向名称节点定期发送自己

所存储的块的列表 - 每个数据节点中的数据会被保存在各自节点的本地Linux文件系统中(站在linux文件系统的基础上)

【提升可靠性】数据冗余

冗余数据保存

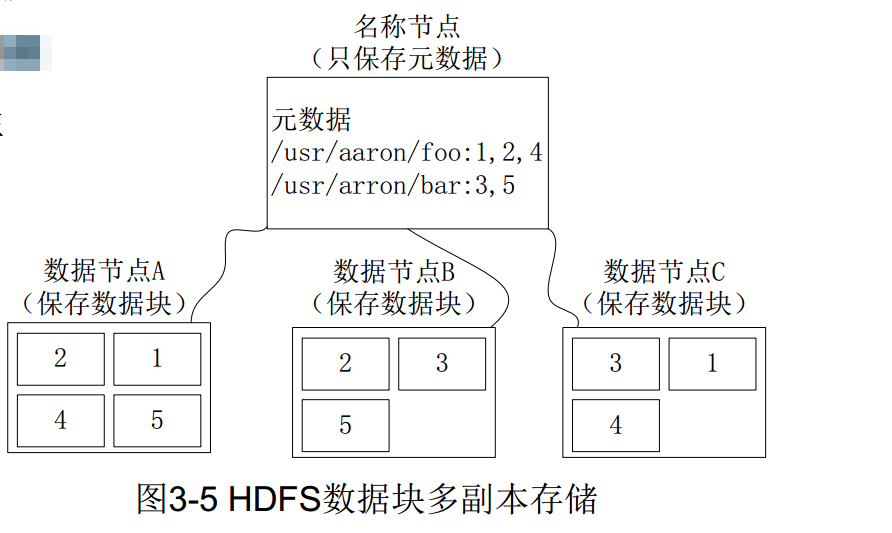

作为一个分布式文件系统,为了保证系统的容错性和可用性, HDFS采用了多副

本方式对数据进行冗余存储,通常一个数据块的多个副本会被分布到不同的数据节点

上,如图3-5所示,数据块1被分别存放到数据节点A和C上,数据块2被存放在数据节

点A和B上。这种多副本方式具有以下几个优点:

- 加快数据传输速度

- 容易检查数据错误

- 保证数据可靠性

数据存取策略

数据读取:

- HDFS提供了一个API可以确定一个数据节点所属的机架ID,客户端也可以调用API

获取自己所属的机架ID - 当客户端读取数据时,从名称节点获得数据块不同副本的存放位置列表,列表中包

含了副本所在的数据节点,可以调用API来确定客户端和这些数据节点所属的机架ID,当发现某个数据块副本对应的机架ID和客户端对应的机架ID相同时,就优先选择该副本读取数据,如果没有发现,就随机选择一个副本读取数据

数据错误与恢复

HDFS具有较高的容错性,可以兼容廉价的硬件,它把硬件出错看作一种常态,

而不是异常,并设计了相应的机制检测数据错误和进行自动恢复,主要包括以下几种

情形:名称节点出错

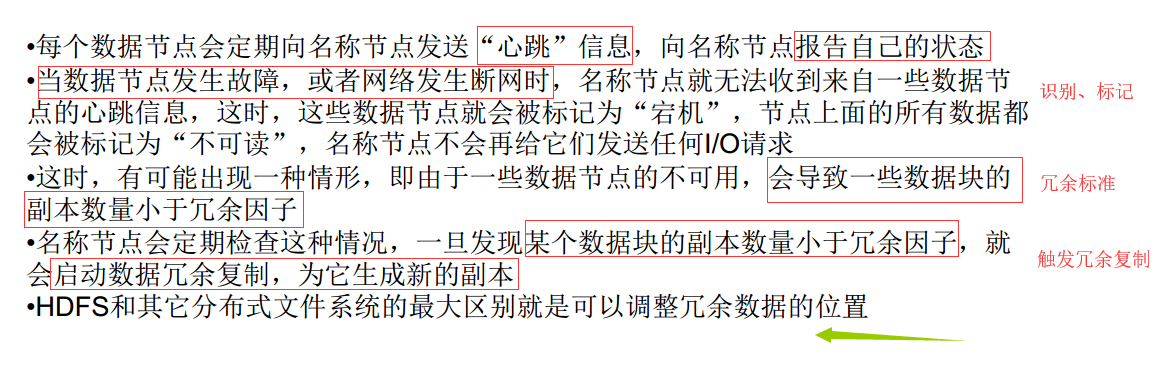

数据节点出错

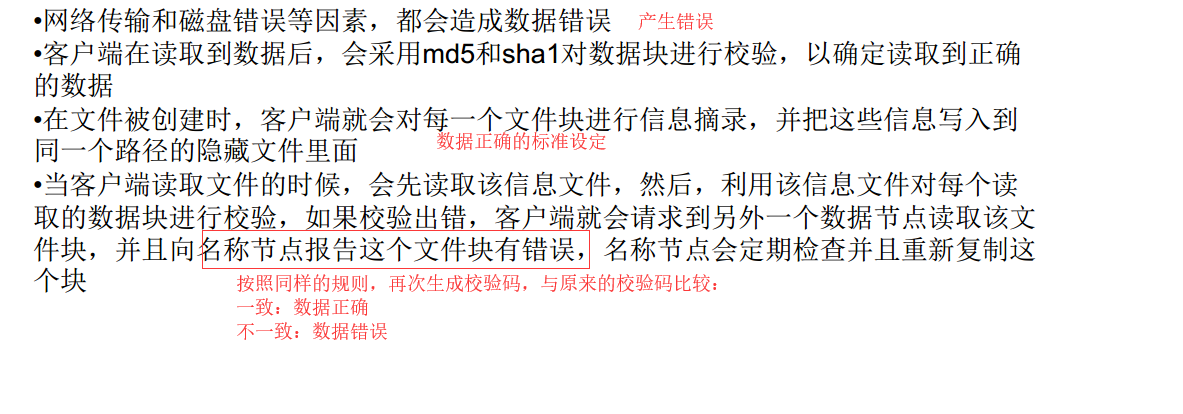

数据出错 (校验码)

名称结点出错

数据结点出错

数据错误

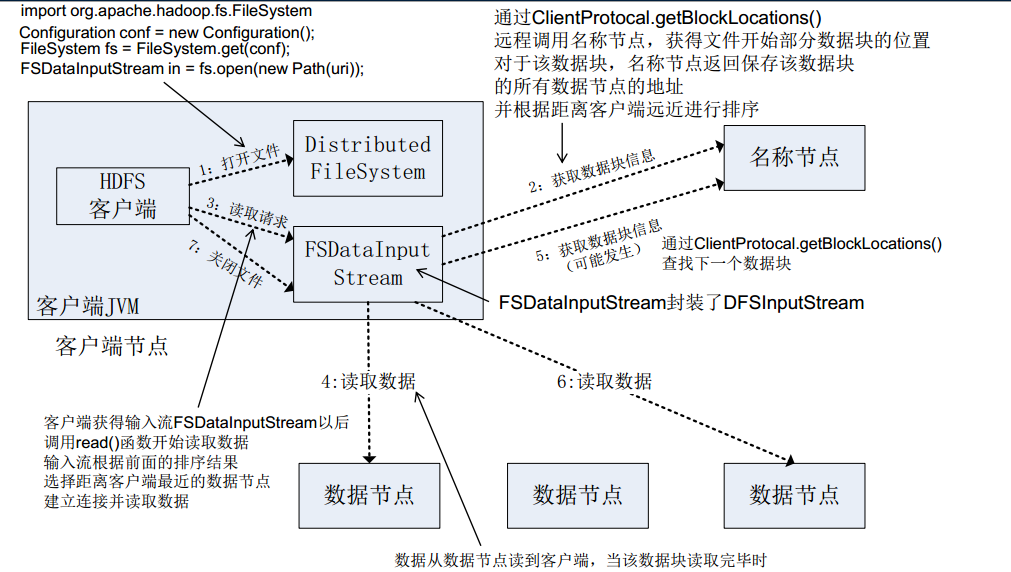

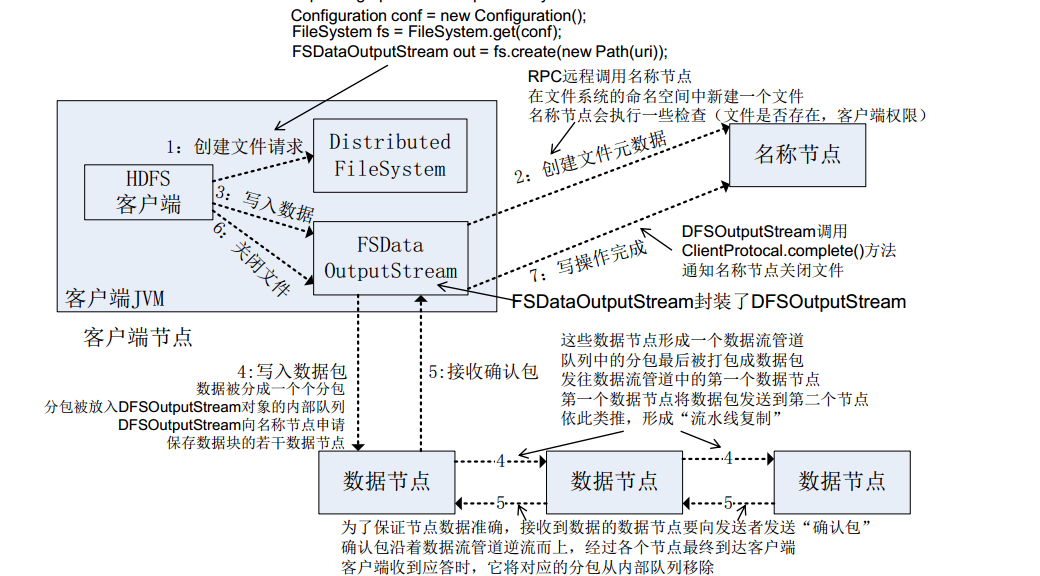

HDFS 读写过程

读的过程