一、 最小二乘法的由来

1805年,法国数学家Legendre发表了最小二乘法的第一个清晰简洁的论述;

1809年,德国数学家高斯发表了《天体运动论》,并声称自1795年以来就使用了最小二乘法。导致了与Legendre的优先权争议。

1829年,高斯提供了最小二乘法的优化效果强于其他方法的证明(高斯-马尔可夫定理)

二、参数估计——最小二乘法(正规方程)

1. 一元线性回归

对于一元线性回归模型 ![]() ,其中 ei 表示误差,可得

,其中 ei 表示误差,可得 ![]()

假设从总体中获取了n组观察值(X1,Y1),(X2,Y2), …,(Xn,Yn)。对于平面中的这n个点,可以使用无数条曲线来拟合。要求样本回归函数尽可能好地拟合这组值。综合起来看,这条直线处于样本数据的中心位置最合理。 选择最佳拟合曲线的标准可以确定为:使总的拟合误差(即总残差)达到最小。有以下三个标准可以选择:

(1)用“残差和最小”确定直线位置是一个途径。但很快发现计算“残差和”存在相互抵消的问题。

(2)用“残差绝对值和最小”确定直线位置也是一个途径。但绝对值的计算比较麻烦。

(3)最小二乘法的原则是以“残差平方和最小”确定直线位置。用最小二乘法除了计算比较方便外,得到的估计量还具有优良特性。这种方法对异常值非常敏感。

最常用的是普通最小二乘法( Ordinary Least Square,OLS):所选择的回归模型应该使所有观察值的残差平方和达到最小

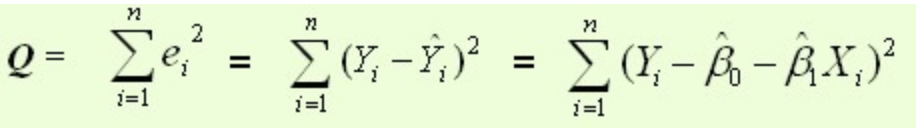

数学公式表达:Q为残差平方和——

要使得Q最小,即求Q得极值。把![]() 看做变量,然后对

看做变量,然后对![]() 求偏导,可得:

求偏导,可得:

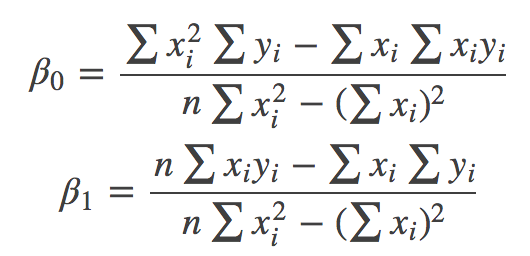

然后对上述两个偏导进一步消元、计算可得:

这样我们就可以确定![]() ,得到回归模型。最后将数据代入带这个模型中,即可得到我们要的结果。

,得到回归模型。最后将数据代入带这个模型中,即可得到我们要的结果。

2. 多元线性回归

推广到更一般的情况,假如有更多的模型变量 x1,x2,⋯,xn,可以用线性函数表示如下:

![]()

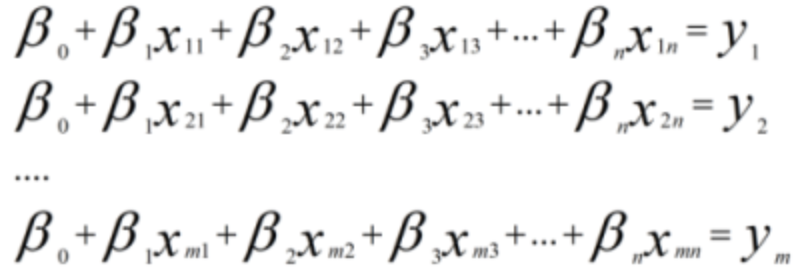

对于m个样本来说,可以用如下线性方程组表示:

如果将样本矩阵xij记为矩阵A,将参数矩阵记为向量β,真实值记为向量Y,上述线性方程组可以表示为:

即

即 ![]()

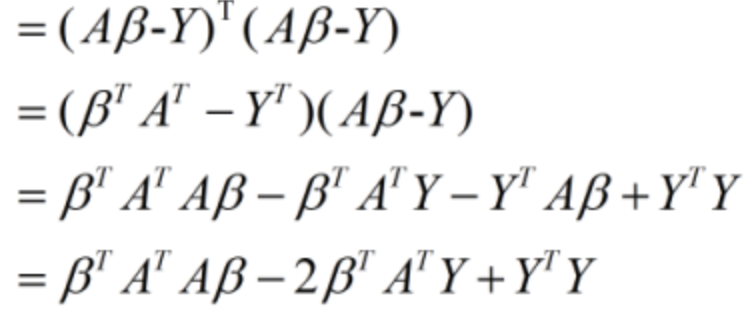

对于最小二乘来说,最终的矩阵表达形式可以表示为:

![]() (这里涉及到向量范式)

(这里涉及到向量范式)

其中m≥n,由于考虑到了常数项,故属性值个数由n变为n+1

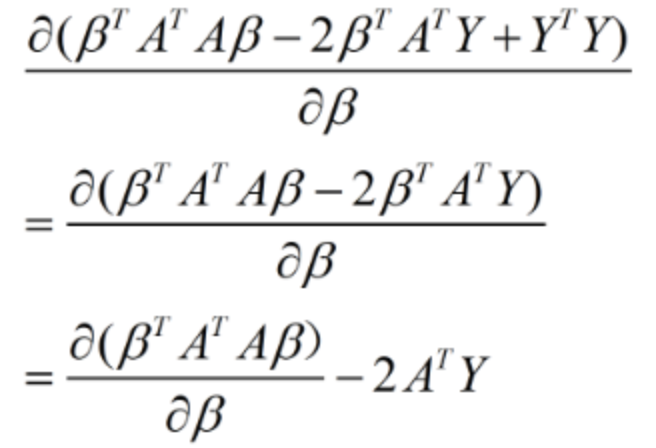

该方程的求解过程如下:

![]()

其中倒数第二行中的中间两项为标量,所以二者相等。然后利用该式对向量β求导:

(1)

(1)

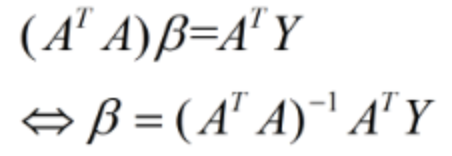

令上式结果等于0可得:

(2)

(2)

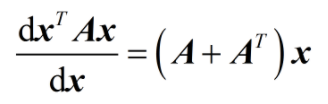

注:(1)式是根据向量矩阵求导公式求导得到后面的式子

参考:https://blog.csdn.net/qll125596718/article/details/8248249