- probabilistic & estimation:常用分布,共轭特性,最大似然估计,最大后验估计,指数族和自然参数

- statistic properties:辅助机器学习算法证明,包括重要的切比雪夫不等式和马尔科夫不等式

1. 概率&估计-Probabilistic & Estimation

1.1 高斯分布与高阶矩

1-D高斯情况:![]()

k-D高斯情况:![]()

多元高斯函数的一阶矩(Fisrt Order Moment)-期望:

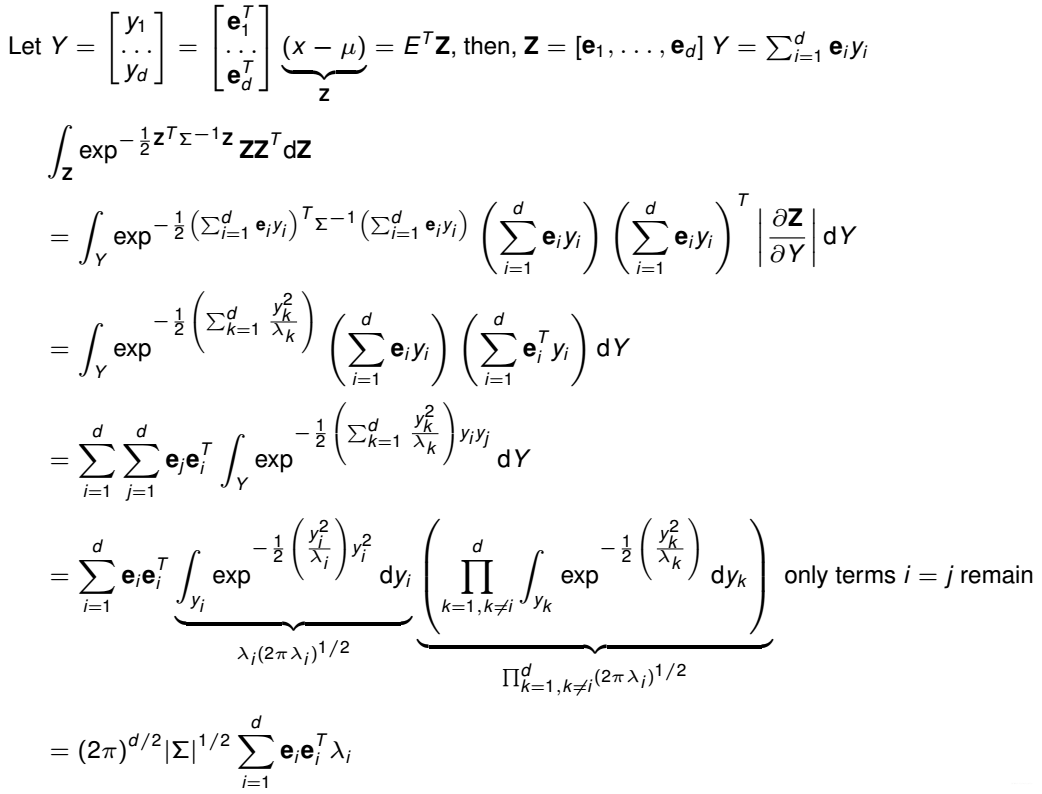

多元高斯函数的二阶矩(Second Order Moment) :

现在,改变轴使得向量x-μ特征向量对齐:

1.2 一些重要的且常用的分布

我们要研究的大多数分布来源于指数族。指数族分布可以用自然参数e进行表示:

![]()

- 实际上高斯分布就是一种特殊的指数分布,1-D高斯分布证明如下。

- Gamma分布与Inverse-Gamma分布(x<0, pdf=0不予讨论)

Gamma函数及其性质:

Gamma / Inverse-Gamma Distribution (a>0形状参数,陡峭参数; b>0尺度参数,散布情况):

![]()

Gamma分布其实并不是很常用,但是它衍生出的卡方分布、指数分布、T分布非常有用。

- Wishart分布与Invert-Wishart分布

- weight 分布

k-D Dirichlet 分布:

实际上k-D Dirichlet分布就是Beta分布在高维情形的推广。在贝叶斯推断中,Dirichlet分布作为多项分布的共轭先验得到应用,在machine learning中常被用于构建Dirichlet混合模型。

Beta分布:

machine learning中, Beta分布作为贝努利分布和二项分布的共轭先验分布的密度函数,广为应用。

- Discrete分布

k-D 多项分布:

特例-二项分布:

Bernouli分布:

![]()

Poission分布:

1.3 二项分布Binomal与泊松分布Poission之间的关系

也就是说,当二项分布中的试验次数n比较大,事件A在一次试验中发生的概率p比较小时,二项分布的一个事件发生次数的概率可以用泊松分布的概率来模拟。

1.4 非指数族分布

非指数族分布通常可以利用两个指数族分布构建。例如较著名的Student-t分布:

1.5 共轭-conjugacy

首先考虑后验与先验之间的关系:

如果p(θ|X)和p(θ)的概率密度同属于一个分布,那么后验概率将非常好求。例如,如果先验以及似然函数服从高斯分布,那么后要也一定属于高斯分布。

在贝叶斯统计中,如果后验分布与先验分布属于同类,则先验分布与后验分布被称为共轭分布,而先验分布被称为似然函数的共轭先验。假定似然函数p(X|θ)是已知的,问题就是我们选取什么样的先验分布p(θ),会让后验分布与先验分布具有相同的数学形式。共轭先验的好处主要在于代数上的方便性,可以直接给出后验分布的封闭形式,否则的话只能数值计算。共轭先验也有助于获得关于似然函数如何更新先验分布的直观印象。

这里需要特别补充的是所有指数家族的分布都有共轭先验。

1.6 最大似然估计 Maximum Likellihood Estimation

- 案例: 1-D 高斯

假定我们相信数据是服从高斯分布的。很明显蓝色的高斯分布曲线比绿色的高斯分布曲线更合理。但是这里我们需要用最大似然函数估计来解释为什么。

为了将乘法运算简化成加法运算,这里我们采用对数似然函数log-likelihood-function。上式转化为:

接下来分别对均值和方差分别求偏导等于0,就可以获得最大似然对应的参数。

1.7 最大后验 Maximum A Posterior-MAP

- 案例: 1-D 高斯

对于上面的问题,假设我们对μ有相同的先验知识,也就是说μ也服从高斯分布。那么这一类的估计称为最大后验MAP:

对于高斯情况,我们同样可以采用求偏导等于零,获取最大值对应的参数。