奇异值分解(Singular Value Decompostion, SVD) 是在机器学习领域广泛应用的算法,不光可以用于降维算法中的特征分解,还可以用于推荐系统,以及自然语言处理等领域,是很多机器学习算法的基石。本篇文章对SVD原理做主要讲解,在学习之前,确保你已经熟悉线性代数中的基本知识,包括特征值、特征向量、相似矩阵相关知识点。如果不太熟悉的话,推荐阅读如下两篇文章,如何理解矩阵特征值?知乎马同学的回答 和如何理解相似矩阵?马同学高等数学 ,读完之后再看本篇文章会有很大帮助。

我们首先回顾下特征值和特征向量的定义,如下所示。其中A是一个n×n的矩阵,x是一个n维向量,则我们说λ是矩阵A的一个特征值,x是矩阵A的特征值λ所对应的特征向量。但是求出特征值和特征向量有什么好处呢?

A

x

=

λ

x

Ax = \lambda x

A x = λ x

λ

1

≤

λ

2

≤

.

.

.

≤

λ

n

\lambda_1 \le \lambda_2 \le ...\le \lambda_n

λ 1 ≤ λ 2 ≤ . . . ≤ λ n

w

1

,

w

2

,

.

.

.

,

w

n

{w_1,w_2,...,w_n}

w 1 , w 2 , . . . , w n

A

=

W

Σ

W

−

1

A = W \Sigma W^{-1}

A = W Σ W − 1

∣

∣

w

i

∣

∣

2

=

1

||w_i||_2 = 1

∣ ∣ w i ∣ ∣ 2 = 1

w

i

T

w

i

=

1

w_i^Tw_i = 1

w i T w i = 1

W

T

W

=

I

W^TW = I

W T W = I

W

T

=

W

−

1

W^T = W^{-1}

W T = W − 1

A

=

W

Σ

W

T

A = W \Sigma W^T

A = W Σ W T

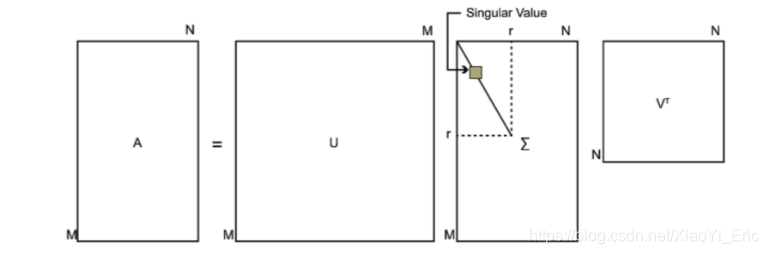

当矩阵A不是方阵时,可以用奇异值进行分解,假设我们的的矩阵A时一个m×n的矩阵,那么我们定义矩阵A的SVD为

A

=

U

Σ

V

T

A = U \Sigma V^T

A = U Σ V T

U

T

U

=

I

V

T

V

=

I

U^TU=I \\ V^TV = I

U T U = I V T V = I

A

T

A

A^TA

A T A

A

T

A

A^TA

A T A

(

A

T

A

)

v

i

=

λ

i

v

i

(A^TA)v_i = \lambda_i v_i

( A T A ) v i = λ i v i

A

T

A

A^TA

A T A

A

T

A

A^TA

A T A

同样,如果我们将A和A的转置做矩阵乘法,那么会得到m×m的一个方阵

A

A

T

AA^T

A A T

A

A

T

AA^T

A A T

(

A

A

T

)

u

i

=

λ

i

u

i

(AA^T)u_i = \lambda_i u_i

( A A T ) u i = λ i u i

A

A

T

AA^T

A A T

A

A

T

AA^T

A A T

U和V都已经求出,现在只有奇异值矩阵Σ没有求出。由于Σ除了对角线上是奇异值,其他位置都是0,因此我们只需要求出每个奇异值σ就可以了。我们注意到

A

=

U

Σ

V

T

A

V

=

U

Σ

V

T

V

A

V

=

U

Σ

A

v

i

=

u

i

σ

i

σ

i

=

A

v

i

u

i

A = U \Sigma V^T \\ AV = U \Sigma V^T V \\ AV = U \Sigma \\ Av_i = u_i \sigma_i \\ \sigma_i = \frac{Av_i}{u_i}

A = U Σ V T A V = U Σ V T V A V = U Σ A v i = u i σ i σ i = u i A v i

上面还有一个问题没有细讲,就是我们说

A

T

A

A^TA

A T A

A

A

T

AA^T

A A T

A

=

U

Σ

V

T

A

T

=

V

Σ

T

U

T

A

T

A

=

V

Σ

T

U

T

U

Σ

V

T

=

V

Σ

2

V

T

A = U \Sigma V^T \\ A^T = V \Sigma^T U^T \\ A^TA = V\Sigma^T U^T U \Sigma V^T = V \Sigma^2V^T

A = U Σ V T A T = V Σ T U T A T A = V Σ T U T U Σ V T = V Σ 2 V T

U

T

U

=

I

,

Σ

T

Σ

=

Σ

2

U^TU = I,\Sigma^T\Sigma = \Sigma^2

U T U = I , Σ T Σ = Σ 2

A

T

A

A^TA

A T A

A

A

T

AA^T

A A T

σ

i

=

λ

i

\sigma_i = \sqrt{\lambda_i}

σ i = λ i

σ

i

=

A

v

i

u

i

\sigma_i = \frac{Av_i}{u_i}

σ i = u i A v i

A

T

A

A^TA

A T A

下面我们通过一个简单例子来说明矩阵式如何进行奇异值分解的,假设矩阵A为

A

=

(

0

1

1

1

1

0

)

A = \begin{pmatrix} 0 & 1\\ 1 & 1\\ 1 & 0 \end{pmatrix}

A = ⎝ ⎛ 0 1 1 1 1 0 ⎠ ⎞

A

T

A

A^TA

A T A

A

A

T

AA^T

A A T

A

T

A

=

(

0

1

1

1

1

0

)

(

0

1

1

1

1

0

)

=

(

2

1

1

2

)

A^TA = \begin{pmatrix} 0 & 1 & 1\\ 1 & 1 & 0\\ \end{pmatrix} \begin{pmatrix} 0 & 1 \\ 1 & 1 \\ 1 & 0 \\ \end{pmatrix} = \begin{pmatrix} 2 & 1 \\ 1 & 2 \\ \end{pmatrix}

A T A = ( 0 1 1 1 1 0 ) ⎝ ⎛ 0 1 1 1 1 0 ⎠ ⎞ = ( 2 1 1 2 )

A

A

T

=

(

0

1

1

1

1

0

)

(

0

1

1

1

1

0

)

=

(

1

1

0

1

2

1

0

1

1

)

AA^T = \begin{pmatrix} 0 & 1 \\ 1 & 1 \\ 1 & 0 \\ \end{pmatrix} \begin{pmatrix} 0 & 1 & 1\\ 1 & 1 & 0\\ \end{pmatrix} = \begin{pmatrix} 1 & 1 & 0\\ 1 & 2 & 1\\ 0 & 1 & 1\\ \end{pmatrix}

A A T = ⎝ ⎛ 0 1 1 1 1 0 ⎠ ⎞ ( 0 1 1 1 1 0 ) = ⎝ ⎛ 1 1 0 1 2 1 0 1 1 ⎠ ⎞

进而求出

A

T

A

A^TA

A T A

λ

1

=

3

;

v

1

=

(

1

2

1

2

)

\lambda_1 = 3; v_1 = \begin{pmatrix} \frac{1}{\sqrt{2}} \\ \frac{1}{\sqrt{2}} \\ \end{pmatrix}

λ 1 = 3 ; v 1 = ( 2

1 2

1 )

λ

2

=

1

;

v

2

=

(

−

1

2

1

2

)

\lambda_2 = 1; v_2 = \begin{pmatrix} -\frac{1}{\sqrt{2}} \\ \frac{1}{\sqrt{2}} \\ \end{pmatrix}

λ 2 = 1 ; v 2 = ( − 2

1 2

1 )

求出

A

A

T

AA^T

A A T

λ

1

=

3

;

u

1

=

(

1

6

2

6

1

6

)

\lambda_1 = 3; u_1 = \begin{pmatrix} \frac{1}{\sqrt{6}} \\ \frac{2}{\sqrt{6}} \\ \frac{1}{\sqrt{6}} \\ \end{pmatrix}

λ 1 = 3 ; u 1 = ⎝ ⎜ ⎛ 6

1 6

2 6

1 ⎠ ⎟ ⎞

λ

2

=

1

;

u

2

=

(

1

2

0

−

1

2

)

\lambda_2 = 1; u_2 = \begin{pmatrix} \frac{1}{\sqrt{2}} \\ 0 \\ -\frac{1}{\sqrt{2}} \\ \end{pmatrix}

λ 2 = 1 ; u 2 = ⎝ ⎛ 2

1 0 − 2

1 ⎠ ⎞

λ

3

=

0

;

u

3

=

(

1

3

−

1

3

1

3

)

\lambda_3 = 0; u_3 = \begin{pmatrix} \frac{1}{\sqrt{3}} \\ -\frac{1}{\sqrt{3}} \\ \frac{1}{\sqrt{3}} \\ \end{pmatrix}

λ 3 = 0 ; u 3 = ⎝ ⎜ ⎛ 3

1 − 3

1 3

1 ⎠ ⎟ ⎞

利用

A

v

i

=

σ

i

u

i

,

i

=

1

,

2

Av_i = \sigma_i u_i, i = 1,2

A v i = σ i u i , i = 1 , 2

(

0

1

1

1

1

0

)

(

1

2

1

2

)

=

σ

1

(

1

6

2

6

1

6

)

⇒

σ

1

=

3

\begin{pmatrix} 0 & 1\\ 1 & 1\\ 1 & 0 \end{pmatrix} \begin{pmatrix} \frac{1}{\sqrt{2}} \\ \frac{1}{\sqrt{2}} \\ \end{pmatrix} = \sigma_1 \begin{pmatrix} \frac{1}{\sqrt{6}} \\ \frac{2}{\sqrt{6}} \\ \frac{1}{\sqrt{6}} \\ \end{pmatrix} \Rightarrow \sigma_1 = \sqrt{3}

⎝ ⎛ 0 1 1 1 1 0 ⎠ ⎞ ( 2

1 2

1 ) = σ 1 ⎝ ⎜ ⎛ 6

1 6

2 6

1 ⎠ ⎟ ⎞ ⇒ σ 1 = 3

(

0

1

1

1

1

0

)

(

−

1

2

1

2

)

=

σ

2

(

1

2

0

−

1

2

)

⇒

σ

2

=

1

\begin{pmatrix} 0 & 1\\ 1 & 1\\ 1 & 0 \end{pmatrix} \begin{pmatrix} -\frac{1}{\sqrt{2}} \\ \frac{1}{\sqrt{2}} \\ \end{pmatrix} = \sigma_2 \begin{pmatrix} \frac{1}{\sqrt{2}} \\ 0 \\ -\frac{1}{\sqrt{2}} \\ \end{pmatrix} \Rightarrow \sigma_2 = 1

⎝ ⎛ 0 1 1 1 1 0 ⎠ ⎞ ( − 2

1 2

1 ) = σ 2 ⎝ ⎛ 2

1 0 − 2

1 ⎠ ⎞ ⇒ σ 2 = 1

当然,我们也可以利用

σ

i

=

λ

i

\sigma_i = \sqrt{\lambda_i}

σ i = λ i

3

\sqrt{3}

3

A

=

U

Σ

V

T

=

(

1

6

1

2

1

3

2

6

0

−

1

3

1

6

−

1

2

1

3

)

(

3

0

0

1

0

0

)

(

1

2

1

2

−

1

2

1

2

)

A = U \Sigma V^T = \begin{pmatrix} \frac{1}{\sqrt{6}} & \frac{1}{\sqrt{2}} & \frac{1}{\sqrt{3}}\\ \frac{2}{\sqrt{6}} & 0 & -\frac{1}{\sqrt{3}}\\ \frac{1}{\sqrt{6}} & -\frac{1}{\sqrt{2}} & \frac{1}{\sqrt{3}}\\ \end{pmatrix} \begin{pmatrix} \sqrt{3} & 0 \\ 0 & 1 \\ 0 & 0 \\ \end{pmatrix} \begin{pmatrix} \frac{1}{\sqrt{2}} & \frac{1}{\sqrt{2}} \\ -\frac{1}{\sqrt{2}} & \frac{1}{\sqrt{2}} \\ \end{pmatrix}

A = U Σ V T = ⎝ ⎜ ⎛ 6

1 6

2 6

1 2

1 0 − 2

1 3

1 − 3

1 3

1 ⎠ ⎟ ⎞ ⎝ ⎛ 3

0 0 0 1 0 ⎠ ⎞ ( 2

1 − 2

1 2

1 2

1 )

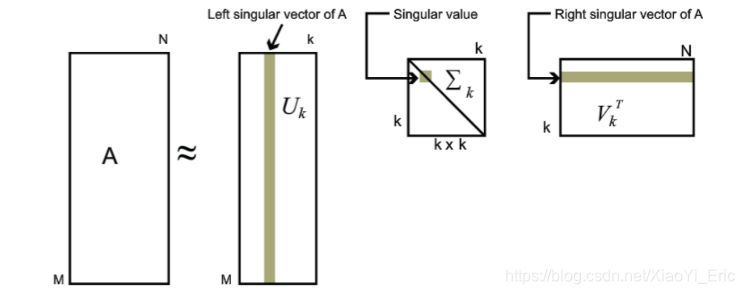

对于SVD有哪些重要的性质值得我们注意呢? 对于奇异值,它跟特征分解中的特征值类似,在奇异值矩阵中也是按照从大到小排列,而且奇异值的减少特别的快,在很多情况下,前10%甚至1%的奇异值的和就占了全部奇异值之和的99%以上的比例。也就是说,我们可以用最大的k个奇异值和对应的左右奇异向量来近似描述矩阵,即

A

m

∗

n

=

U

m

∗

m

Σ

m

∗

n

V

n

∗

n

T

≈

U

m

∗

k

Σ

k

∗

k

V

k

∗

n

T

A_{m*n} = U_{m*m} \Sigma_{m*n}V^T_{n * n } \approx U_{m*k}\Sigma_{k*k}V^T_{k*n}

A m ∗ n = U m ∗ m Σ m ∗ n V n ∗ n T ≈ U m ∗ k Σ k ∗ k V k ∗ n T

U

m

∗

k

,

Σ

k

∗

k

,

V

k

∗

n

T

U_{m*k},\Sigma_{k*k},V^T_{k*n}

U m ∗ k , Σ k ∗ k , V k ∗ n T

在机器学习降维之主成分分析(PCA) 之中,我们讲到PCA降维时,需要找到样本协方差矩阵

X

T

X

X^TX

X T X

X

T

X

X^TX

X T X

注意到SVD也可以求出协方差矩阵

X

T

X

X^TX

X T X

X

T

X

X^TX

X T X

V

V

V https://arxiv.org/abs/0909.4061 。也就是说,PCA算法可以不用做特征分解,而是用SVD来进行完成。

另一方面,PCA仅仅使用了SVD的右奇异矩阵,没有使用左奇异矩阵,那么左奇异矩阵有什么用呢?假如我们的样本是m×n的矩阵X,如果通过SVD找到矩阵

X

X

T

XX^T

X X T

X

d

∗

n

′

=

U

d

∗

m

T

X

m

∗

n

X'_{d*n} = U_{d*m}^TX_{m*n}

X d ∗ n ′ = U d ∗ m T X m ∗ n

SVD作为一个很基本的算法,在很多机器学习算法中都有它的身影,特别是在现在的大数据时代,由于SVD可以实现并行化,因此更是大展身手。当然,SVD的缺点是分解出的矩阵解释性往往不强,不过这不影响它的使用。

更多内容请关注公众号谓之小一 ,若有疑问可在公众号后台提问,随时回答,欢迎关注,

刘建平Pinard-奇异值分解(SVD)原理转载降维中的应用