如有缪误欢迎指正

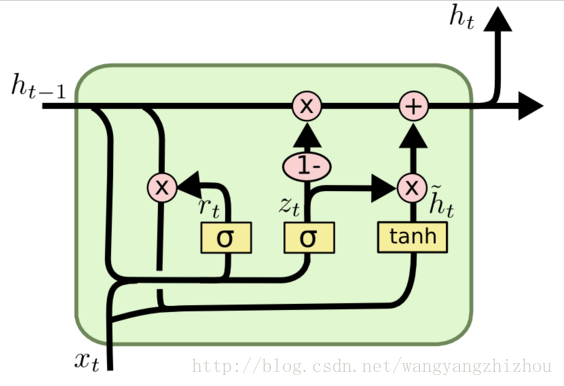

GRU结构向前传播 心得(欢迎指正)

当遗忘门等于0的时候当前信息抛弃 之前记忆前传

当遗忘门等于1 的时候之前记忆抛弃 当前信息前传

当遗忘门的值为0和1之间的时候 调控前传的记忆与信息的比例

QAQ

Q:LSTM与GRU 的区别

A: LSTM 数据量大的时候选用

A: GRU 结构相对简单,但是训练速度会快一些

通常商业应用多选用LSTM

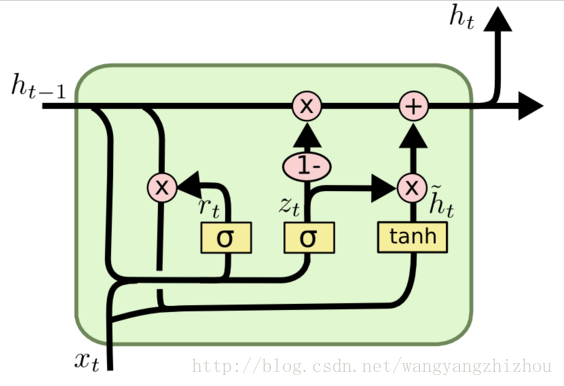

如有缪误欢迎指正

当遗忘门等于0的时候当前信息抛弃 之前记忆前传

当遗忘门等于1 的时候之前记忆抛弃 当前信息前传

当遗忘门的值为0和1之间的时候 调控前传的记忆与信息的比例

QAQ

Q:LSTM与GRU 的区别

A: LSTM 数据量大的时候选用

A: GRU 结构相对简单,但是训练速度会快一些

通常商业应用多选用LSTM