版权声明:原创文章,版权所有。转载请注明出处。 https://blog.csdn.net/qq_38672855/article/details/82953447

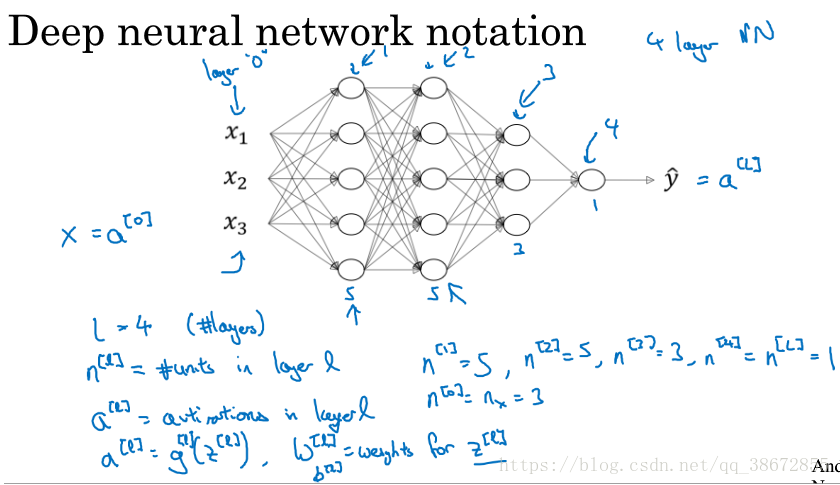

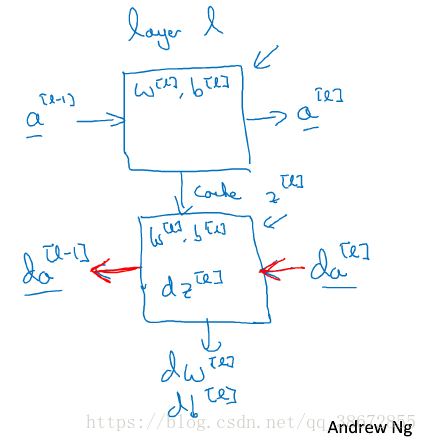

1. 通常情况下,我们使用L表示神经网络的层数,n表示神经网络的各个网络层的神经元个数,使用a=g(z)表示各个层所用的激活函数,同理,z中的参数使用w和b表示。具体写法如图:

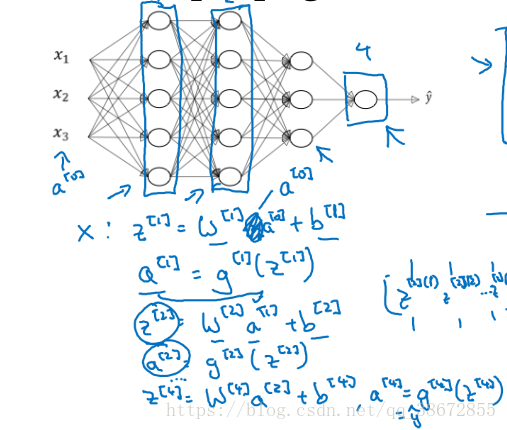

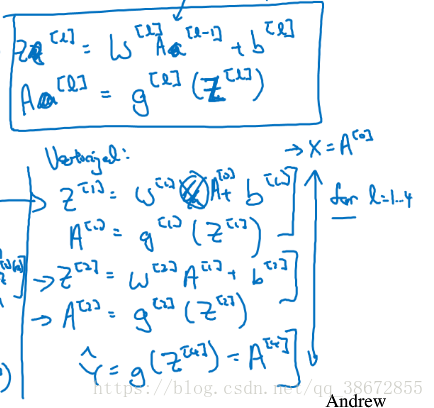

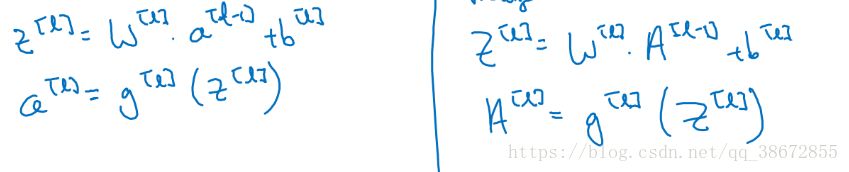

2. 前向反馈的表示方法

所有样本的前向反馈的表示方法

3. 我们在编码深度神经网络时候需要注意各个向量的维数的正确性,以减少代码的bug。理解矩阵的乘法对此非常有帮助。

4. 为什么深度神经网络比浅层神经网络更好?

解释一

深度神经网络可以实现这样一种模式:前几层的神经网络层获取声音或图像的较低层次的信息,后面的神经网络层可以获取较高层次的信息。

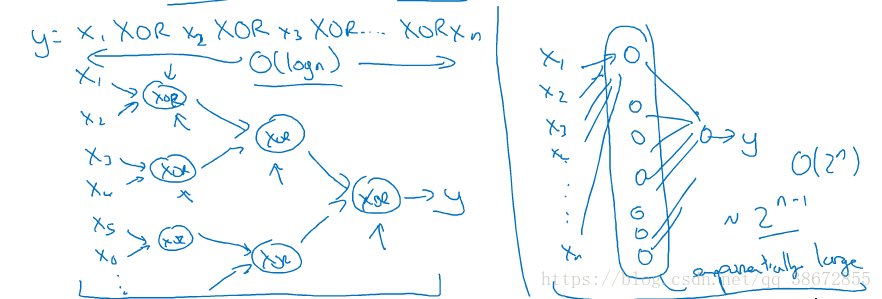

解释二

如图是一种用n个数进行异或来举的直观的说明:

5. 深度神经网络块

宏观上看这些神经网络块:

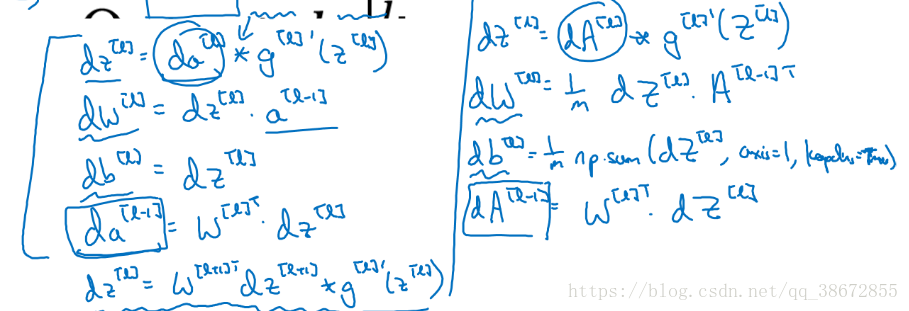

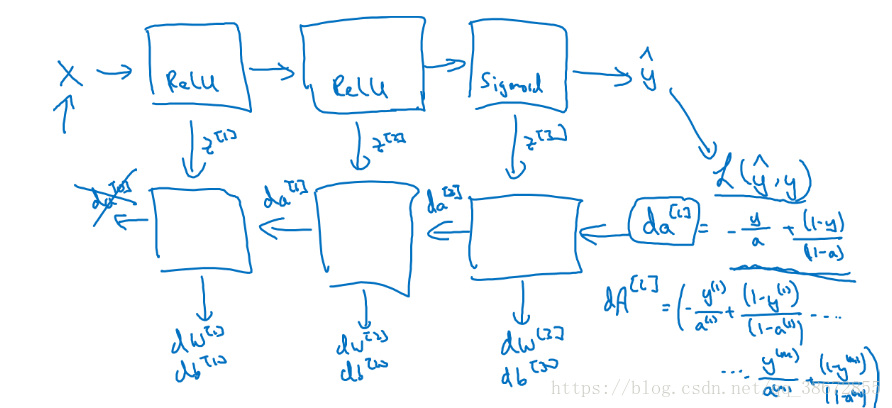

6. 建立前向传播与反向传播

<前向传播>

<反向传播>

<宏观>

7. 参数与超参数

参数:w b

超参数:α(学习率)num(梯度下降法循环次数)L(隐藏层数目)n[1]、...(隐藏单元数目)等等。它们最终控制了最后参数w和b的值,所以被称为超参数。

8. 调参

9. 采访…