AdaBoost 算法的训练误差分析

AdaBoost最基本的性质是它能在学习过程中不断减少训练误差,即在训练数据集上的分类误差率。

定理:AdaBoost的训练误差界:

N1i=1∑NI(G(xi)̸=yi)≤N1i∑exp(−yif(xi))=∏Zm

证明:当

G(xi)̸=yi时,

yif(xi)<0,因而

exp(−yif(xi))≥1,由此直接推导出前半部分。

后半部分的推导要利用

Zm的定义式及其变形:

wmiexp(−αmyiGm(xi))=Zmwm+1,i

推导过程如下:

这一定理说明,可以再每一轮选取适当的

Gm使得

Zm最小,从而使得训练误差下降最快。

(

Gm的选择时在权重向量Dm确定的情况下,使样本误分类率最低)

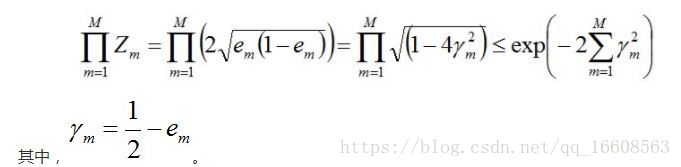

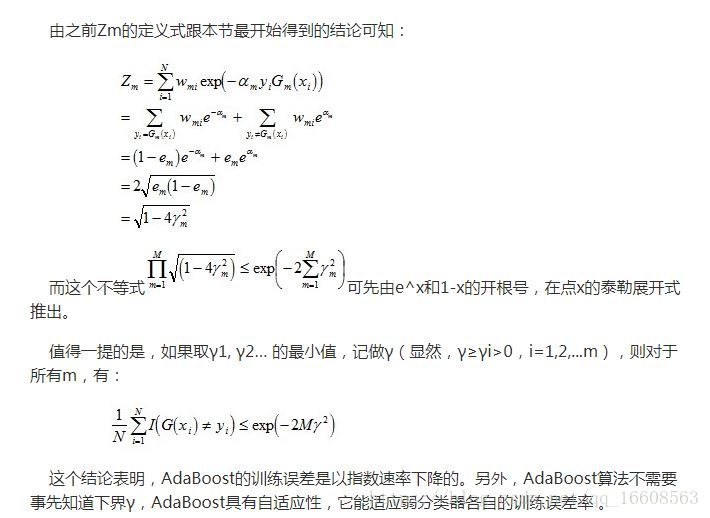

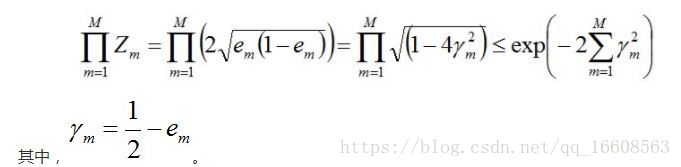

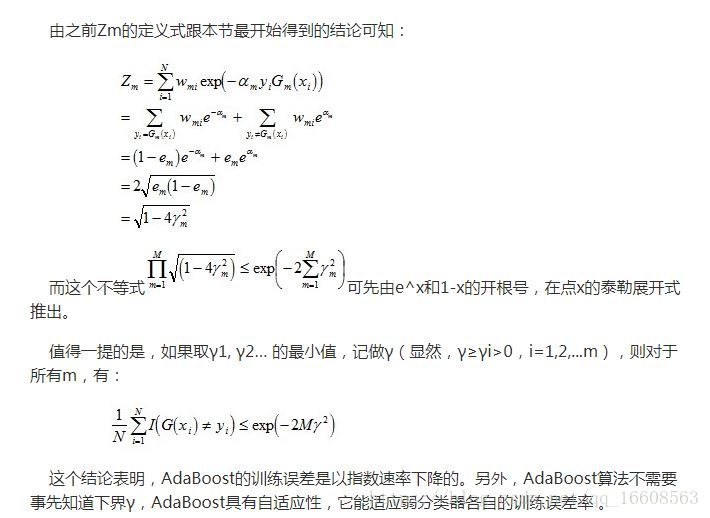

定理2:二分类问题AdaBoost的训练误差界: