正则化惩罚项:

原先的回归算法算出的$\Theta _{1}...\Theta _{10}$

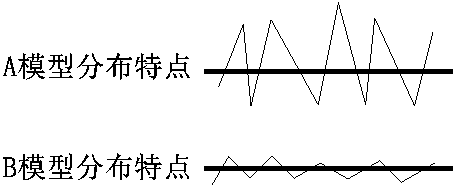

如果有2个模型A,B

A有$\Theta _{1}...\Theta _{10}$

B也有$\Theta _{1}...\Theta _{10}$

如果两个recall值都是90%,但是分布不同

模型的参数浮动的范围越小,过拟合的程度也就越小,过拟合的意思就是在训练集表现的很好,在测试集表现很差,

过拟合是一种非常常见的现象,我们总是希望得到B模型

如何得到B模型?

引入正则化惩罚项,大力度惩罚A的θ,小力度惩罚B的θ

L2正则化:

我们的损失函数(LOSS)应该是越低越好

$L_{2}=LOSS+\frac{1}{2}W^{2}$

W表示θ的浮动程度

L1正则化:

$L_{1}=LOSS+\frac{1}{2}\left | W \right |$

在$L_{1},L_{2}$前加入λ或者C

$\lambda L_{1},\lambda L_{2}$

表示惩罚力度,0.1、1、10、100

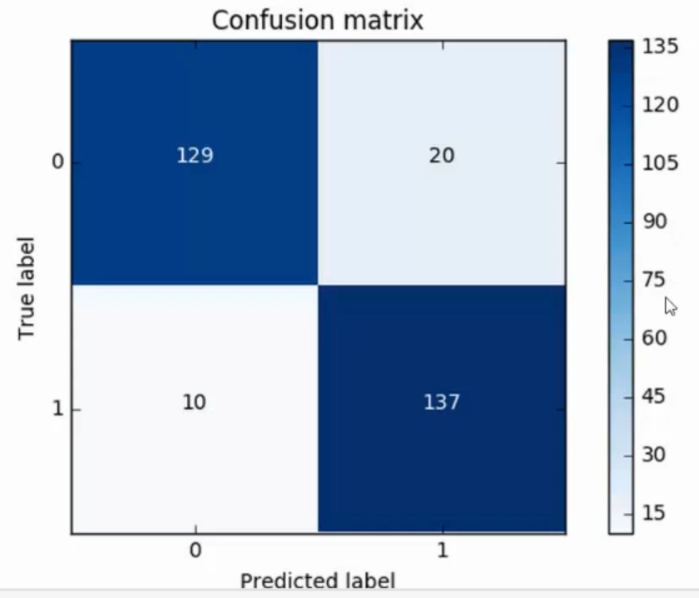

混淆矩阵:

X轴表示预测值

Y轴表示真实值

此矩阵对应于之前的recall值的分析图

TP = 137

FN = 10

则recall = 137/147 = 0.932

那么在原始数据集上的混淆矩阵是