集成学习是将多个基分类器进行组合,提高分类的准确率,组合的策略有投票法、平均法、加权法、学习法(尚没有看懂),基分类器要做到“好而不同”,每个基分类器学习不同的特征,要有多样性。

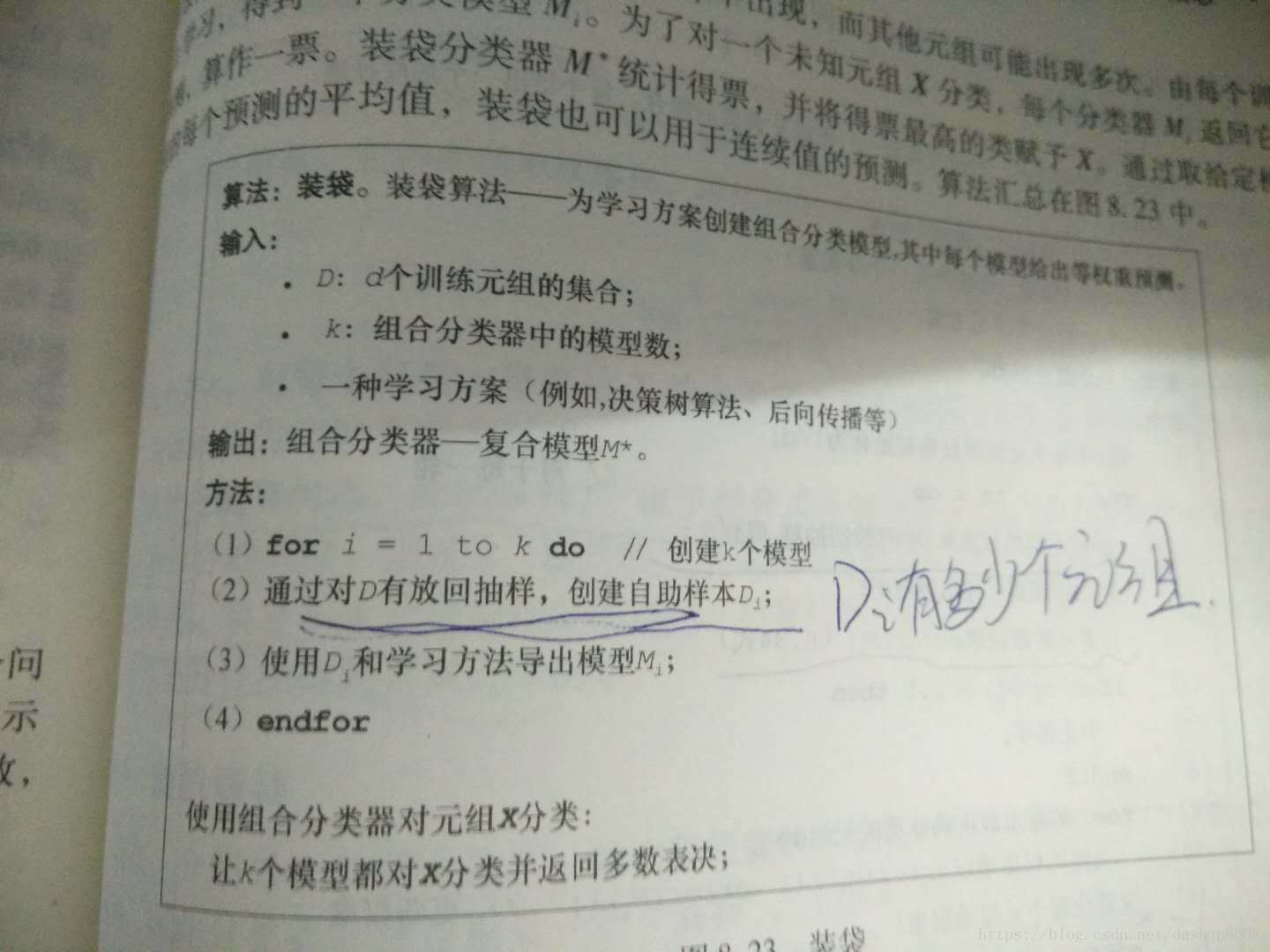

采用自助采样法。

给定包含m个样本的数据集,随机的从 样本中抽取一个样本放入采样集中,再把该样本放回初始数据集,使得次采样的时候仍然有可能被选中,经过m次的采集得到含有m个样本的数据集,初始训练集中约有63%的样本出现在采样集中。得T个含有m个样本的采样集,然后基于每个采样集训练一个基学习器,再将这些基学习器进行结合。bagging对分类任务进行简单的投票法、简单平均法。

自主采样过程使得位被选中的样本可以作为验证集。

随机森林的基学习器是决策树

在决策树的构建过程中加入了随机属性的选择,假如数据集的属性是d,传统的决策树是在当前的属性中选择一个较优的属性,在RF中,对基决策树的每个结点,先从该结点的属性结合中选取包含K个属性的子集,然后在从这个属性结合中选择一个最优属性进行划分,若K=1,则是随机的选择一个属性进行划分,若k=d,则是传统的决策树的构建。

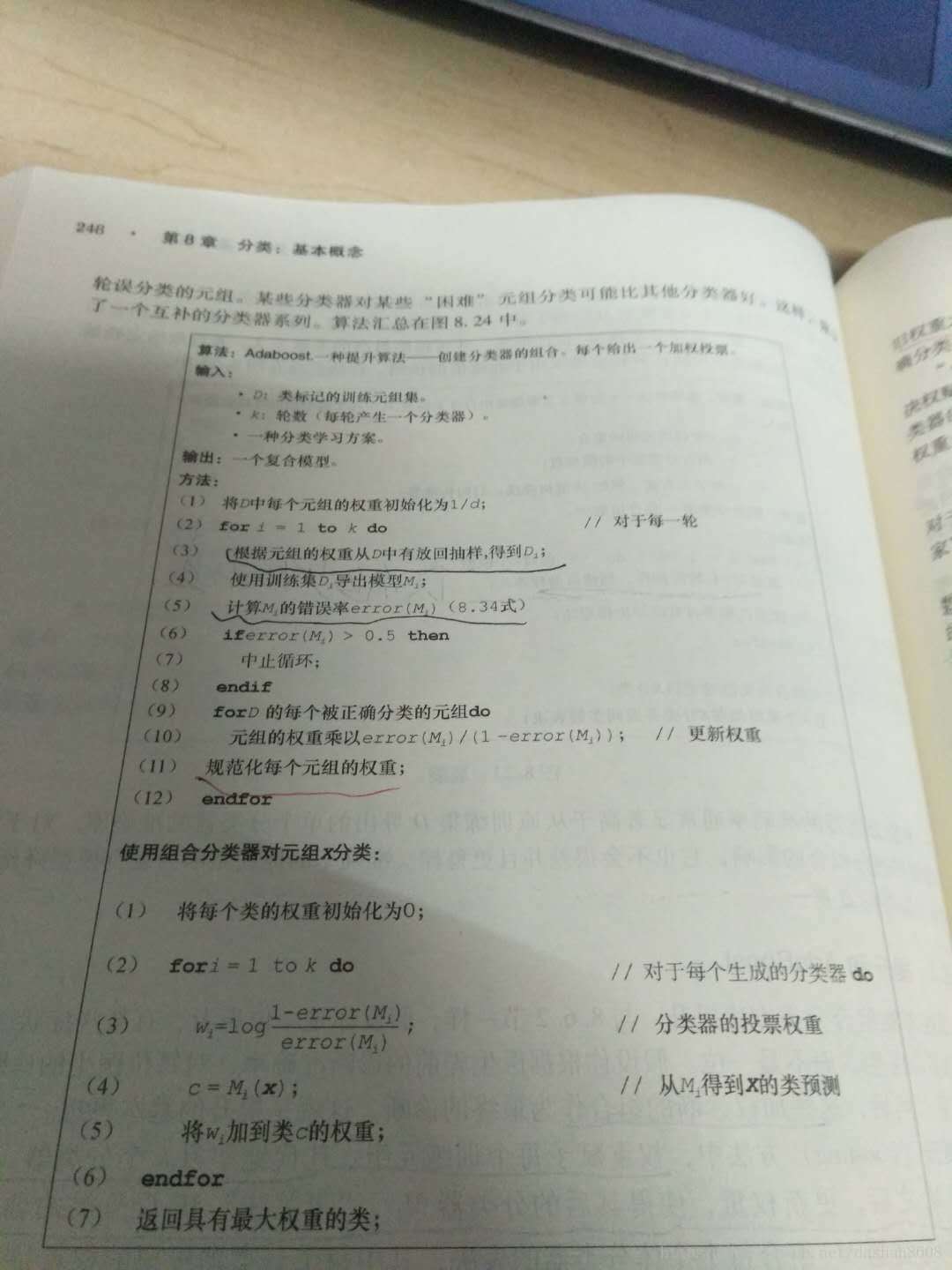

基学习器之间存在强依赖关系的boosting

boosting先从训练集训练一个基分类器,然后再根据基分类器的表现对训练集的分布进行调整,使得先前做错的分类样本能够在后续收到更多的关注。然后基于调整后的数据再训练分类器。