(本文仅供自己参考,防止遗忘,想要了解更多得小伙伴请移步别的大神博客)

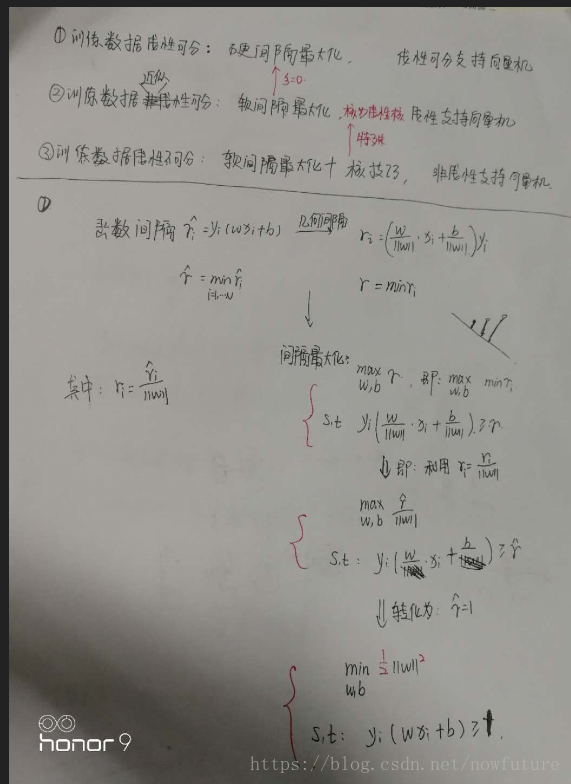

首先从SVM得分类谈起:

分为三类,第一个约束条件最强,最后一个约束最宽泛,如下:

此时即可求出w,b。

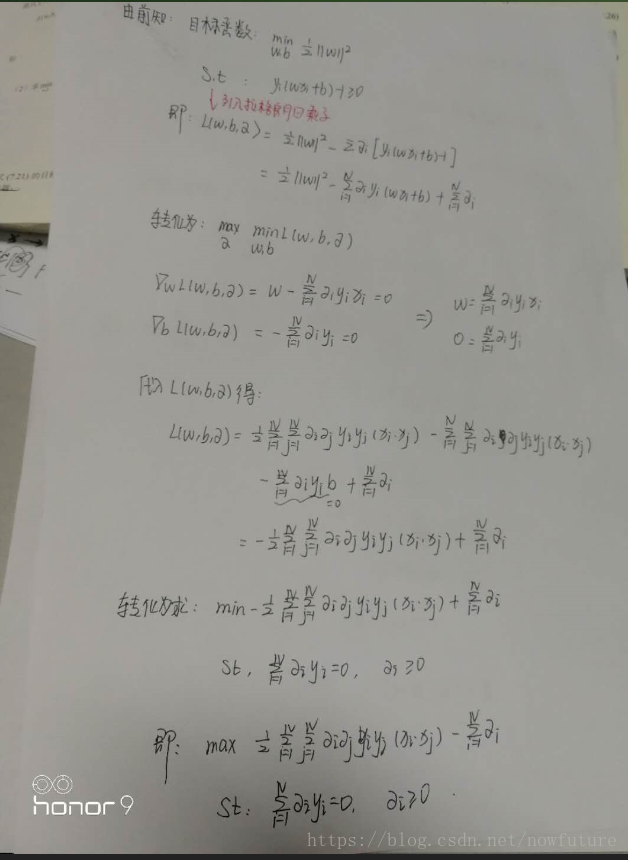

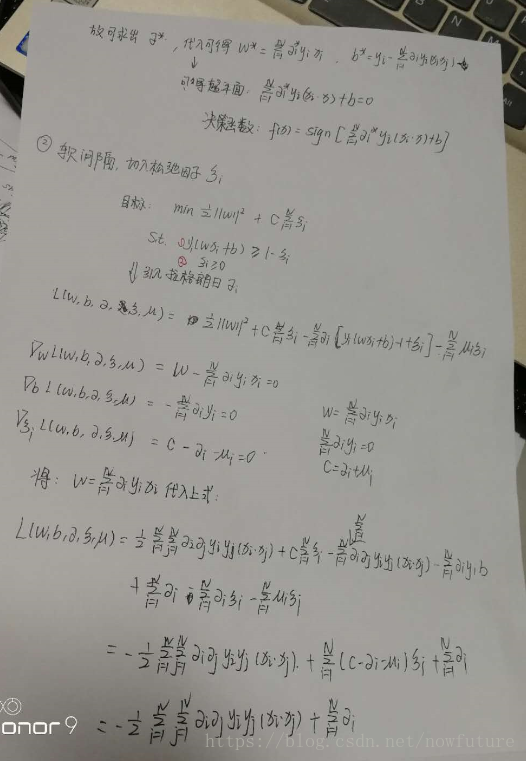

然后:一是因为原始问题转换为对偶问题更容易求解,二是为了自然的引入核函数,进而推广到非线性分类问题

引入了拉格朗日乘子,构建拉格朗日函数。

这样一来,就转换为求alpha的最大的问题,然后就不用求w,b,只需要求出来alpha,再由alpha求出w,b。

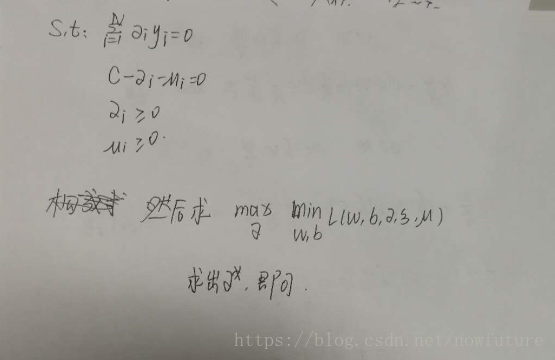

接着谈软间隔的最大化问题,只需要引入一个松弛变量,如下

其推导思想和硬间隔最大化相似,求出alpha,然后由alpha求出w,b即可。