机器学习中正则化项L1和L2的直观理解

<div class="article-info-box">

<div class="article-bar-top d-flex">

<span class="time">2016年09月04日 18:49:27</span>

<div class="float-right">

<span class="read-count">阅读数:80027</span>

</div>

</div>

</div>

<article>

<div id="article_content" class="article_content clearfix csdn-tracking-statistics" data-pid="blog" data-mod="popu_307" data-dsm="post">

<div class="markdown_views">

<h1 id="正则化regularization"><a name="t0"></a>正则化(Regularization)</h1>

机器学习中几乎都可以看到损失函数后面会添加一个额外项,常用的额外项一般有两种,一般英文称作ℓ1” role=”presentation”>ℓ1ℓ1-norm,中文称作L1正则化和L2正则化,或者L1范数和L2范数。

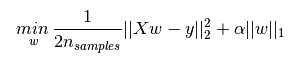

L1正则化和L2正则化可以看做是损失函数的惩罚项。所谓『惩罚』是指对损失函数中的某些参数做一些限制。对于线性回归模型,使用L1正则化的模型建叫做Lasso回归,使用L2正则化的模型叫做Ridge回归(岭回归)。下图是Python中Lasso回归的损失函数,式中加号后面一项α||w||1” role=”presentation”>α||w||1α||w||1即为L1正则化项。

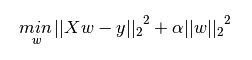

下图是Python中Ridge回归的损失函数,式中加号后面一项α||w||22” role=”presentation”>α||w||22α||w||22即为L2正则化项。

一般回归分析中回归w” role=”presentation”>ww表示特征的系数,从上式可以看到正则化项是对系数做了处理(限制)。L1正则化和L2正则化的说明如下:

- L1正则化是指权值向量w” role=”presentation”>ww

- L2正则化是指权值向量w” role=”presentation”>ww

一般都会在正则化项之前添加一个系数,Python中用α” role=”presentation”>αα表示。这个系数需要用户指定。

那添加L1和L2正则化有什么用?下面是L1正则化和L2正则化的作用,这些表述可以在很多文章中找到。

- L1正则化可以产生稀疏权值矩阵,即产生一个稀疏模型,可以用于特征选择

- L2正则化可以防止模型过拟合(overfitting);一定程度上,L1也可以防止过拟合

稀疏模型与特征选择

上面提到L1正则化有助于生成一个稀疏权值矩阵,进而可以用于特征选择。为什么要生成一个稀疏矩阵?

稀疏矩阵指的是很多元素为0,只有少数元素是非零值的矩阵,即得到的线性回归模型的大部分系数都是0. 通常机器学习中特征数量很多,例如文本处理时,如果将一个词组(term)作为一个特征,那么特征数量会达到上万个(bigram)。在预测或分类时,那么多特征显然难以选择,但是如果代入这些特征得到的模型是一个稀疏模型,表示只有少数特征对这个模型有贡献,绝大部分特征是没有贡献的,或者贡献微小(因为它们前面的系数是0或者是很小的值,即使去掉对模型也没有什么影响),此时我们就可以只关注系数是非零值的特征。这就是稀疏模型与特征选择的关系。

L1和L2正则化的直观理解

这部分内容将解释为什么L1正则化可以产生稀疏模型(L1是怎么让系数等于零的),以及为什么L2正则化可以防止过拟合。

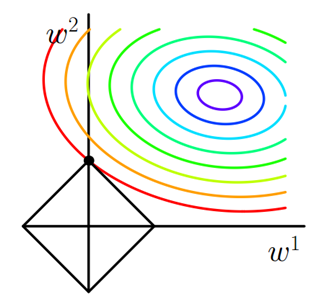

L1正则化和特征选择

假设有如下带L1正则化的损失函数:

其中 J0” role=”presentation”>J0J0的二维平面上画出来。如下图:

图1 L1正则化

图中等值线是J0” role=”presentation”>J0J0其它部位接触的机率,而在这些角上,会有很多权值等于0,这就是为什么L1正则化可以产生稀疏模型,进而可以用于特征选择。

而正则化前面的系数α” role=”presentation”>αα可以取到很小的值。

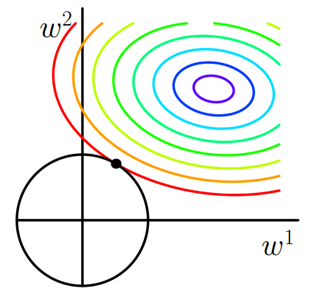

类似,假设有如下带L2正则化的损失函数:

同样可以画出他们在二维平面上的图形,如下:

图2 L2正则化

二维平面下L2正则化的函数图形是个圆,与方形相比,被磨去了棱角。因此J0” role=”presentation”>J0J0等于零的机率小了许多,这就是为什么L2正则化不具有稀疏性的原因。

L2正则化和过拟合

拟合过程中通常都倾向于让权值尽可能小,最后构造一个所有参数都比较小的模型。因为一般认为参数值小的模型比较简单,能适应不同的数据集,也在一定程度上避免了过拟合现象。可以设想一下对于一个线性回归方程,若参数很大,那么只要数据偏移一点点,就会对结果造成很大的影响;但如果参数足够小,数据偏移得多一点也不会对结果造成什么影响,专业一点的说法是『抗扰动能力强』。

那为什么L2正则化可以获得值很小的参数?

以线性回归中的梯度下降法为例。假设要求的参数为θ” role=”presentation”>θθ是我们的假设函数,那么线性回归的代价函数如下:

那么在梯度下降法中,最终用于迭代计算参数 θ” role=”presentation”>θθ的迭代式为:

其中 α” role=”presentation”>αα是learning rate. 上式是没有添加L2正则化项的迭代公式,如果在原始代价函数之后添加L2正则化,则迭代公式会变成下面的样子:

其中 λ” role=”presentation”>λλ是不断减小的。

最开始也提到L1正则化一定程度上也可以防止过拟合。之前做了解释,当L1的正则化系数很小时,得到的最优解会很小,可以达到和L2正则化类似的效果。

正则化参数的选择

L1正则化参数

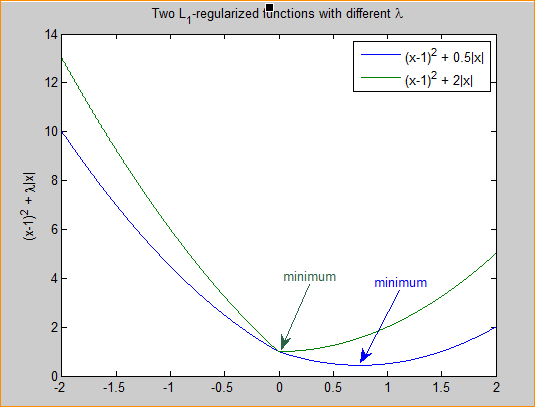

通常越大的λ” role=”presentation”>λλ可以让代价函数在参数为0时取到最小值。下面是一个简单的例子,这个例子来自Quora上的问答。为了方便叙述,一些符号跟这篇帖子的符号保持一致。

假设有如下带L1正则化项的代价函数:

其中 x” role=”presentation”>xx时取到最小值。如下图:

图3 L1正则化参数的选择

分别取λ=0.5” role=”presentation”>λ=0.5λ=0.5时取到最小值。

L2正则化参数

从公式5可以看到,λ” role=”presentation”>λλ越大,L2圆的半径越小,最后求得代价函数最值时各参数也会变得很小。

Reference

过拟合的解释:

https://hit-scir.gitbooks.io/neural-networks-and-deep-learning-zh_cn/content/chap3/c3s5ss2.html

正则化的解释:

https://hit-scir.gitbooks.io/neural-networks-and-deep-learning-zh_cn/content/chap3/c3s5ss1.html

正则化的解释:

http://blog.csdn.net/u012162613/article/details/44261657

正则化的数学解释(一些图来源于这里):

http://blog.csdn.net/zouxy09/article/details/24971995

<div class="article-bar-bottom">

<div class="article-copyright">

版权声明:本作品采用知识共享 署名-非商业性使用 3.0 中国大陆 许可协议进行许可。 https://blog.csdn.net/jinping_shi/article/details/52433975 </div>

<div class="tags-box artic-tag-box">

<span class="label">文章标签:</span>

<a data-track-click="{"mod":"popu_626","con":"机器学习"}" data-track-view="{"mod":"popu_626","con":"机器学习"}" class="tag-link" href="http://so.csdn.net/so/search/s.do?q=机器学习&t=blog" target="_blank">机器学习 </a><a data-track-click="{"mod":"popu_626","con":"正则化"}" data-track-view="{"mod":"popu_626","con":"正则化"}" class="tag-link" href="http://so.csdn.net/so/search/s.do?q=正则化&t=blog" target="_blank">正则化 </a><a data-track-click="{"mod":"popu_626","con":"过拟合"}" data-track-view="{"mod":"popu_626","con":"过拟合"}" class="tag-link" href="http://so.csdn.net/so/search/s.do?q=过拟合&t=blog" target="_blank">过拟合 </a><a data-track-click="{"mod":"popu_626","con":"稀疏矩阵"}" data-track-view="{"mod":"popu_626","con":"稀疏矩阵"}" class="tag-link" href="http://so.csdn.net/so/search/s.do?q=稀疏矩阵&t=blog" target="_blank">稀疏矩阵 </a>

</div>

<div class="tags-box hot-word">

<span class="label">相关热词:</span>

<a class="tag-link" href="https://blog.csdn.net/fjssharpsword/article/details/72674841" target="_blank">

θ机器学习 </a>

<a class="tag-link" href="https://blog.csdn.net/dukai392/article/details/70271574" target="_blank">

机器学习和 </a>

<a class="tag-link" href="https://blog.csdn.net/by4_Luminous/article/details/53341334" target="_blank">

机器学习的 </a>

<a class="tag-link" href="https://blog.csdn.net/u014365862/article/details/78955063" target="_blank">

机器学习- </a>

<a class="tag-link" href="https://blog.csdn.net/lcy7289786/article/details/68958324" target="_blank">

《机器学习 </a>

</div>

</div>

<!-- !empty($pre_next_article[0]) -->

<div class="related-article related-article-prev text-truncate">

<a href="https://blog.csdn.net/jinping_shi/article/details/52433867">

<span>上一篇</span>Python多进程库multiprocessing中进程池Pool类的使用 </a>

</div>

<div class="related-article related-article-next text-truncate">

<a href="https://blog.csdn.net/jinping_shi/article/details/53444100">

<span>下一篇</span>贝叶斯参数估计的理解 </a>

</div>

</div>