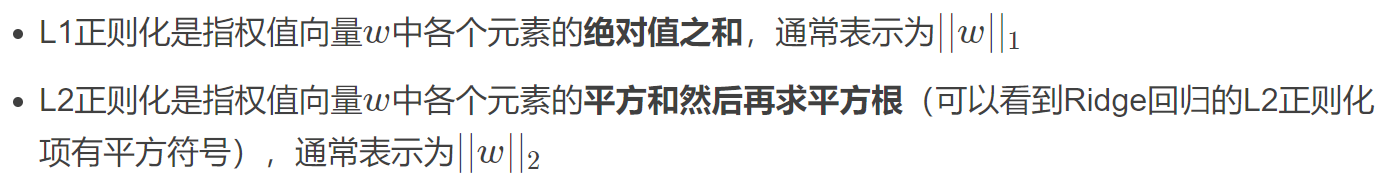

总结起来:

L1正则可以使得矩阵更加稀疏,便于特征的选择。(更多的参数为0)-----看图可以知道,最优的点都在角–坐标轴熵,参数为0.

L2正则可以防止过拟合,看图知道是圆形的,与稀疏无关。可以使得模型参数更小,避免了 模型参数有较小的改变的情况下会引发较大的改变。

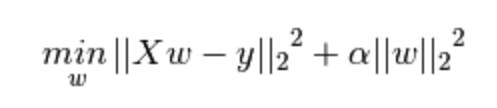

定义

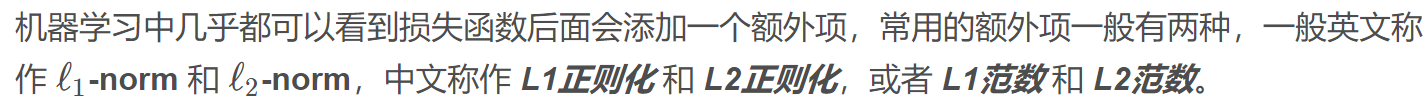

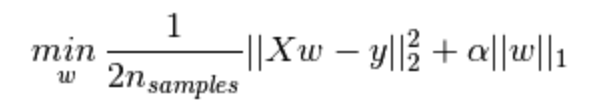

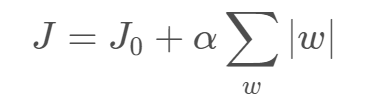

L1正则化和L2正则化可以看做是损失函数的惩罚项。所谓『惩罚』是指对损失函数中的某些参数做一些限制。对于线性回归模型,使用L1正则化的模型建叫做Lasso回归,使用L2正则化的模型叫做Ridge回归(岭回归)

作用

L1正则化可以产生 稀疏权值 矩阵,即产生一个稀疏模型,可以用于特征选择

L2正则化可以防止模型过拟合(overfitting);一定程度上,L1也可以防止过拟合

上面提到L1正则化有助于生成一个稀疏权值矩阵,进而可以用于特征选择。为什么要生成一个稀疏矩阵?

稀疏矩阵指的是很多元素为0,只有少数元素是非零值的矩阵,即得到的线性回归模型的大部分系数都是0. 通常机器学习中特征数量很多,例如文本处理时,如果将一个词组(term)作为一个特征,那么特征数量会达到上万个(bigram)。在预测或分类时,那么多特征显然难以选择,但是如果代入这些特征得到的模型是一个稀疏模型,表示只有少数特征对这个模型有贡献,绝大部分特征是没有贡献的,或者贡献微小(因为它们前面的系数是0或者是很小的值,即使去掉对模型也没有什么影响),此时我们就可以只关注系数是非零值的特征。这就是稀疏模型与特征选择的关系。

解释稀疏解产生的原因:

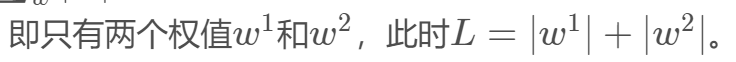

机器学习的任务就是要通过一些方法(比如梯度下降)求出损失函数的最小值。当我们在原始损失函数J0 后添加L1正则化项时,相当于对J0做了一个约束。我们的任务变成在L约束下求出J0 取最小值的解。考虑二维的情况 求解J 0 的过程可以画出等值线,同时L1正则化的函数L LL也可以在w1、w2 的二维平面上画出来。如下图:

求解J 0 的过程可以画出等值线,同时L1正则化的函数L LL也可以在w1、w2 的二维平面上画出来。如下图:

记住!首次相交的地方就是最优解,我们可以看到 L1正则有很多角,与这些角相交的几率也很大,这些角也都是在坐标轴上,所以权值为0的几率大得多。故产生稀疏矩阵。

对于L2正则来说,不是 产生了稀疏解,而是防止了过拟合。首先由图可以看到是没有角的,平方和,所以 没有L1的条件可以产生稀疏解。

为什么可以防止过拟合?

拟合过程中通常都倾向于让权值尽可能小,最后构造一个所有参数都比较小的模型。因为一般认为参数值小的模型比较简单,能适应不同的数据集,也在一定程度上避免了过拟合现象。可以设想一下对于一个线性回归方程,若参数很大,那么只要数据偏移一点点,就会对结果造成很大的影响;但如果参数足够小,数据偏移得多一点也不会对结果造成什么影响,专业一点的说法是『抗扰动能力强』。

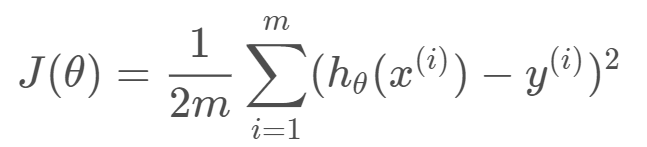

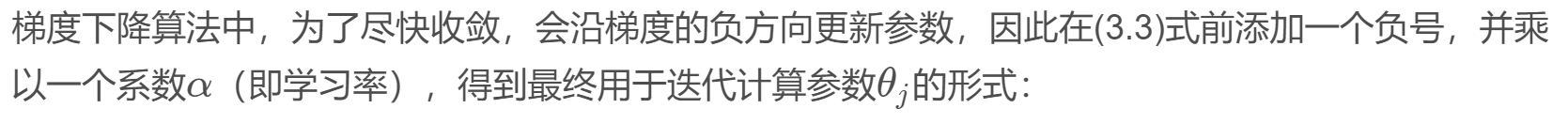

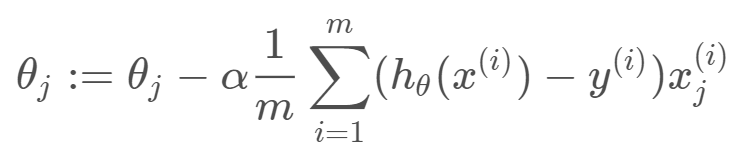

在梯度下降算法中,需要先对参数求导,得到梯度。梯度本身是上升最快的方向,为了让损失尽可能小,沿梯度的负方向更新参数即可。

L2正则化参数

从公式5可以看到

衰减得越快。另一个理解可以参考图2,λ \lambdaλ越大,L2圆的半径越小,最后求得代价函数最值时各参数也会变得很小,同样是一个shrink to zero的过程,原理与L1正则化类似。