安装hive

解压hive到指定的目录中,一般解压在/usr/local/hive

tar -zxvf hive-xxx.tar.gz- 1

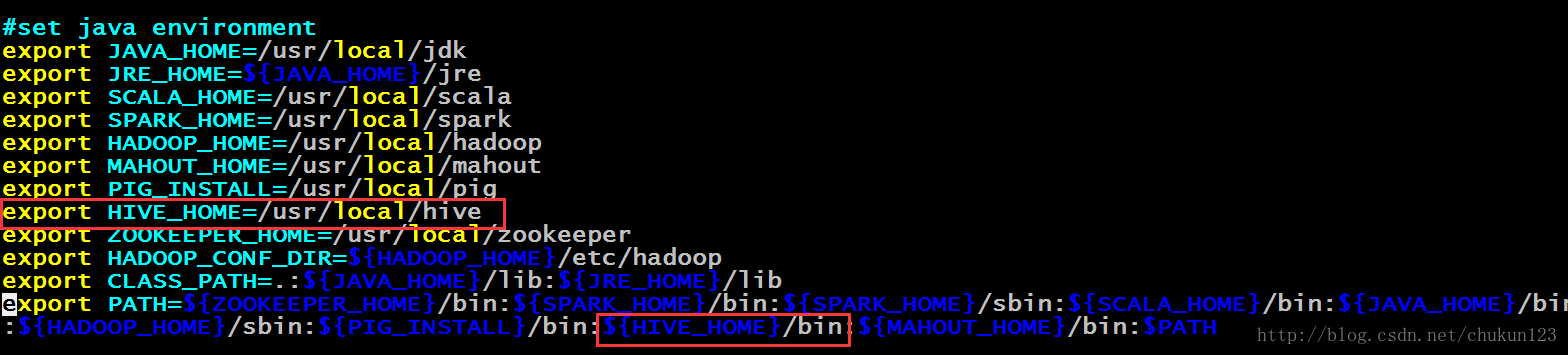

配置系统环境

配置hive-env.sh的环境

配置hadoop的家目录,配置hive的家目录,已及配置hive配置文件的目录

配置hive-site.xml

<property>

<name>hive.metastore.local</name>

<value>true</value>

<description/>

</property>

<!--配置mysql-->

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://192.168.1.3:3306/hive</value>

<description/>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

<description/>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

<description/>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>mysql</value>

<description/>

</property>注意,我用的是windows下的mysql,还有,将mysql的驱动jar包放在hive的lib下

启动hive,启动之前必须初始化数据库:我初始化的是mysql数据库

./schemaTool --initSchema --dbType mysql- 1

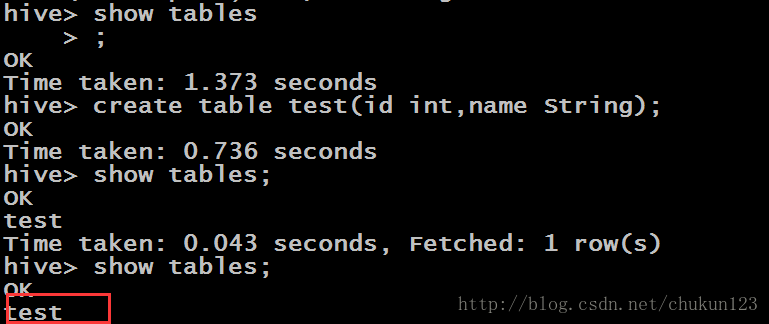

启动hive

./hive- 1

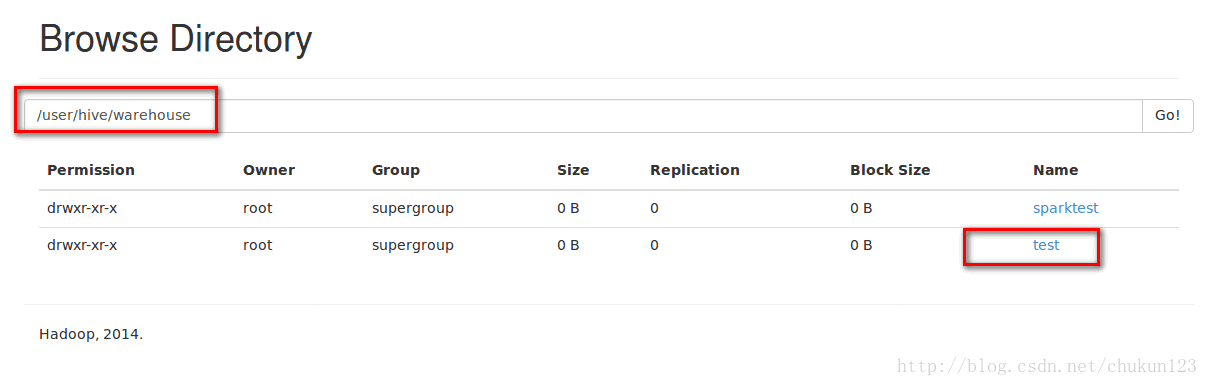

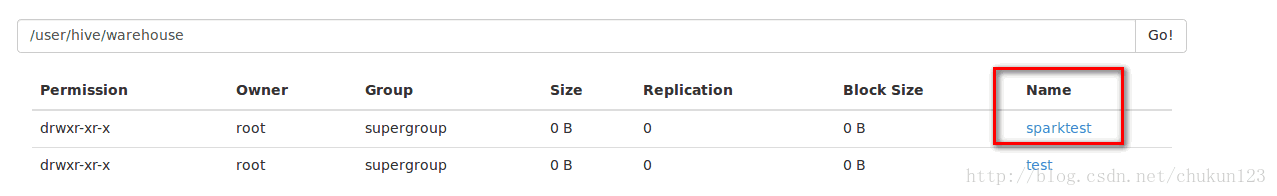

HDFS上面也有建好的数据表

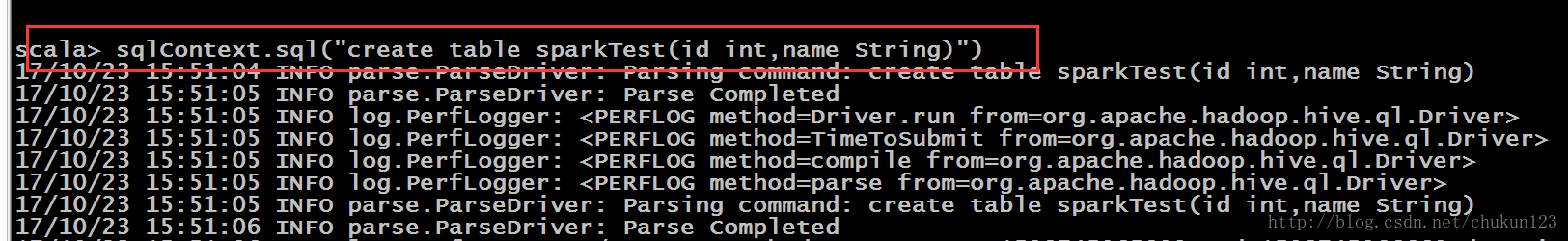

启动spark,启动之前将mysql的驱动包,加入到spark的lib下

启动spark-shell

建表:

HDFS上面也有spark建好的数据表

注意:

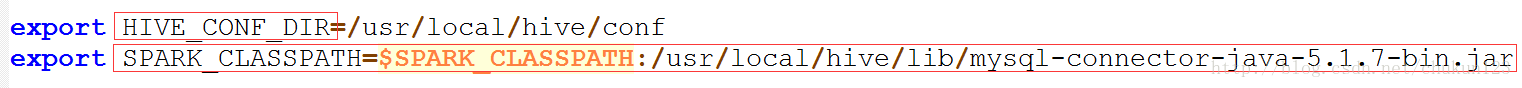

1.需要把配置好的hive-site.xml文件copy到spark的安装目录的conf下。

2.在spark的conf下的spark-env.sh中添加hive配置:

Spark整合hive完毕