1 线性可分模式的最优超平面

考虑训练样本

(xi,di)

假设由子集代表的模式是线性可分的,用于分离超平面的决策曲面方程是:

WTX+b=0(式4.1)

其中x是输入向量,w是可调向量,b是偏置。因此可以写成:

WTX+b≥0当di=+1

WTX+b<0当di=−1(式4.2)

支持向量机的目标是找到一个特殊的超平面,这个超平面分离边缘最大,在该情况下,决策曲面为最优超平面。假设

w0和b0

分别表示权值向量和偏置的最优值,相应的,最优超平面形式如下:

wT0+b0=0(式4.3)

将式4.1改写,可得到判别函数:

g(x)=wT0+b0(式4.4)

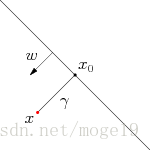

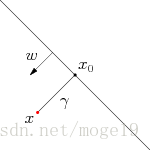

x到最优超平面的距离是一种代数度量,可以将x表达为,(理解此处需要回顾高中几何、向量相关的知识,如下图所示那样)

x=x0+r∗w0||w0||

其中

x0

是x在最优超平面上的正轴投影,r是期望的代数距离。如果x在最优平面的正面,r是正值,相反,则为负值,由定义可知

g(xp)=0

,由此可得出:

g(x)=wT0x+b0=r||w0||(式4.5)

将超平面表示为(w,b),w为法向量,b为位移向,则样本空间到超平面(w,b)的距离可写为

r=|wTx+b|||w||(式4.6)

该步的解法详见(

https://blog.csdn.net/alwaystry/article/details/60957096)

假设超平面(w,b)能将训练样本正确分类,即

(xi,yi)⊂D

若

yi=+1,则有wTxi+b>0,yi=−1,则有wTxi+b<0

,令

{wTxi+b≥+1,wTxi+b≤−1,yi=+1yi=−1(式4.7)

由式4.6和式4.5可得出:

r=g(x)||w0||={1||w0||,−1||w0||,yi=+1yi=−1(式4.8)

有式4.8可得到, 两个类边缘的最优值为

ρ

:

ρ=2r=2||w0||(式4.9)

由式4.9可以说明:

最大化两个类之间的边缘等价于最小权值向量w的欧几里得范数。

首先主要到训练样本{X,Y},再根据式4.7,把两个等式合并得到一个等式:

yi(wTxi+b)≥1

据此可总结,最大化两个类之间的分类边缘,即最大化间隔,仅需最大化

||w||−1

,等价于最小化

||w||2

(在《神经网络与机器学习》中,此处等价于

wTw

)

于是可以得到如下:

min12||w||2

yi(wTxi+b)≥1,i=(1,2,…ldots,N)

这就是支持向量的基本型。

在《神经网络与机器学习》中采用的记录方式为:

Φ(w)=12wTw

yi(wTxi+b)≥1,i=(1,2,…ldots,N)(式4.11)

代价函数

Φ(w)

是w的凸函数

约束条件关于w是线性的。

可以使用拉格朗日乘子方法解决约束最优问题。

首先,建立拉格朗日函数

J(w,b,a)=12wTw−∑i=1nai[di(yi(wTxi+b)−1)](式4.12)

ai

称作拉格朗日乘子,约束最优问题的解由

J(w,b,a)

的鞍点决定,

J(w,b,a)

对w和b求微分并设置为0,得到两个最优条件:

{条件1:∂L(w,b,a)∂w=0,条件2:∂L(w,b,a)∂b=0

应用最优条件1到式4.11的拉格朗日函数,得到:

w=∑i=1Naiyixi(式4.13)

同理运用最优条件2可得:

∑i=1Naiyi=0(式4.14)

KKT条件,(此处由式4.11,4.14得到)

⎧⎩⎨条件1:ai≥0条件2:yif(xi)−1≥0条件3:ai(yif(xi)−1)=0(式4.15)

对偶问题

像前面提到的,原问题是处理凸代价函数和线性约束的,给定这样一个约束最优化问题,可能构造另一个问题,成为对偶问题。第二问题与原问题有同样的最优值,但是这是由拉格朗日乘子提供最优解。

为了说明对偶问题是原问题的前提,首先逐项展开式4.12如下:

J(w,b,a)=12wTw−∑i=1NaiyiwTxi−b∑i=1Naiyi+∑i=1Nai(式4.16)

根据式4.14,式4.16的右端第三项为零。由式4.13有

wTw=∑i=1NaiyiwTxi=∑i=1N∑j=1NaiajyiyjxTixj

相应地,设置目标函数

J(w,b,a)=Q(a)

,可以将式4.16改写成:

Q(a)=∑i=1Nai−12∑i=1N∑j=1NaiajyiyjxTixj

现在可以将对偶问题做如下陈述:

给定训练样本

τ=(xi,di)

,寻找最大化如下目标函数的拉格朗日乘子

ai

:

Q(a)=∑i=1Nai−12∑i=1N∑j=1NaiajyiyjxTixj

满足约束条件:

∑i=1Naiyi=0

ai≥0,当i=1,2,3....,N时

可以用式4.13计算最优权值向量

w0

,并写成:

w0=∑i=1Na0,iyixi

运用式4.7,有:

b0=1−wT0x(s)=1−∑i=1Nao,idixTiX(s)

[1]: 神经网络与机器学习 [加] Simmon Haykin