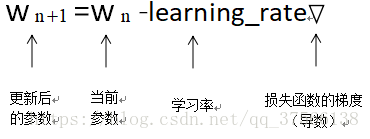

学习率learning_rate:每次参数更新的幅度

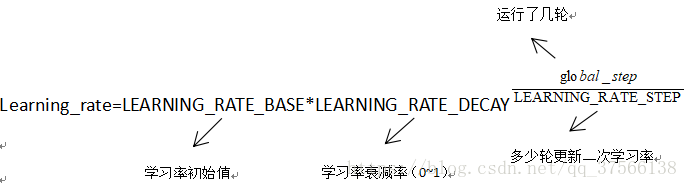

学习率设置多少合适

学习率大了震荡不收敛,学习率小了收敛速度慢。

可以通过指数衰减学习率解决

其中LEARNING_RATE_STEP一般由(总样本数/每次列入的数据个数)得到

在tensorflow中的代码:

global_step = tf.Variable(0,trainable=False)#记录当前共运行了多少轮,由于这个变量只用于计数,并非训练的参数,所以我们标注为不可训练

learning_rate = tf.train.exponential_decay(

LEARNING_RATE_BASE,

global_step,

LEARNING_RATE_STEP,

LEARNING_RATE_DECAY,

staircase=True)#当为True时,学习率阶梯型衰减,当为False时,学习率是一条平滑下降的曲线