智能先锋

从左至右,依次:

Yann LeCun、Geoffrey Hinton、Yoshua Bengio、Andrew Ng

Geoffrey Hinton:是人工智能领域的鼻祖,他发表了许多让神经网络得以应用的论文,激活了整个人工智能领域。他还培养了许多人工智能的大家。比如LeCun就是他的博士后。

Yann LeCun:他改进了卷积神经网路算法,使卷积神经网络具有了工程应用价值,现在卷积神经网络依旧是计算机视觉领域最有效的模型之一。

Yoshua Bengio:他推动了循环神经网路算法的发展,使循环神经网络得到工程应用,用循环神经网络解决了自然语言处理中的问题。

Andrew Ng:他是人工智能和机器学习领域国际上最权威的学者之一。吴恩达也是在线教育平台Coursera的联合创始人。

什么是机器学习

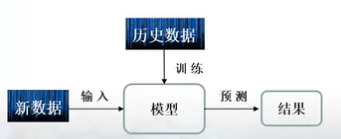

机器学习是一种统计学方法,计算机利用已有数据得出某种模型,再利用此模型预测结果。

机器学习三要素:数据、算法、算力 。

什么是深度学习

深层次神经网络,源于对生物脑神经元结构的研究。

生物学中的神经元:下图左侧有许多支流汇总在一起,生物学中称这些支流叫做树突。树突具有接受刺激并将冲动传入细胞体的功能,是神经元的输入。这些树突汇总于细胞核又沿着一条轴突输出。轴突的主要功能是将神经冲动由胞体传至其他神经元,是神经元的输出。人脑便是由860亿个这样的神经元组成,所有的思维意识,都以它为基本单元,连接成网络实现的。

计算机中的神经元模型:1943年,心理学家McCulloch和数学家Pitts参考了生物神经元的结构,发表了抽象的神经元模型MP。神经元模型是一个包含输入,输出与计算功能的模型。输入可以类比为神经元的树突,输出可以类比为神经元的轴突,计算可以类比为细胞核。

人工智能 Vs 机器学习 Vs 深度学习

人工智能,就是用机器模拟人的意识和思维。

机器学习,则是实现人工智能的一种方法,是人工智能的子集。

深度学习,就是深层次神经网络,是机器学习的一种实现方法,是机器学习的子集。

神经网络的发展历史(三起两落)

第一次兴起:1958年,人们把两层神经元首尾相接,组成单层神经网络,称做感知机。感知机成了首个可以学习的人工神经网络。引发了神经网络研究的第一次兴起。

第一次寒冬:1969年,这个领域的权威学者 Minsky 用数学公式证明了只有单层神经网络的感知机无法对异或逻辑进行分类,Minsky 还指出要想解决异或可分问题,需要把单层神经网络扩展到两层或者以上。然而在那个年代计算机的运算能力,是无法支撑这种运算量的。只有一层计算单元的感知机,暴露出他的天然缺陷,使得神经网络研究进入了第一个寒冬。

第二次兴起:1986年,Hinton等人提出了反向传播方法,有效解决了两层神经网络的算力问题。引发了神经网络研究的第二次兴起。

第二次寒冬:1995年,支持向量机诞生。支持向量机可以免去神经网络需要调节参数的不足,还避免了神经网络中局部最优的问题。一举击败神经网络,成为当时人工智能领域的主流算法,使得神经网络进入了他的第二个冬季。

第三次兴起:2006年,深层次神经网络出现,2012年,卷积神经网络在图像识别领域中的惊人表现,又引发了神经网络研究的再一次兴起。