2. NASNet系列

3. Inception系列

4. Xception(keras)

5. VGG

6.DPN

卷积神经网络中的Inception模块是在普通卷积和深度可分卷积操作(深度卷积后逐点卷积)之间的一种中间状态。基于此,深度可分卷积可以理解为最大数量tower的Inception模块。受Inception启发,该观察引发我们提出一种新的深度卷积神经网络结构,用深度可分卷积替代Inception模块。我们展现这种结构,昵称为Xception在ImageNet数据集上表现略优于Inception V3,而在包括3.5亿图片和17000类的更大规模图片分类数据集上优势明显。考虑到Xception结构和Inception V3有相同数量的参数,这种性能的提升是来自于更有效的使用模型参数而不是提高容量。

近年来,卷积神经网络成为了计算机视觉的主要算法,设计基于卷积神经网络的算法获得了很大关注。设计卷积神经网络的历史开始于LeNet风格的模型,该模型只是简单地将卷积提出特征和最大值池化以空间二次取样堆叠起来。2012年,AlexNet结构进一步优化了这种思想,池化操作间的卷积操作被重复多次,使网络在每个空间规模学到更多的特征。受每年的ILSVRC竞赛的推动,随后的风潮是加大这种风格网络的深度,如2013年Zeiler和Fergus,以及2014年的VGG结构。

这时,一种新的网络风格产生,Inception结构,由Szegedy等在2014年引入,被称为GoogLeNet(Inception V1),之后被优化为Inception V2, Inception V3以及最新的Inception-ResNet。Inception自身受早期的网络-网络结构启发。自从首次推出,Inception无论是对于ImageNet的数据集,还是Google内部的数据集,特别是JFT,都是表现最好的模型之一。Inception风格模型最重要的内容是Inception模块,该模块有不同版本存在。

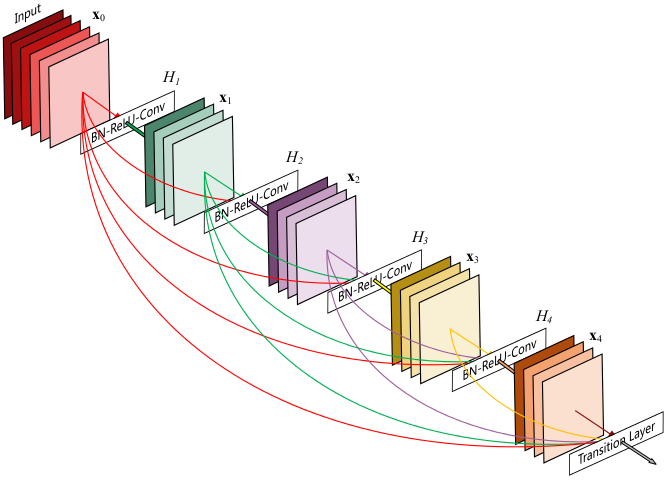

DenseNet模型

《Densely Connected Convolutional Networks》阅读笔记

深度详解ResNet及其六大变体

http://www.sohu.com/a/163256797_697750

解读谷歌NASNet:一个大规模图像识别架构!(附论文

http://www.xue63.com/zixunall/4874/48747280.html