第六章 深度学习

介绍卷积网络

使用全连接层的网络进行图像分类的时候,全连接层的网络架构不会考虑图像的空间结构。它平等对待相距很远和彼此接近的输入像素。图像的空间结构必须从训练数据中学习。而卷积神经网络是一种设法利用图像空间结构的网络。

卷积神经网络采用了三种基本概念:局部感受野,共享权重,池化。

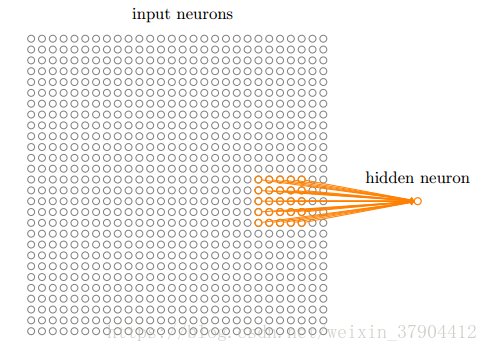

局部感受野:第一个隐藏层中的每个神经元会连接到一个输入神经元的一个小区域。如下图的

的区域,对应于25个输入像素,这个输入图像的区域称为隐藏神经元的局部感受野。它是输入像素上的一个小窗口。每个连接学习一个权重,整个窗口学习一个总的偏置。

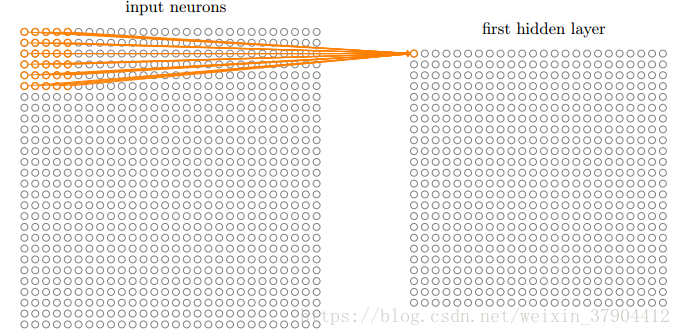

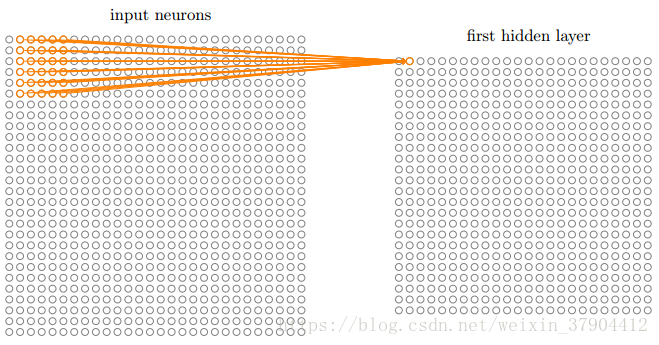

从左上角开始一个局部感受野:

然后往右一个像素移动局部感受野,连接到第二个隐藏神经元:

如此重复,构建起第一个隐藏层。如果有一个

的输入图像,

的局部感受野,那么隐藏层中就会有

个神经元。

共享权重和偏置:每个隐藏神经元具有一个偏置和连接到它的局部感受野的

权重。对于

隐藏神经元中的每一个神经元都使用相同的权重和偏置。这意味着第一个隐藏层的所有神经元检测完全相同的特征,只是在输入图像的不同位置。把权重和偏置想象成隐层神经元可以挑选的东西。

把从输入层到隐藏层的映射称为一个特征映射。定义特征映射的权重称为共享权重。定义特征映射的偏置称为共享偏置。共享权重和偏置称为一个卷积核或者滤波器。

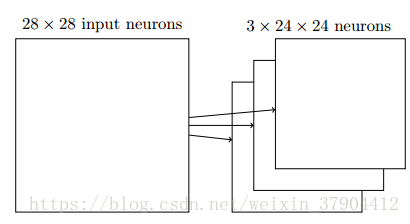

为了完成图像识别,需要很多特征映射。所以一个完整的卷积层由几个不同的特征映射组成,下图有3个特征映射,每个特征映射定义为一个

共享权重和单个共享偏置的集合。其结果是网络能够检测3种不同的特征:

池化层:池化层通常紧接着在卷积层之后使用。它要做的是简化从卷积层输出的信息。详细地说,一个池化层取得从卷积层输出的每一个特征映射,并且将它们压缩。常见的方法有最大池化。我们可以把最大池化看做一种网络询问:是否有一个给定的特征在一个图像区域中的哪个地方被发现的方式。然后他扔掉确切的位置信息。直观上来说,一旦一个特征被发现,它的确切位置不如它相对于其他特征的大概位置重要。这样可以扔掉很多参数。