一、说明

在人工智能和机器学习的迷人世界中,长短期记忆 (LSTM) 网络作为一项突破性创新脱颖而出。LSTM 旨在解决传统循环神经网络 (RNN) 的局限性,尤其是在学习长期依赖性方面的局限性,彻底改变了我们在各个领域建模和预测序列的能力。本文深入探讨了 LSTM 网络的核心机制、其独特功能以及改变行业的应用。

在时间和记忆领域,LSTM 网络就像警惕的守护者,弥合了现在转瞬即逝的低语和过去深刻的回声之间的差距。

二、序列的挑战

在了解 LSTM 之前,了解为什么建模序列(如时间序列数据或语言)具有挑战性至关重要。包括 RNN 在内的传统神经网络都在与“长期依赖性”作斗争。从本质上讲,他们发现很难记住和连接序列中相距太远的信息。想象一下,试图理解一本小说的情节,但只记住你读过的最后几页——这就是 RNN 在处理长序列时面临的问题。

2.1 LSTM 的出现

长短期记忆网络是由 Sepp Hochreiter 和 Jürgen Schmidhuber 在 1997 年开发的。他们的创新是设计一个能够学习存储哪些信息、存储多长时间以及丢弃哪些信息的神经网络。这种能力对于处理相关信息跨越较大时间间隔的序列至关重要。

2.2 LSTM 的核心组件

LSTM 引入了几个关键组件:

- 记忆单元:LSTM 单元的核心是记忆单元,它可以长期保留信息。它类似于人类记忆的数字形式。

- 门:这些是 LSTM 网络的调节器,由遗忘门、输入门和输出门组成。门是决定允许多少信息通过的神经网络。

- 遗忘门:确定要擦除存储单元的哪些部分。

- 输入门:用当前输入的新信息更新存储单元。

- 输出门:根据当前输入和单元的内存决定输出什么。

2.3 LSTM 工作流程

序列处理过程中 LSTM 单元内的过程可以描述如下:

- 忘记不相关的数据:忘记门评估新的输入和之前的隐藏状态,决定哪些信息不再相关并且应该被丢弃。

- 存储重要信息:输入门识别有价值的新信息并相应地更新单元状态。

- 计算输出:输出门使用更新的细胞状态来计算将作为该时间步的隐藏状态输出的细胞状态部分。

2.4 LSTM网络的应用

LSTM 已得到广泛应用,证明了它们的多功能性和有效性:

- 自然语言处理 (NLP):从生成文本到翻译语言以及为会话代理提供支持,LSTM 在理解和生成人类语言方面发挥着关键作用。

- 时间序列预测:在金融、天气预报和能源需求预测中,LSTM 可以对复杂的时间模式进行建模以进行准确的预测。

- 音乐和艺术生成:LSTM 可以在创意领域生成序列,通过学习现有作品中的模式来制作音乐甚至艺术品。

- 医疗保健:它们通过分析连续的患者数据来预测疾病进展,用于预测诊断。

三、代码

使用长短期记忆 (LSTM) 网络创建完整的 Python 示例涉及几个步骤:生成合成数据集、构建 LSTM 模型、在数据集上训练模型,最后绘制结果。为此,我们将使用numpy、tensorflow、 和 等库。matplotlib

首先,确保您已安装所需的库:

pip install numpy tensorflow matplotlib这是完整的代码:

import numpy as np

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import LSTM, Dense

import matplotlib.pyplot as plt

# Parameters

n_steps = 50

n_features = 1

# 1. Generate Synthetic Dataset

def generate_sine_wave_data(steps, length=1000):

x = np.linspace(0, length * np.pi, length)

y = np.sin(x)

sequences = []

labels = []

for i in range(length - steps):

sequences.append(y[i:i+steps])

labels.append(y[i+steps])

return np.array(sequences), np.array(labels)

X, y = generate_sine_wave_data(n_steps)

X = X.reshape((X.shape[0], X.shape[1], n_features))

# 2. Build LSTM Model

model = Sequential()

model.add(LSTM(50, activation='relu', input_shape=(n_steps, n_features)))

model.add(Dense(1))

model.compile(optimizer='adam', loss='mse')

# 3. Train the Model

model.fit(X, y, epochs=20, verbose=1)

# Predictions for plotting

x_input = np.array(y[-n_steps:])

x_input = x_input.reshape((1, n_steps, n_features))

yhat = model.predict(x_input, verbose=1)

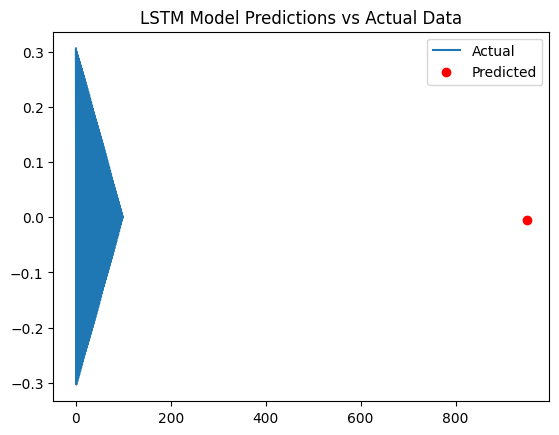

# 4. Plot the Results

plt.plot(y[-100:], label='Actual') # Plot the last 100 actual values

next_time_step = len(y) # Next time step after the last actual value

plt.scatter(next_time_step, yhat[0], color='red', label='Predicted') # Plot the predicted value

plt.title("LSTM Model Predictions vs Actual Data")

plt.legend()

plt.show()解释

- 合成数据生成:我们生成正弦波作为我们的数据集。

- LSTM 模型构建:一个简单的 LSTM 模型,具有一个 LSTM 层和一个 Dense 层。

- 训练:模型根据合成数据进行训练。

- 绘制结果:我们绘制数据集的最后一部分以及模型对下一个时间步的预测。

请注意,此代码是一个基本示例。现实世界的应用程序需要更复杂的数据处理、模型调整和验证技术。此外,运行此代码需要安装了必要库的 Python 环境。

四、结论

长短期记忆网络的发展是我们迈向更智能、更强大的人工智能系统之旅的一个重要里程碑。通过模仿人类记忆的选择性保留和回忆,LSTM 提供了一种强大的工具,可以以深度和暂时的方式理解我们周围的世界。随着我们不断完善和构建这些网络,潜在的应用程序与它们旨在建模的序列一样广泛。在人工智能领域,LSTM 不仅仅与记忆有关,而且与记忆有关。它们以一种以前无法实现的方式理解世界的连续性和背景。

md-com@evertongomede