链接:https://arxiv.org/pdf/2001.05658.pdf

目录

Case Study 1: Account Handle Sharing

Case Study 2: Image Coordination

Case Study 3: Hashtag Sequences

Case Study 5: Synchronized Actions

摘要:

协调一致的活动被用来影响和操纵社交媒体平台及其用户,这是对在线信息自由交换的严峻挑战。

无监督,基于网络的方法

在这里,我们介绍一种通用的、无监督的基于网络的方法来发现可能协调的帐户组。所提出的方法基于帐户之间共享的任意行为轨迹构建协调网络。

检测协调的推特账户

我们提供了五个影响力活动的案例研究,其中四个是在美国选举、香港抗议、叙利亚内战和加密货币操纵等不同背景下进行的。在每种情况下,我们都会通过检查 Twitter 帐户的身份、图像、主题标签序列、转发或时间模式来检测协调的 Twitter 帐户网络。事实证明,所提出的方法广泛适用于发现跨信息战场景的不同类型的协调。

引言

背景现状

在线社交媒体彻底改变了人们获取新闻和信息以及形成观点的方式。通过实现不受地理障碍阻碍的交流,并降低信息生产和消费的成本,社交媒体极大地扩大了公民和政治话语的参与。

尽管这可能会加强民主进程,但越来越多的证据表明,恶意行为者通过虚假信息和操纵活动污染了信息生态系统(Lazer 等人,2018 年;Vosoughi、Roy 和 Aral,2018 年;Bessi 和 Ferrara,2016 年;Shao 等人,2018 年; Ferrara 2017;Stella、Ferrara 和 De Domenico 2018;Deb 等人 2019;Bovet 和 Makse 2019;Grinberg 等人 2019)。

虽然影响力活动、错误信息和宣传一直存在(Jowett 和 O’Donnell 2018),但社交媒体创造了新的漏洞和滥用机会。正如志同道合的用户可以轻松地联系起来支持合法事业一样,具有边缘、阴谋或极端主义信仰的团体也可以达到临界规模,并不受专家或温和观点的影响。平台 API 和商品化的虚假账户使得开发软件来冒充用户并隐藏控制这些社交机器人的人的身份变得很简单——无论他们是传播垃圾邮件的欺诈者、放大误导性叙述的政治人物,还是发动在线战争的民族国家(Ferrara 等)等人,2016)。认知和社会偏见使我们更容易受到社交机器人的操纵:有限的注意力促进了未经检查的主张的传播,确认偏见使我们无视事实,群体思维和回声室扭曲了对规范的看法,而跟风效应使我们关注机器人放大的模因(Weng et al. 2012;Hills 2019;Ciampaglia et al. 2018;Lazer et al. 2018;Pennycook et al. 2019)。

尽管社交媒体平台使用机器学习算法和人类事实检查员来检测错误信息和不真实账户等对策取得了进步,但恶意行为者仍在继续有效地欺骗公众,放大错误信息并推动两极分化(Barrett 2019)。我们观察到一场军备竞赛,其中攻击的复杂性不断演变以逃避检测。

大多数打击网络滥用的机器学习工具都以检测社交机器人为目标,并且主要使用针对个人账户的方法(Davis et al. 2016;Varol et al. 2017;Yang et al. 2019;2020;Sayyadiharikandeh et al. 2020) )。然而,恶意团体可能会采用在个人层面上看似无害的协调策略,并且只有在观察帐户之间的交互网络时才能检测到其可疑行为。例如,一个帐户更改其句柄可能是正常的,但一组帐户轮流更改名称不太可能是巧合。

稀疏相似性矩阵

在这里,我们提出了一种方法来揭示多个参与者之间的协调行为,无论其自动化/有机性质或恶意/良性意图如何。这个想法是从社交媒体数据中提取特征来构建协调网络,如果两个帐户表现出意想不到的相似行为,则它们具有很强的联系。这些相似性可以源于任何元数据,例如内容实体和配置文件特征。网络为稀疏相似性矩阵提供了有效的表示,以及检测重要的协调帐户集群的自然方法。我们的主要贡献是:

我们提出了一种检测协调的通用方法,原则上可以应用于任何有数据可用的社交媒体平台。由于该方法是完全无监督的,因此不需要标记的训练数据。

使用 Twitter 数据,我们通过实例化检测不同类型协调的方法来展示五个案例研究,这些方法基于 (i) 处理更改、(ii) 图像共享、(iii) 主题标签的顺序使用、(iv) 共同转发和 ( v) 同步。

案例研究说明了我们方法的普遍性和有效性:我们能够根据身份呈现、图片显示、文本书写、转发或采取这些行动的时间来检测协调的活动。

我们表明,协调行为并不一定意味着自动化。在案例研究中,我们检测到可能有机器人和人类帐户在恶意活动中协同工作。

• 代码和数据可在github.com/IUNetSci/coordination-detection 上获取,以重现当前结果并将我们的方法应用于其他案例。

Methods

所提出的检测在社交媒体上协调行动的帐户的方法如图 1 所示。它可以分为四个阶段:

(图 1:协调检测方法。在左侧,我们看到可以从社交媒体配置文件和消息中提取的行为痕迹。文中描述的四个步骤可识别可疑帐户群。)

行为痕迹提取:

协调检测的起点 应该是对可疑行为的猜想。假设真实的用户在某种程度上彼此独立,我们认为令人惊讶的缺乏独立性作为协调的证据。该方法的实施是通过选择捕获此类可疑行为的跟踪来指导的。例如,如果我们推测帐户由某个实体控制,其目的是扩大虚假信息源的曝光,我们可以提取共享 URL 作为痕迹。协调场景可能与几大类可疑痕迹相关:

a) 内容:如果协调是基于共享的内容,则可疑痕迹可能包括单词、ngram、主题标签、媒体、链接、用户提及等。

(b) 活动:协调可以通过活动的时空模式来揭示。可以揭示可疑行为的痕迹示例包括时间戳、地点和地理坐标。

(c) 身份:账户可以根据角色或群体进行协调。身份描述符的痕迹可用于检测这些类型的协调:名称、句柄、描述、个人资料图片、主页、帐户创建日期等。

(d) 组合:协调的检测可能需要多个维度的组合。例如,人们可以将这两种跟踪结合起来,形成一种临时内容检测方法,而不是像基于内容或基于活动的可疑跟踪那样仅跟踪使用了哪些主题标签或帐户何时处于活动状态。组合版本的限制性更强,因此可以减少误报的数量。

一旦识别出兴趣痕迹,我们就可以根据类似的行为痕迹建立一个帐户网络。可以应用初步的数据清理,过滤缺乏支持的节点——活动性低或与所选跟踪的交互很少——因为没有足够的证据来建立它们的协调。例如,共享少量图像将无法可靠地计算基于图像的相似性。

2. 双向网络构建:

下一步是构建一个双向网络,连接帐户以及从其个人资料和消息中提取的特征。

在这个阶段,我们可以使用行为痕迹作为特征,或者设计从痕迹衍生的新特征。例如,内容分析可以产生基于情绪、立场和叙述框架的特征。

诸如一天中的小时和星期几之类的时间特征可以从时间戳元数据中推断出来。

可以通过聚合痕迹来设计特征,例如将位置合并为国家或将图像合并为颜色配置文件。可以通过考虑轨迹集或序列来设计更复杂的特征。

二分网络可以根据帐户和特征之间的关联强度进行加权——多次共享同一张图像比仅共享一次的信号更强。权重可以包含归一化(例如 IDF)以考虑流行特征;如果许多帐户提到同一名人并不可疑。

3. 投影到帐户网络上:

将二分网络投影到保留帐户节点的网络上,并根据特征的某些相似性度量在节点之间添加边。所得到的无向协调网络中的边的权重可以通过简单的共现、杰卡德系数、余弦相似性或更复杂的统计度量(例如互信息或χ 2 )来计算。在某些情况下,协调网络中的每条边都因构造而可疑。

在其他情况下,边缘可能会提供有关帐户之间协调的噪声信号,从而导致误报。

例如,如果这些模因非常受欢迎,则共享多个相同模因的帐户不一定是可疑的。在这些情况下,可能需要手动管理来过滤掉协调网络中的低权重边缘,以专注于最可疑的交互。实现此目的的一种方法是保留权重最高百分位的边缘。讨论部分介绍了一些案例研究中的边缘权重分布,说明了积极的过滤如何允许人们优先考虑精度而不是召回率,从而最大限度地减少误报。

4. 聚类分析:

最后一步是找到其行为可能在帐户网络上协调的帐户组。可用于此目的的网络社区检测算法包括连接组件、k-core、k-cliques、模块化最大化和标签传播等(Fortunato 2010)。在这里介绍的案例研究中,我们使用连接组件,因为我们只考虑可疑边缘(通过设计或过滤)。

总之,所提出的检测协调方法的四个阶段被转化为八个可操作的步骤:(i)对可疑行为提出猜想; (ii) 选择此类行为的痕迹,或 (iii) 必要时设计特征; (iv) 根据支持度对数据集进行预过滤;选择(v)二分网络的权重和(vi)相似性度量作为账户协调网络的权重; (vii) 过滤掉低权重边缘;最后,(viii)提取协调组。尽管所提出的方法是无监督的,因此不需要标记的训练数据,但我们建议手动检查可疑集群及其内容。此类分析将提供方法验证以及协调组是否恶意和/或自动化的证据。在以下部分中,我们提出了五个案例研究,其中我们实施了所提出的方法,通过共享身份、图像、主题标签序列、共同转发和活动模式来检测协调。

Case Study 1: Account Handle Sharing

在Twitter和其他一些社交媒体平台上,尽管每个用户帐户都有一个不可变的ID,但许多关系是基于帐户句柄(称为屏幕名)是可变的并且通常可重用。一个例外是,已暂停帐户的句柄在 Twitter 上不可重复使用。用户可能有正当理由更改句柄。然而,更改和重复使用句柄的可能性会使用户面临诸如用户名抢注1和冒充等滥用行为(Mariconti et al. 2017)。在最近的一个例子中,同一个 Twitter 帐户使用与不同角色相关的Twitter 句柄来传播美国总统弹劾案中乌克兰举报人的名字。2

有关如何利用句柄更改的具体示例,请考虑以下按时间顺序排列的事件: 1. 用户 1(名为 @super cat)关注发布猫科动物图片的用户 2(名为 @kittie)。

2. 用户3(名为@superdog)发布犬类照片。

3. 用户 1 的推文提到用户 2:“我爱@kittie”。 Twitter 上的提及会创建指向所提及帐户个人资料的链接。因此,在时间步骤 3,用户 1 的推文链接到用户 2 的个人资料页面。

4. 用户 2 将其句柄重命名为@tiger。

5. 用户 3 将其句柄重命名为 @kittie,重复使用用户 2 的句柄。

尽管无论名称如何更改,用户 1 的社交网络都不会改变(用户 1 仍然关注用户 2),但名称更改不会反映在以前的帖子中,因此单击步骤 3 中的链接的任何人都将被重定向到用户 3 的个人资料,而不是按照用户 1 的最初意图,将用户 2 抢注到用户 2。这种类型的用户抢注与多个账户配合,可用于推广实体、开展“跟进”活动、渗透社区,甚至促进两极分化(Mariconti 等人,2017 年) )。由于社交媒体帖子通常由搜索引擎索引,因此这些操作可用于将内容推广到社交媒体边界之外。

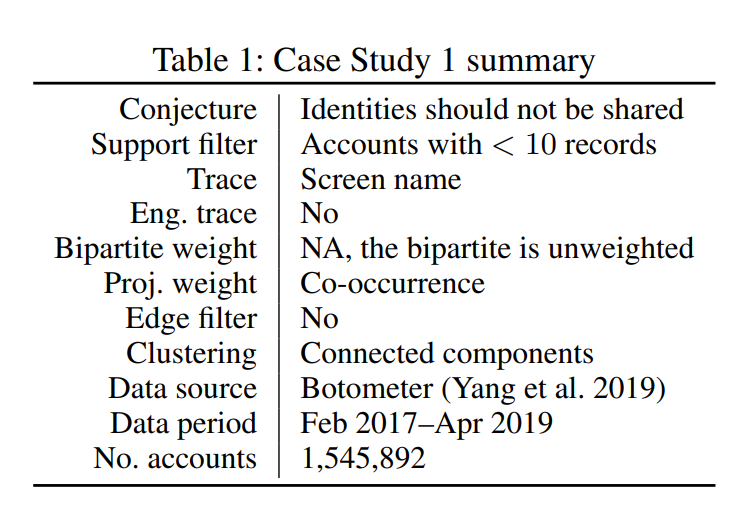

为了检测 Twitter 上的这种协调,我们应用了使用身份跟踪(即 Twitter 句柄)的方法。我们从对 Botometer.org 的请求日志开始,Botometer.org 是印第安纳大学社交媒体观测站的社交机器人检测服务(Yang 等人,2019 年)。每个日志记录都包含时间戳、Twitter 用户 ID 和句柄以及机器人分数。我们关注至少有十个条目(查询)的用户,以便可以观察到多个句柄更改。这产生了 5400 万条记录和 190 万个句柄。详细信息请参见表 1。

Coordination Detection

我们创建了一个由可疑用户名和帐户组成的双向网络。如果一个句柄被至少两个帐户共享,我们就认为该句柄是可疑的;如果该帐户至少使用了一个可疑句柄,那么我们就认为该帐户是可疑的。因此没有边缘被过滤。可以采取更具限制性的措施,例如,如果某个帐户获取了多个可疑句柄,则将该帐户视为可疑帐户。

为了检测可疑的集群,我们对网络进行投影,根据帐户共享句柄的次数来连接帐户。这相当于使用共现,即最简单的相似性度量。生成的网络中的每个连接组件都会标识一组协调帐户以及它们共享的句柄集。表 1 总结了方法决策。

分析

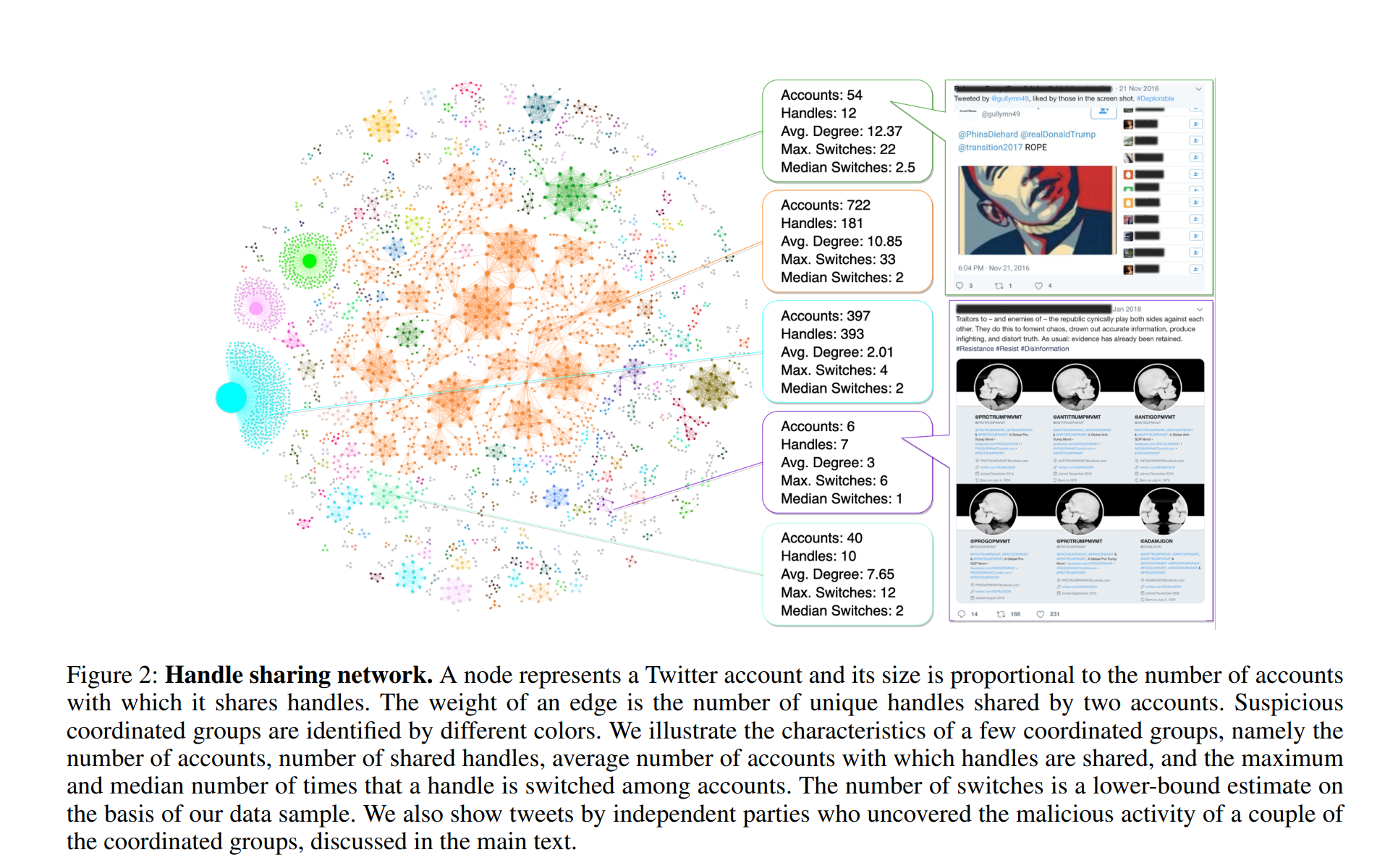

图2显示了句柄共享网络。它是一个加权、无向网络,拥有 7,879 个节点(Twitter 帐户)。我们可以将组件分为三类:

1. 星型组件捕获进行域名抢注和/或劫持的主要帐户(中心节点)。为了证实这一点,我们分析了涉及星状组件的句柄转换的时间序列。通常,句柄从帐户(大概是受害者)切换到集线器,然后(大概在支付某种形式的赎金之后)它从集线器切换回原始帐户。这些类型的相互转换在恒星中发生的频率是任何其他组件的 12 倍。

(图 2:句柄共享网络。一个节点代表一个 Twitter 账户,其大小与与其共享句柄的账户数量成正比。边的权重是两个账户共享的唯一句柄的数量。可疑的协调群组用不同颜色标识。我们举例说明几个协同组的特征,即账户数、共享句柄数、共享句柄的账户平均数以及句柄在账户间切换的最大次数和中位次数。切换次数是根据我们的数据样本估计的下限。我们还展示了揭露了几个协调小组恶意活动的独立人士发布的推文,这些推文将在正文中讨论)

2. 这个庞大的组件包括 722 个帐户,共享 181 个名称(图 2 中心的橙色组)。使用 Louvain 社区检测算法 (Blondel et al. 2008),我们进一步将巨型组件分为 13 个子组。我们怀疑它们代表了与同一组的不同协调活动相对应的时间集群。这项调查留待未来研究。

3. 其他组件可能代表需要进一步调查的不同情况,如下所述。图 2 展示了与两个协调句柄共享组相对应的恶意行为的几个故事,这些故事已被其他人发现。 2015 年 6 月,@GullyMN49 账号因发布攻击奥巴马总统的推文而被新闻报道。3 一年多后,同一账号仍在发布类似内容。 2017 年 3 月,我们观察到 23 个不同的账户在 5 天内获取了该账号。我们推测,这可能是为了让 2015 年创建的角色保持活力,并逃避 Twitter 在平台被滥用的报道后被暂停的行为。目前,@GullyMN49 账号已被禁止,但 23 个帐户中的 21 个仍然活跃。

图 2 中的第二个示例显示了共享七个句柄的六个帐户的集群。此后他们全部被停职。有趣的是,该集群正在共享似乎属于冲突政治团体的句柄,例如@ProTrumpMvmt 和@AntiTrumpMvmt。随着时间的推移,一些可疑账户不断改变立场。进一步调查显示,这些账户非常活跃;他们制造了政治筹款活动的假象,试图从双方那里获取资金。

Case Study 2: Image Coordination

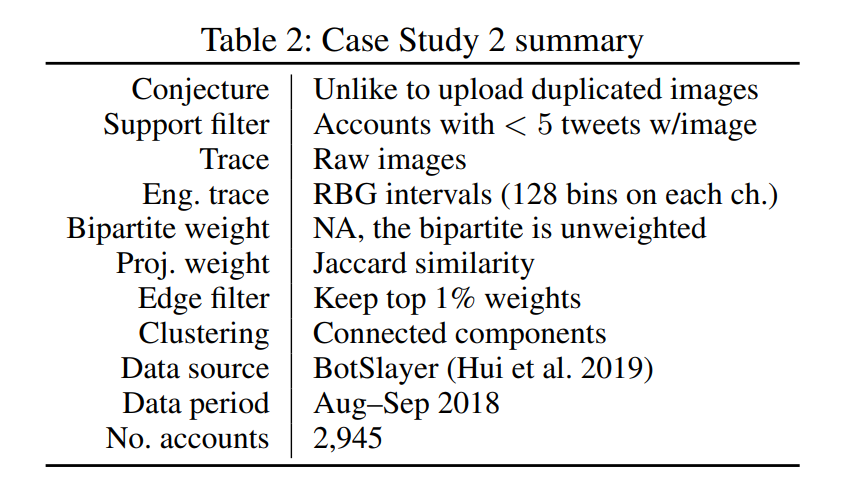

图像构成了社交媒体内容的很大一部分。一组发布许多相同或相似图像的帐户可能会揭示可疑的协调行为。在本案例研究中,我们利用媒体图像作为内容痕迹,在 2019 年香港抗议运动的背景下识别 Twitter 上的此类群体。我们使用 BotSlayer 工具(Hui et al. 2019)收集与六种语言的抗议相关的几十个主题标签相匹配的推文,随后下载了收集的推文中的所有图像和缩略图。我们重点关注包含一张或多张图像的 31,772 条推文,并删除所有转发以避免相同图像的微不足道的复制。有关数据源的更多信息请参见表 2。

(图 3:Twitter 上有关香港抗议活动的账户协调网络。节点代表账户,其大小与其度数成正比。在左侧,如果帐户可能协调,则帐户颜色为蓝色,否则帐户颜色为灰色。在右侧,我们关注与可能的协调组相对应的连接组件。三个最大的组成部分根据其图像的内容进行着色——一个支持抗议的集群,两个反对抗议的集群,分别为紫色和橙色。我们展示了这些群组共享的一些示例图像,以及相应的不同 URL 数量)

Coordination Detection

每次发布图像时,都会为其分配不同的 URL。因此,检测相同或相似的图像并不像比较 URL 那么简单;有必要分析实际图像内容。我们用 RGB 颜色直方图来表示每个图像,将每个通道分为 128 个间隔,并生成一个 384 维向量。分箱直方图允许匹配变体:具有相同向量的图像要么相同或相似,并且对应于相同的特征。虽然扩大箱子会提供更多的变体匹配,但我们希望确保空间足够稀疏以保持高匹配精度。

我们排除了发布少于五张图片的推文的帐户,以减少因支持不足而产生的噪音。人们可以通过调整这一支持阈值来调整精确度和召回率。我们设置阈值以最大限度地提高精度,同时保持合理的召回率。精度对支持阈值参数的敏感性在讨论部分进行了分析。然后,我们通过将帐户与其共享图像的向量链接起来,构建一个由帐户和图像特征组成的未加权二分网络。我们对二分网络进行投影以获得加权帐户协调网络,其边权重由杰卡德系数计算。我们认为在共享相同图像方面高度相似的帐户是协调的。为此,我们保留权重最大的 1% 的边(见图 11)。排除单例(没有协调证据的帐户),我们按大小对网络的连接组件进行排名。表 2 总结了本例中的方法决策。

(图 11:三个案例研究的协调网络权重分布。虚线代表边缘过滤器:我们保留案例 2 中权重最高 1% 的边缘,以及案例 4 和 5 中权重最高 0.5% 的边缘)

Analysis

图3显示了账户协调网络。我们发现了三个可疑集群,涉及 315 个账户,这些账户发布了支持或反对抗议的图片。反抗议团体分享带有中文文字的图片,针对的是华语观众,而支持抗议团体则分享带有英文文字的图片。我们观察到一些共享图像特征对应于完全相同的图像,其他特征则略有不同。例如,支持抗议集群中与同一特征对应的 59 个图像 URL 包含不同亮度和裁剪的细微变化。 61张相应的反抗议图像也是如此。

虽然这种方法确定了帐户的协调,但它并没有将协调描述为恶意或良性,也没有将其描述为自动或有机。事实上,有很多协调账户的行为就像人类一样(见讨论)。这些群体之所以被确定,是因为他们的组成账户比其他人群更经常地传播相同的图片内容。

Case Study 3: Hashtag Sequences

造谣活动的一个关键因素是要影响大量的受众。为了传播到追随者之外,恶意行为者可以使用标签来瞄准对某个话题感兴趣并可能搜索相关推文的其他用户。

如果一组自动帐户使用相同的文本发布消息,这将看起来很可疑,并且很容易被平台的反垃圾邮件措施检测到。很容易想象恶意用户利用语言模型(例如 GPT-2 )来解释他们的消息。由于应用程序代表用户发布释义文本,检测可能会变得更加困难。这种行为的一个例子是“适得其反的特朗普”推特应用程序,每当枪支暴力造成死亡时,该应用程序就会向特朗普总统发送推文。然而,我们推测,即使是释义文本也可能包含基于协调活动目标的相同主题标签。因此,在本案例研究中,我们探讨如何识别在多条推文中发布高度相似的主题标签序列的协调帐户。

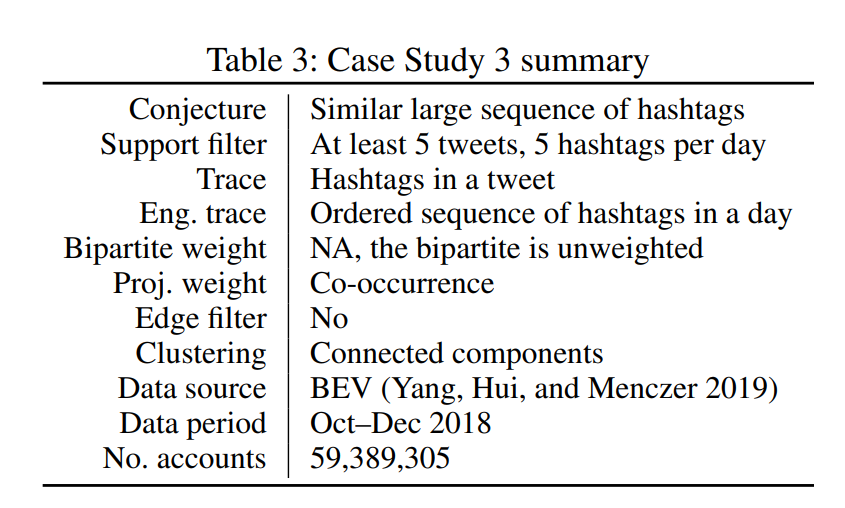

我们在原始推文数据集上评估了这种方法(没有转发)是在2018年美国中期选举前后收集的。关于数据源的更多信息见表3。在应用我们的框架之前,我们将数据集划分为每日间隔,以检测何时对帐户进行协调。

Coordination Detection

数据预处理步骤会过滤掉推文和主题标签很少的帐户。阈值取决于评估的时间段。在这种情况下,我们在 24 小时内至少使用 5 条推文和 5 个唯一的主题标签,以确保为可能的协调提供足够的支持。可以应用更严格的过滤来降低两个帐户偶然产生相似序列的可能性。

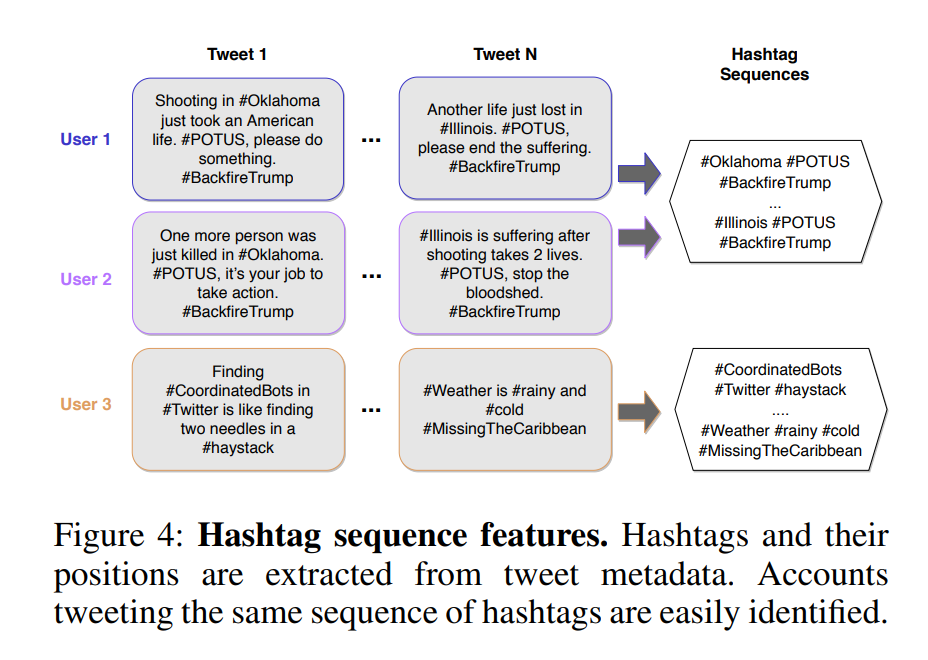

在这种情况下,我们设计了结合内容(主题标签)和活动(时间戳)跟踪的功能。特别是,我们为每个用户使用有序的主题标签序列(图 4)。二分网络由一层中的帐户和另一层中的主题标签序列组成. 在投影阶段,我们会在具有相同标签序列的两个账户之间画一条边。这些边缘是未加权的,我们不应用任何过滤,基于两个独立用户不太可能在同一天发布五个或更多主题标签的相同序列的假设。我们还考虑了一种模糊方法来匹配序列略有不同的帐户,并发现了相似的结果。

(图 4:标签序列特征。主题标签及其位置是从推文元数据中提取的。发布相同主题标签序列的推文的帐户很容易被识别。)

Analysis

我们确定了由 1,809 个唯一帐户执行的 617 个日常协调实例。图5显示了一天内识别出的32个可疑群体。最大的组件由 404 个节点组成,这些节点通过“Backfire Trump”Twitter 应用程序发送一系列推文,倡导更严格的枪支管制法。该应用程序不再有效。这些推文中的一些说法与非营利性枪支暴力档案馆的报告不一致。最小的组仅由帐户对组成。其中一对在推特上发布了一个现已不复存在的页面链接,该页面宣传在线赌场的奖金。另一对账户还提供了一个链接,指向已得到人道协会立法基金认可的民选公职候选人名单。当然,我们可以使用更长的时间窗口,并有可能揭示更大的协调网络。例如,图 5 中的 Backfire Trump 集群是由 1,175 个帐户组成的更大网络的一部分。

Case Study 4: Co-Retweets、

信息源的放大也许是最常见的操纵形式。在 Twitter 上,一组转发相同推文或同一组帐户的帐户可能表示协调行为。因此,我们在此案例研究中重点关注转发。

我们应用所提出的方法来检测放大与“白头盔”相关叙述的协调帐户,白头盔是一个志愿者组织,在叙利亚内战期间成为虚假信息活动的目标。 最近报道确定了这些活动背后的俄罗斯来源(Wilson 和 Starbird 2020)。数据是使用英语和阿拉伯语关键词从 Twitter 收集的。有关数据的更多详细信息,请参见表 4。

Coordination Detection

我们在转发帐户和转发消息之间构建二分网络,不包括自我转发和转发次数少于 10 次的帐户。该网络使用 TF-IDF 进行加权,以折扣流行推文的贡献。因此,每个帐户都表示为转发的推文 ID 的 TFIDF 向量。然后,通过帐户向量之间的余弦相似度对投影的共同转发网络进行加权。最后,为了关注潜在协调的证据,我们只保留最可疑的 0.5% 边缘(见图 11)。可以调整这些参数以在精确度和召回率之间进行权衡;阈值对精度的影响在讨论部分进行了分析。表 4 总结了方法决策。

Analysis

图6显示了共同转发网络,并突出显示了两组协调的帐户。橙色组和紫色组的账户分别转发了支持和反对“白头盔”的信息。图中显示的示例tweet已不再公开。

Case Study 5: Synchronized Actions

“拉高抛售”是一种阴暗的计划,通过虚假陈述(拉高)模拟买家兴趣激增,以更高的价格出售廉价购买的股票(抛售),从而抬高股票价格。投资者很容易受到这种操纵,因为他们希望在购买似乎有望带来高额未来利润的股票时迅速采取行动。通过在短时间内让投资者接触看似来自不同来源的信息,欺诈者会制造一种虚假的紧迫感,促使受害者采取行动。社交媒体为此类诈骗提供了肥沃的土壤(Mirtaheri 等人,2019)。我们研究了我们的方法在检测 Twitter 上协调的加密货币拉高和转储活动方面的有效性。使用与 25 种易受攻击的加密货币相关的关键字和现金标签(例如 $BTC)作为查询词来收集数据。我们会考虑原始推文和转发,因为它们都会添加到潜在买家考虑的信息流中。有关数据集的更多详细信息请参见表 5。

Coordination Detection

我们假设协调的拉高和抛售活动使用软件让多个帐户在时间上非常接近地发布拉高消息。因此,推文时间戳被用作帐户的行为轨迹。两条推文发布的时间间隔越短,它们巧合的可能性就越小。然而,较短的时间间隔会导致匹配明显减少并增加计算时间。另一方面,较长的间隔(例如每天)会产生许多误报匹配。为了平衡这些问题,我们使用 30 分钟的时间间隔。直观上,任何两个用户都可能在任意时间间隔内发布一两条推文;然而,对于一组更多的推文来说,情况并非如此。为了重点关注具有足够协调支持的帐户,我们只保留那些发布至少 8 条消息的帐户。选择这个特定的支持阈值是为了最大限度地减少误报匹配,如讨论部分所示。

然后,根据发布推文的时间间隔对推文进行分类。这些时间特征用于构建帐户和推文时间的二方网络。使用 TF-IDF 对边缘进行加权。与之前的情况类似,投影账户协调网络通过 TF-IDF 向量之间的余弦相似度进行加权。经过手动检查,我们发现该网络中共享的许多推文与加密货币无关,而只有一小部分边缘与该主题有关。这些边缘也具有很高的相似性并产生强烈的协调信号。因此,我们只保留余弦相似度最大的 0.5% 边缘(见图 11)。表 5 总结了方法决策。

Analysis

图 7 显示了同步动作网络。对网络中的连接组件进行定性分析以评估精度。紫色子图标记了观察到可疑拉高和转储计划的协调帐户集群。我们发现了不同的例子许多加密货币的方案。

(图 7:时间协调网络。如果节点(帐户)在相同的 30 分钟内发布或转发,则它们被连接。单例被省略。紫色簇中的账户和 8 点钟位置的黄色小簇中的账户对运行拉高转储计划高度怀疑。显示了一些推文摘录;这些推文不再公开。)

由于市场波动,股票市场的变化,尤其是那些专注于短期交易的加密货币,很难捕捉到。此外,很难将价格变化归因于单一原因,例如与推高和抛售相关的 Twitter 活动。这使得定量验证我们的结果变得困难。然而,在 2017 年 12 月 15 日至 21 日这一周,代币 Verge (XVG)、Enjin (ENJ) 和 DigiByte (DGB) 均呈每日上涨趋势。每天,在大量同步推文评论其移动价格后,价格都会飙升。这些趋势先于这些代币迄今为止的创纪录价格,XVG 的创纪录价格为 2017 年 12 月 23 日,ENJ 和 DGB 的创纪录价格为 2018 年 1 月 7 日。图 7 中以黄色突出显示了大量提取这三种代币的账户集群。

Discussion

本文提出的五个案例研究只是说明如何实施我们提出的方法来寻找协调。该方法原则上可以应用于除 Twitter 之外的其他社交媒体平台。例如,图像协调方法可以应用于Instagram,而Facebook页面之间的协调可以通过它们共享的内容来发现。

相关工作部分中讨论的几种无监督方法,就像这里介绍的我们方法的五个应用一样,侧重于不同类型的协调。因此,这些方法不能直接比较。本文的一个关键贡献是提供了一种灵活且通用的方法来以统一的方案描述这些不同的方法。例如,Debot(Chavoshi、Hamooni 和 Mueen 2016)可以被描述为我们的方法的一个特例,该方法基于保留动态时间扭曲距离的复杂时间哈希方案(Keogh 和 Ratanamahatana 2005),而 SynchroTrap(Cao 等人 2014) )通过在时间窗口内匹配动作来利用同步信息。 Giglietto 等人的方法。 (2020) 以及 Chen 和 Subramanian (2018) 是使用基于共享链接的相似性的特殊情况。 Ahmed 和 Abuaish (2013) 的方法使用了一个列联账户表,其特征相当于我们的二分网络。

我们的方法旨在识别账户之间的协调,但它并没有表征协调的意图或真实性,也不允许发现潜在的机制。最近的新闻报道强调了一个恶意意图的例子,该网络由青少年组成的协调网络发布有关选举的虚假叙述。然而,重要的是要记住,协调的活动可能是由具有善意意图的真实用户发起的。例如,社会运动参与者以协调的方式使用主题标签来提高对其事业的认识。

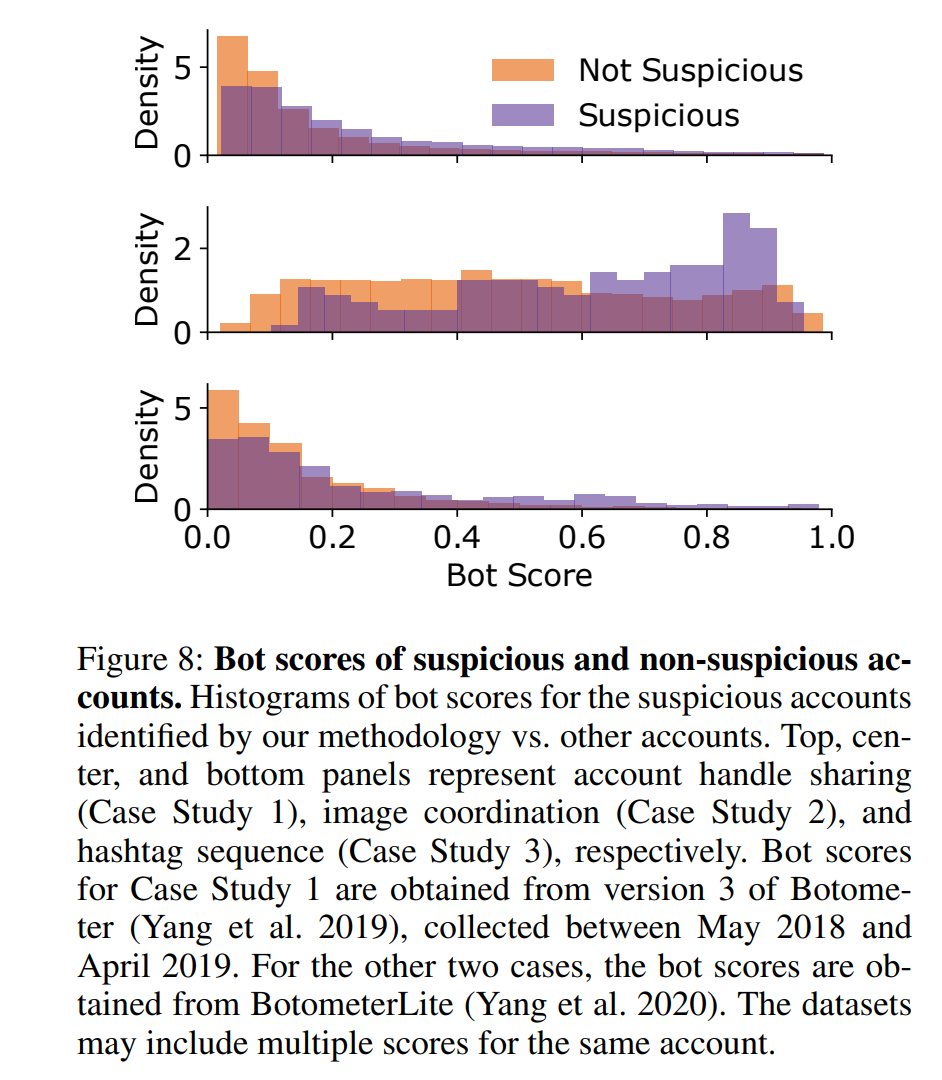

图 8 显示了案例研究 1-3 中机器人分数的分布。 (由于数据集中的匿名化,我们无法分析案例 4-5 中的机器人分数。)我们观察到,虽然协调帐户更有可能具有较高的机器人分数,但许多协调帐户的分数较低(类似于人类)——大多数在这三种情况中的两种情况下。因此,检测社交机器人不足以检测协调的活动。

(可疑和非可疑账户的机器人数量。我们的方法识别出的可疑帐户与其他帐户的机器人分数直方图。顶部、中间和底部面板分别代表帐户句柄共享(案例研究 1)、图像协调(案例研究 2)和主题标签序列(案例研究 3)。案例研究 1 的机器人分数是从 Botometer 第 3 版获得的(Yang 等人,2019),收集于 2018 年 5 月至 2019 年 4 月。对于其他两个案例,机器人分数是从 BotometerLite 获得的(Yang 等人,2020)。数据集可能包括同一帐户的多个分数。)

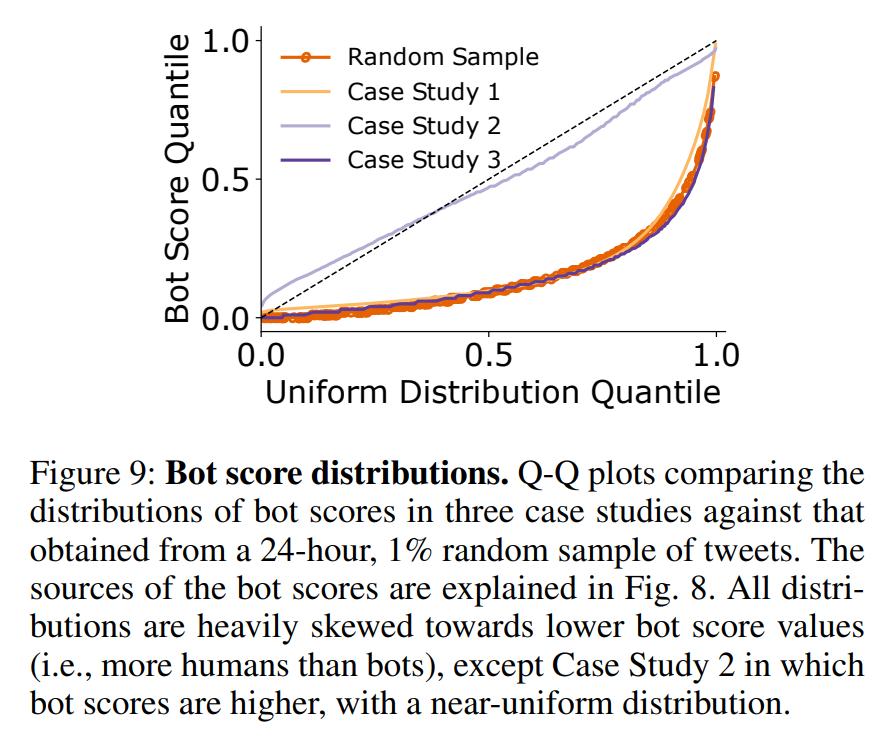

尽管这里介绍的案例研究基于不同来源的数据,但它们并不是为了夸大所提出方法的有效性,也不是为了关注恶意帐户。图 9 显示案例研究 1 和 3 中分析的帐户集的机器人分数分布与从推文随机样本中获得的分数分布一致。我们注意到这不是一个随机的账户样本-它是有偏见的账户活动。案例研究2是个例外;我们推测,在香港抗议期间,机器人被用来发布大量图片。

(机器人分数分布。 Q-Q 图将三个案例研究中的机器人得分分布与从 24 小时 1% 随机推文样本中获得的得分分布进行比较。机器人得分的来源如图 8 所示。所有分布都严重偏向较低的机器人得分值(即,人类多于机器人),但案例研究 2 除外,其中机器人得分较高,且分布接近均匀。)