线性模型(linear model)试图学得一个通过属性的线性组合来进行预测的函数。如,给定由d个属性描述的示例 ,其中 是在 个属性上的取值,则线性模型为

一般写成向量形式

其中 , 和 学得之后,模型就得以确定。

- 线性模型有很好的可解释性(comprehensibility)。

- 许多功能更为强大的非线性模型(nonlinear model)可在线性模型的基础上通过引入层级结构或高维映射而得。

下面介绍几种经典的线性模型。

线性回归

给定数据集

,其中

,(

是对应的

的标签)

线性回归试图学得

在线性回归中,最小二乘法就是试图找到一条直线,使所有样本到直线上的欧氏距离之和最小。求解 和 使 最小化的过程,称为线性回归模型的最小二乘“参数估计”(parameter estimation)

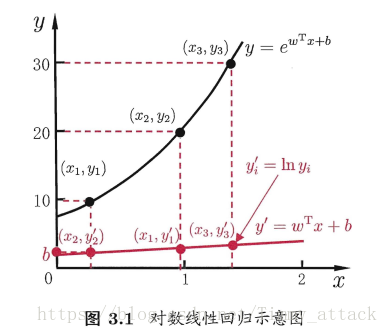

假如输出标尺是在指数尺度上的变化,那将输出标尺的对数作为线性模型逼近的目标,即

这就是“对数线性回归”(log-linear regression)

更一般地,使用单调可微函数 ,用

这样的模型称为“广义线性模型”(generalized linear model),函数 称为“联系函数“(link function)。对数线性回归是广义线性模型在 时的一个特例。

对数几率回归

广义线性模型在做分类任务时,只需找一个单调可微函数将分类任务的真实标记

与线性回归模型的预测值联系起来。

考虑二分类任务时,输出标记为

,而线性回归模型产生的预测值

是实值,所以要将实值

转换为

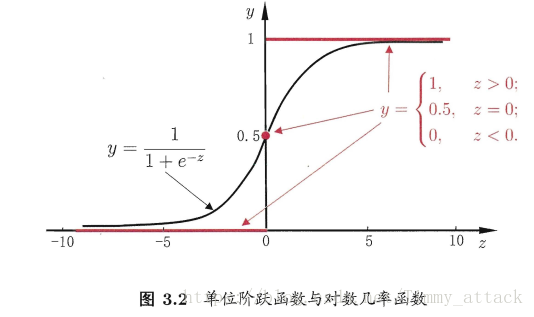

值,最理想的是”单位阶跃函数“(unit-step function)。(若预测值为临界值0时则可以任意判别)。

但问题是单位阶跃函数是不连续的函数,因此不能直接用作

。故有没有理想的替代函数,既有单位阶跃函数的特点,同时是单调可微的呢?对数几率函数(logistic function)就是这样一个常用的替代函数:

如下图:

对数几率函数可以将 值转化为一个接近0或1的 值,并在 附近变化很陡,将代数几率函数作为 代入广义线性模型,有

该式可变化为

若将 视为 为正例的可能性,则 是其反例的可能性,两者的比值 称为”几率“(pdds),反映了 为正例的相对可能性,对几率取对数则得到”对数几率“(log odds):

实际上是用线性回归模型的预测结果去逼近真实标记的对数几率,其对应模型称为” 对数几率回归“(logistic regression)

至于如何确定 和 的值,在这里暂时不做讨论。

线性判别分析

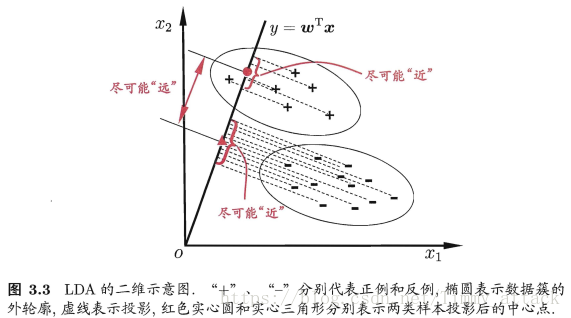

性别判别分析(Linear Discriminant Analysis)简称LDA,是一种经典的线性学习方法,它的思想很简单:给定训练样例集,设法将样例投影到一条直线上,使得同类样例的投影点尽可能接近、异类样例的投影点尽可能远离;在对新样本进行分类时,将其投影到同样的这条直线上,再根据投影点的位置来确定新样本的类别。

令给定的数据集

。

令

分别代表第

类示例的集合、均值向量、协方差矩阵。

则两类样本在直线上的投影分别为

和

。

两类样本的协方差分别为

和

。

由于直线是一维空间(于直线本身考虑,直线就是一维),因此

、

、

和

均为实数。

要使同类样例的投影点尽可能接近,可以让同类样例的投影点的协方差尽可能小,及

尽可能小;要使异类样例的投影点尽可能远离,可以让类中心之间的距离尽可能大,即

尽可能大。同时考虑两者,则得到最大化目标:

此处定义两个概念:

“ 类内散度矩阵”(within-class scatter matrix):

“ 类间散度矩阵”(between-class scatter matrix):

则公式(3.32)可以重写为

这就是LDA欲最大化的目标,即 与 的“ 广义瑞利商”(generalized Rayleigh quotient)。

确定 的方法:(这里不是太懂,后续更新)

注意到公式(3.35)的分子和分母都是关于 的二次项,分子分母会将 的长度约去,因此公式(3.35)的解与长度无关,只与其方向有关。不失一般性,令 ,则(3.35)等价于

多分类学习

在很多情况下,我们会利用二分类学习器来解决多分类问题。不失一般性,考虑

个类别

,多分类学习的基本思路是“拆解法”,即将多分类任务拆为若干个二分类任务求解。

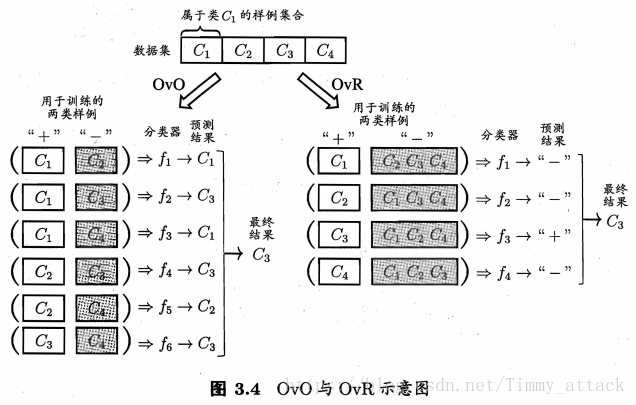

最经典的拆分策略有三种:“一对一”(One vs. One,简称OvO)、“一对其余”(One vs. Rest,简称OvR)和“多对多”(Many vs. Many,简称MvM)。

给定数据集D

。

当使用OvO拆分时,将这

个类别两两配对,从而产生

个二分类任务。在训练阶段,OvO将为区分

和

训练成一个分类器,该分类器把

中的

类样例作为正例,

类样例作为反例。在测试阶段,新样本将同时提交给所有分类器,于是得到

个分类结果,最终把预测的最多的类别作为最终分类结果。

当使用OvR拆分时,在训练阶段,将一个类的样例作为正例,所有其它类的样例作为反例来训练

个分类器。在测试阶段,新样本将同时提交给所有分类器,若仅有一个分类器预测为正类、则对应的类别标记作为最终分类结果;若有多个分类器预测为正类,则通常考虑各分类器的预测置信程度,选择置信度最大的类别标记作为分类结果。

对比OvO和OvR可以看出,OvR只需训练

个分类器,而OvO需训练

个分类器,因此,OvO的存储开销和测试时间开销通常比OvR更大。但在训练时,OvR的每个分类器均使用全部的训练样例,OvO的每个分类器仅使用两个类的样例,因此,在类别很多时,OvO的训练时间开销通常比OvR小。但预测性能在多数情况下两者差不多。

MvM是每次将若干个类作为正类,若干个其它类作为反类。它的正反类构造必须有特殊的设计,不能随便选取。

“纠错输出码”(Error Correcting Output Codes,简称ECOC)是一种最常用的MvM技术。其工作工程主要分为两步:

编码:对

个类别做

次划分,形成一个二分类训练集,这样产生

个训练集,可训练出

个分类器。

解码:

个分类器分别对测试演变进行预测,这些预测标记组成一个编码。将这个预测标记与每个类别各自的编码进行比较,返回其中距离最小的类别作为最终预测结果。

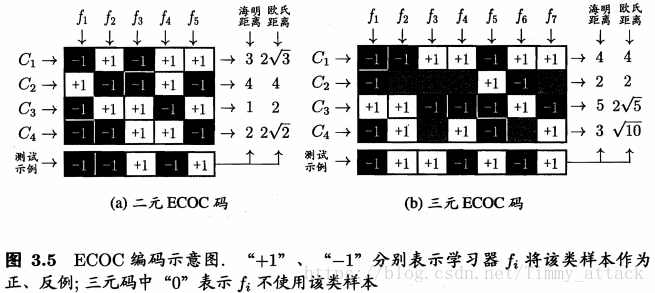

类别划分通过“编码矩阵”(coding matrix)指定,常见有二元码(只有正类和反类)和三元码(正类反类和停用类)。在测试阶段,ECOC编码对分类器的错误有一定的容忍和修正能力。下图是一个示意图:

上图(a)的若取海明距离(在信息编码中,两个合法代码对应位上编码不同的位数称为码距,又称海明距离)最小,又或者取欧氏距离最小的预测结果是

。

类别不平衡问题

类别不平衡(class-imbalance)就是指分类任务中不同类别的训练样例数目差别很大的情况。在使用OvR、MvM策略后产生的二分类任务仍可能出现类别不平衡现象。不失一般性,我们假设正类样例较少,反类样例较多。

从线性分类器的角度讨论,在用

对新样本

进行分类时,通常将预测出来的y值与阀值比较,例如当

时判别为正例,否则反例。故:

当训练集中正、反例的数目不同时,令 表示正例数目, 表示反例数目,则观察几率 。由于我们通常假设训练集是真实样本总体的无偏差采样,因此观察几率就代表了真实几率。当分类器的预测几率高于观察几率时,为正例的可能性大。于是:

但分类器做决策时是根据式(3.46),因此需要让

在实际中,“训练集是真实样本总体的无偏采样”这个假设往往不成立,所以我们未必能有效地基于训练集观测几率来推断真实几率。现有技术大体上的三类做法:

欠采样(undersampling):去除一部分反例,使得正例与反例数目接近。

过采样(oversampling):增加一些正例,使得正例与反例数目接近。

阀值移动(threshold-moving):将式(3.48)嵌入到其决策过程中。