代码链接:https://github.com/xyzhu1/CVCnet

一、背景

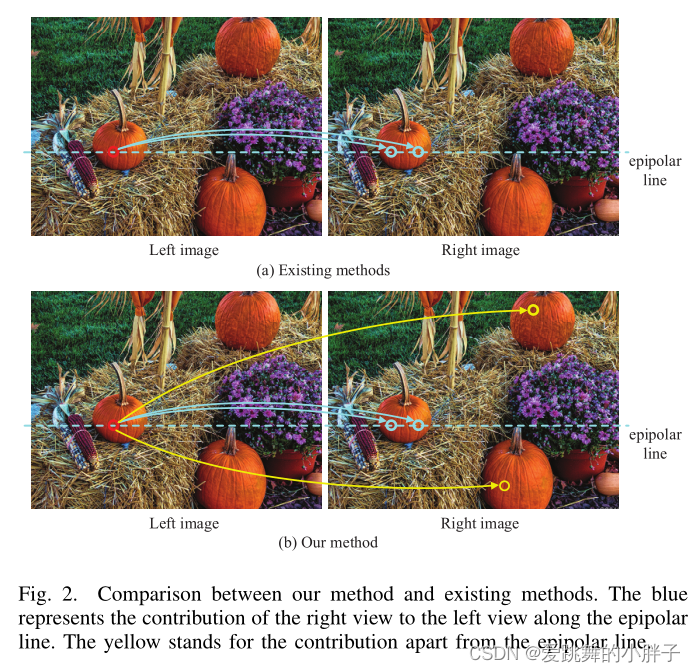

尽管现有的双目图像SR方法取得不错的效果,但来自横视图像的丰富的整体特征表示在很大程度上仍未被探索。由于这些双目图像SR方法假设附加特征仅来源于极线沿线的立体对应,因此在HR生成过程中忽略了两个视图上具有相似图案和纹理的许多有用的交叉视图特征。因此,如何有效地利用立体图像对的全局和局部特征,进一步提高立体图像的SR重建质量,是一个值得研究的问题。

针对上述问题,本文提出了一种结合整体视图和极线的丰富特征表示来提高双目图像超分辨率性能的新方法。

二、创新点

1. 提出了一个跨视图块CVB,以捕获来自两个不同视图的不同空间水平的特征,在交叉视图块中可以有效地学习全局和局部特征相关性,以增强对图像中相似模式的特征表示。

2. 提出了一个级联空间感知模块SPM,根据其所占权重对特征映射中的每个位置进行重新分配,使特征提取更加有效。

三、方法

网络框架:

CVCnet由初始特征提取(IFE)、交叉视图块(CVB)和空间感知模块(SPM)三个组成部分组成。

IFE输出多通道特征作为交叉视图块的输入,在交叉视图块中可以有效地学习全局和局部特征相关性,以增强对图像中相似模式的特征表示,然后将视差图输入级联空间感知模块SPM从CVB的综合特征中有效提取层次特征表示。

交叉视图块结构:

设计动机:现有的双目图像超分严重依赖于极线左右视图之间对应的特征。然而,除了这些局部特征外,横视图像提供的全局上下文信息也有助于立体图像SR的质量增强。因此,如果只利用极线沿线的局部信息,将会浪费立体图像中的全局信息。

提出CVB来生成一种机制,探索全局和局部特征的相关性,以增强重建过程

右视图与左视图沿极线的相似矩阵:

![]()

右视图的特征嵌入:

![]()

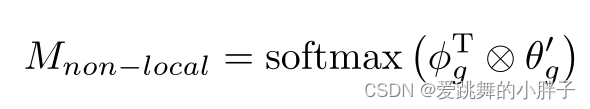

为了利用交叉视图图像中的全局上下文特征,全局相似性矩阵:

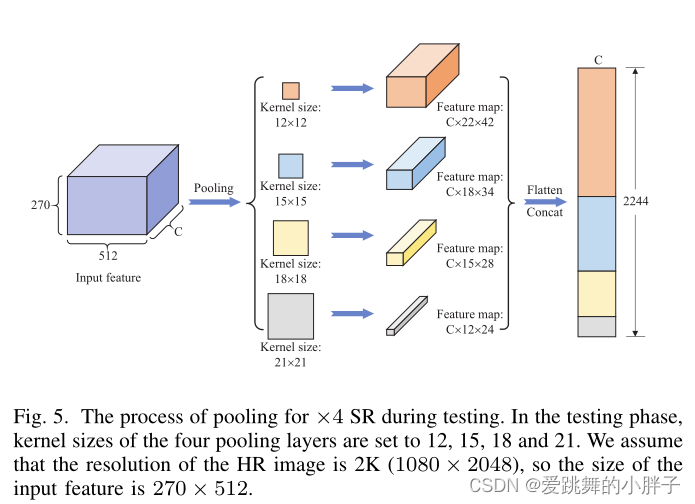

全局相似矩阵需要过高的计算成本,本文采用金字塔抽样方案来显著降低时间复杂度:

金字塔抽样方案:

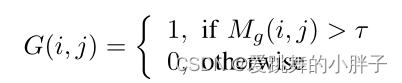

如果直接利用这个相似矩阵Mg,它可能会嵌入太多来自交叉视图图像的不相关信息,从而限制性能。例如,在图2中,除了极线两端的对应外,图像的某些部分与目标区域具有相似的纹理,但在交叉视图图像中,大多数部分对该区域的SR没有贡献。因此,有必要消除与目标位置相似度低的位置的特征。

在CVB中,设计了一个掩模来过滤交叉视图图像中相似度低的特征

(G·Mg)表示保留全局相似矩阵较高权重的过滤矩阵

既包含极线沿线的信息,也包含交叉视图之间的全局信息。

空间感知模块SPM:

SPM通过根据其所占权重重新分配特征图中的每个像素来增强特征的有用部分

根据通道维度将这些特征分成两部分。其中一部分被发送到下一个特征提取模块,另一部分被保留用于特征融合。

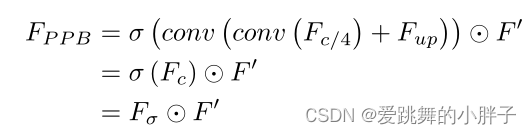

像素感知块(PPB):

采用渐进式方法扩展特征的接受域。首先,利用跃进卷积得到Fstrided。然而,Fstrided的接受域仍然有限,因此应用最大池化层并得到Fpooling。表示如下:

四、实验

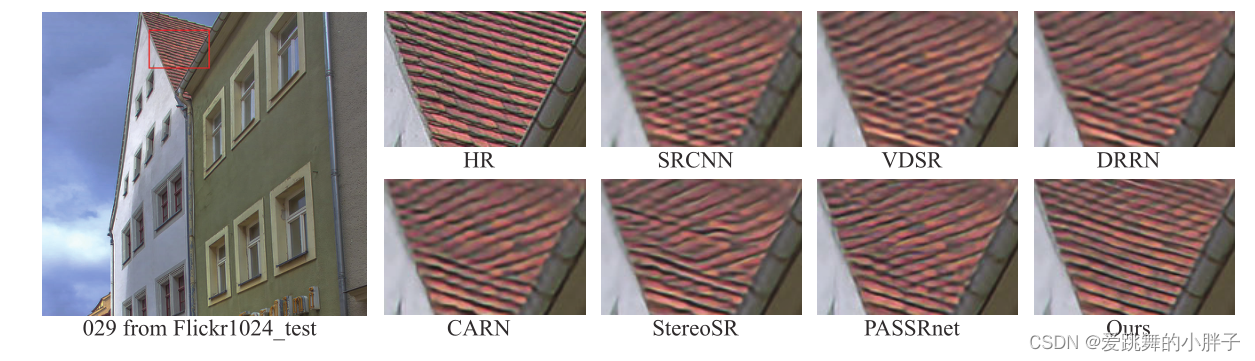

可视化结果分析:

虽然PASSRnet产生了更清晰的纹理,但它的大部分线条仍然与HR图像相差甚远,本文方法瓷砖线条彼此独立,方向相同,这与HR图像最相似。

HR图像中摩托车的两条边缘清晰锐利。然而,大多数方法重建的轮廓都难以识别尖锐边缘。

性能与运行时间比较:

与PASSRnet相比,本文方法在参数数量减少了四分之一的情况下仍然具有更好的性能。

消融实验:

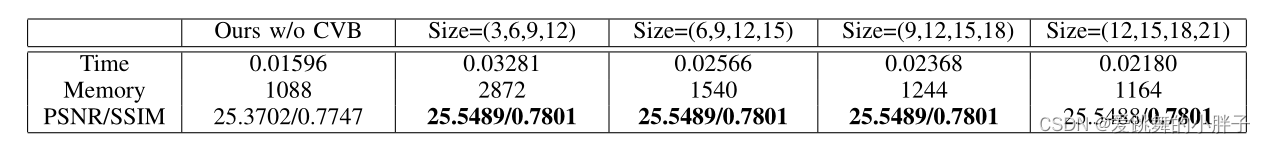

图像金字塔内核消融实验:

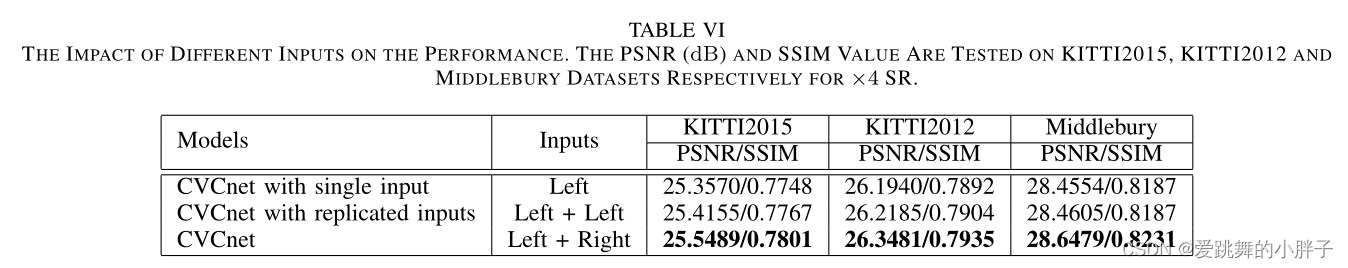

双视角消融实验:

总结:

本文针对以前方法没有充分利用另外一个视角的非极线位置的图像信息,提出了一个跨视图捕获网络CVCnet。通过设计CVB来捕获两个视角之间的全局上下文和局部特征嵌入,提出SPM模块根据所占权重对像素点进行重新分配,提高特征提取效率。通过设计者两个模块来探索跨视图的丰富特征表示。

欢迎大家补充缺点,没用过这个方法,暂时不明确缺点。